基于二哈 2 视觉识别的视障人士智能出行辅助装置

一、项目基本信息

- 作品名称:AI 智能循迹盲杖

- 参赛组别:创意智造组(软硬件结合)

- 核心技术:Mind+ V2 二哈 2(HUSKYLENS 2)AI 模型训练、盲道视觉识别、行空板 K10 语音引导、I2C 硬件联动

- 使用硬件:行空板 K10、二哈 2 AI 视觉摄像头、5V充电宝、Type-C 数据线、盲杖手柄 / 固定支架、杜邦线、扎带

- 参赛:DFRobot Mind+ V2 模型训练挑战赛

二、项目背景与创作目的

1. 创作背景

视障人士日常出行高度依赖传统盲杖,但传统盲杖存在三大核心痛点:

- 只能被动探路,无法主动识别路径:无法判断盲道位置,容易偏离、走偏;

- 无法提供方向引导:仅靠触觉反馈,无法告知用户 “向左 / 向右 / 向前”;

- 智能化程度低:市面上缺少低成本、易实现、真正适配视障用户的 AI 导盲设备。

结合本次 Mind+ V2 模型训练挑战赛 主题 “AI 重构生活”,我希望用 AI 视觉 + 开源硬件,打造一款真正解决视障人士出行痛点的智能装置,让 AI 成为视障人士的 “电子眼睛”。

2. 创作目的

- 利用二哈 2 AI 视觉离线识别盲道,无需网络,实时响应;

- 通过行空板 K10 语音播报,引导视障人士向左前方、向右前方、向前行走,稳定走在盲道上;

- 实现 “按键启动、全程语音引导、开机即用” 的极简操作,适配视障用户使用习惯;

- 完成从 AI 模型训练→硬件联动→真实场景测试 的完整 AI 项目闭环,打造低成本、可落地的智能导盲方案。

三、作品简介与设计思路

1. 作品简介

本作品基于 Mind+ V2 二哈 2 AI 视觉模块 训练盲道识别模型,搭配行空板 K10 主控,实现:

- 按键启动后,二哈 2 实时识别盲道;

- 根据盲道在画面中的 X 坐标,判断位置偏左 / 偏右 / 居中;

- 行空板 K10 实时语音播报方向,引导用户行走;

- 未找到盲道时,语音提示 “未找到盲道”,提醒用户注意安全。

实现 “AI 看盲道,语音带路人” 的智能循迹盲杖,为视障人士出行提供安全、智能的辅助。

2. 整体设计思路

- 主控核心:行空板 K10,负责语音合成、逻辑判断、屏幕显示、按键控制;

- 视觉感知:二哈 2 AI 摄像头,离线识别盲道,输出目标位置信息;

- 交互逻辑:按键启动 → 二哈 2 识别盲道 → 坐标判断 → 语音引导;

- 结构设计:二哈 2 固定在盲杖前端(最佳拍摄视角),K10 固定在手柄处(方便握持、操作按键);

- 核心逻辑:

- 盲道 X 中心<300 → 语音 “请向左前方行走”

- 盲道 X 中心>340 → 语音 “请向右前方行走”

- 盲道在中间区域 → 语音 “请慢慢向前走”

- 未识别到盲道 → 语音 “未找到盲道!”

四、硬件器材清单

| 器材名称 | 数量 | 功能说明 |

|---|---|---|

| 行空板 K10 | 1 块 | 主控、语音合成播报、屏幕显示、按键控制、程序运行 |

| 二哈 2(HUSKYLENS 2)AI 视觉摄像头 | 1 个 | 离线识别盲道、输出目标 X 坐标,I2C 通信 |

| 5V 充电宝 | 1 个 | 为 K10 与二哈 2 供电,实现便携使用 |

| Type-C 数据线 | 1 根 | 程序上传、供电 |

| 杜邦线(公对母) | 4 根 | 二哈 2 与 K10 I2C 接线(SDA/SCL/VCC/GND) |

| 盲杖手柄 / 塑料支架 | 1 套 | 固定主控与摄像头,手持使用 |

| 扎带 / 魔术贴 | 若干 | 固定线材、模块,防松动 |

五、软件开发与程序设计

1. 开发环境

- 编程软件:Mind+ V2(图形化编程,支持二哈 2 模型训练)

- 硬件平台:行空板 K10(Python 3.7 运行环境)

- 视觉工具:二哈 2 AI 配置软件(训练盲道识别模型)

- 通信方式:二哈 2 ↔ K10 I2C 通信

- 调试环境:行空板串口日志、屏幕状态显示、多场景实物测试

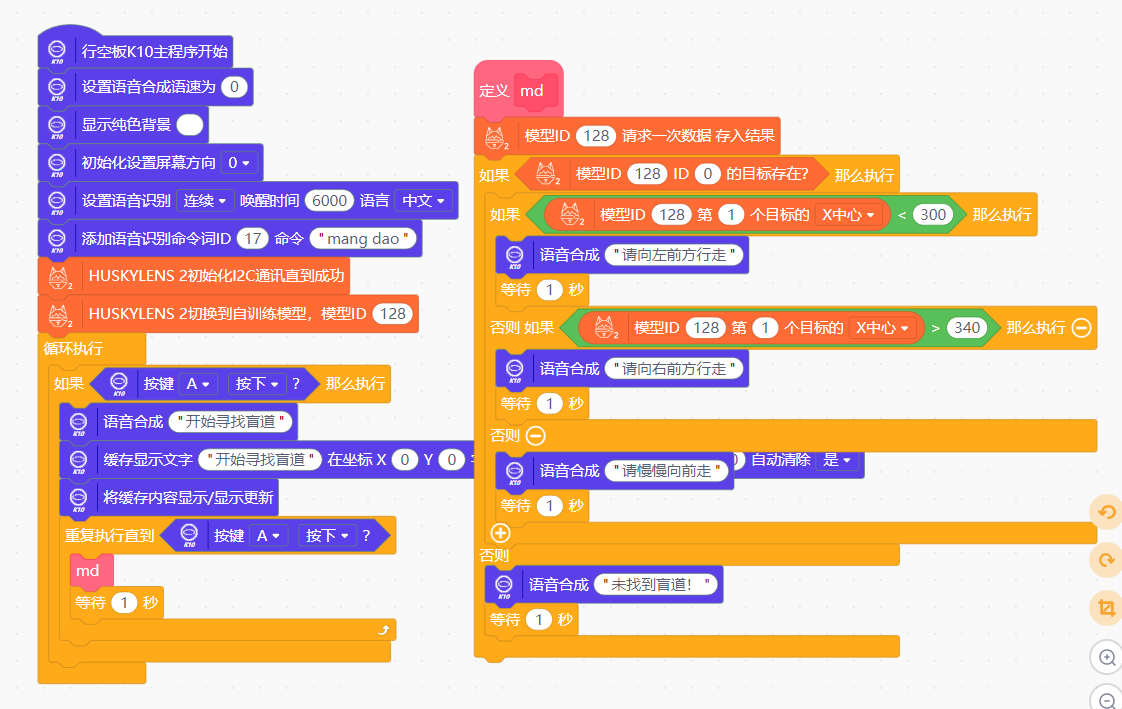

2. 程序设计(核心逻辑)

程序基于 Mind + 图形化编程实现,核心流程如下:

初始化阶段:

- 行空板 K10 主程序启动,设置语音合成语速、屏幕方向;

- 初始化二哈 2 I2C 通讯,切换到自训练盲道模型(模型 ID 128);

- 添加语音识别命令(mang dao),支持语音唤醒;

- 定义md子线程,用于实时盲道识别与语音引导。

主程序逻辑:

- 循环检测按键 A:按下后,语音播报 “开始寻找盲道”,启动md子线程;

- 重复执行直到按键 A 再次按下,实现启停控制。

核心识别与引导逻辑(子线程md):

- 二哈 2 请求一次数据,判断盲道目标是否存在;

- 若存在,读取第 1 个目标的 X 中心坐标:

- X<300 → 语音 “请向左前方行走”

- X>340 → 语音 “请向右前方行走”

- 中间区域 → 语音 “请慢慢向前走”

- 若未识别到盲道 → 语音 “未找到盲道!”

- 每次播报后等待 1 秒,避免重复播报,保证引导流畅。

六、作品制作过程(5 步详解)

步骤 1:需求分析与方案设计

文字说明:

- 调研视障人士出行痛点,明确 “盲道识别 + 语音引导” 核心需求;

- 确定技术方案:二哈 2 视觉识别 + 行空板 K10 语音播报,I2C 通信;

- 设计结构:盲杖前端装二哈 2(拍摄盲道),手柄装 K10(操作 + 语音);

- 绘制设计草图,明确接线、布局、逻辑流程。

配图说明:

- 图 :项目设计想象草图

步骤 2:硬件准备与结构搭建

文字说明:

- 采购所有硬件器材,核对型号与功能;

- 用支架将二哈 2 固定在盲杖前端,调整角度(向下倾斜 15°,适配行走视角);

- 将行空板 K10 固定在手柄处,方便按键操作与握持;

- 用杜邦线完成二哈 2 与 K10 的 I2C 接线(SDA→SDA,SCL→SCL,VCC→5V,GND→GND);

- 用扎带固定线材,防止松动、缠绕,保证结构稳固。

配图说明:

- 图 :盲杖组装实物图

步骤 3:二哈 2 模型训练

文字说明:

- 采集不同场景下的盲道图片(晴天、雨天、阴影、遮挡、不同角度),构建数据集;

- 在二哈 2 中创建 “盲道” 分类,标注图片,训练模型;

- 测试模型识别准确率,优化标注,调整模型参数;

- 导出模型,在 Mind + 中配置模型 ID 128,完成视觉识别准备。

配图说明:

- 图 :二哈 2 模型训练界面

步骤 4:程序编写与系统联调

文字说明:

- 在 Mind + 中编写图形化程序,实现按键启停、盲道识别、坐标判断、语音引导;

- 上传程序到行空板 K10,联调硬件:测试二哈 2 识别、语音播报、按键控制;

- 调整语音间隔(1 秒),避免重复播报;优化 X 坐标阈值(300/340),提升引导精准度;

- 解决调试中遇到的问题(详见下文 “问题与解决”)。

配图说明:

- 图 :完整程序截图

步骤 5:多场景测试与迭代改进

文字说明:

- 在室内走廊、户外人行道、不同光线环境下测试识别率与引导效果;

- 邀请视障人士试用,收集反馈,优化语音提示、握持手感;

- 调整二哈 2 安装角度,提升识别稳定性;

- 最终完成功能稳定、体验良好的智能循迹盲杖成品。

七、遇到的问题、解决方法与未解决的挑战

1. 已解决的问题

- 二哈 2 I2C 通讯失败:

- 问题:初始化时提示 “通讯失败”,无法连接二哈 2;

- 解决:检查接线(SDA/SCL 接反),确认是否成功初始化。

- 语音播报卡顿 / 延迟:

- 问题:连续播报导致语音混乱,影响引导;

- 解决:在每次语音后添加 1 秒等待,限制播报频率,保证语音清晰、不重叠。

- 模型识别误判:

- 问题:将地面纹理、斑马线误判为盲道;

- 解决:补充更多负样本(非盲道地面),重新训练模型,提升识别准确率。

2. 仍存在的问题(反馈说明)

盲道识别不准确问题:

- 现象:在强光、阴影、盲道磨损 / 被遮挡场景下,二哈 2 识别率下降,出现漏检、误判;

- 原因:数据集覆盖场景有限,模型泛化能力不足;二哈 2 摄像头视角固定,行走时画面晃动影响识别。

- 后续优化方向:扩大数据集,增加复杂场景样本;优化安装角度,增加防抖结构;升级模型算法,提升鲁棒性。

语音发音启动不了的问题:

- 现象:部分场景下,程序逻辑正常,但语音合成无法启动,无播报声音;

- 原因:行空板 K10 语音模块资源占用,二哈 2 识别线程与语音线程冲突;程序中连续触发语音,导致模块卡死;

- 已尝试的解决方法:

- 调整语音线程优先级,添加延时,避免连续调用;

- 重启语音模块,重新初始化语音合成;

- 简化程序逻辑,减少语音触发频率;

- 未完全解决:仍偶发语音无法启动,需重启设备恢复,后续将进一步优化程序架构,分离线程,解决资源冲突。

八、原创部分与非原创部分说明

1. 原创部分

- 整体系统集成方案:将行空板 K10、二哈 2 视觉模块、语音引导进行创新性整合,构建完整的 AI 智能循迹盲杖系统;

- 核心引导逻辑算法:根据盲道 X 坐标判断位置,输出左 / 右 / 前语音引导,是本作品的核心原创逻辑;

- 产品结构与交互设计:盲杖式结构、模块布局、按键启停 + 全程语音的交互方式,适配视障用户使用习惯;

- 程序逻辑设计:图形化程序的流程设计、线程优化、问题排查与调试方案。

2. 非原创部分

- 硬件平台:行空板 K10、二哈 2 AI 摄像头、充电宝等均为市面成熟商用元器件;

- 基础技术:二哈 2AI 视觉识别、行空板语音合成、I2C 通信等为 DFRobot 官方提供的成熟技术与库;

- 通用原理:AI 图像识别、语音播报、硬件控制等为通用技术原理。

本作品核心价值在于将成熟技术进行创新性整合,针对视障人士出行痛点,打造低成本、可落地的智能导盲方案。

九、作品创新点

- AI 视觉主动引导,替代传统盲杖:从 “被动探路” 升级为 “主动引路”,用 AI 识别盲道,语音引导行走,解决传统盲杖的核心痛点;

- 离线运行,无需网络:二哈 2 本地模型推理,无需联网,适配户外无网络场景,实用性强;

- 极简交互,适配视障用户:按键启停 + 全程语音引导,无需看屏幕,操作简单,符合视障用户使用习惯;

- 低成本、易实现:采用开源硬件,成本低、易购买、易组装,适合推广与二次开发;

- 模块化设计,可扩展性强:可后续添加超声波障碍物检测、GPS 定位、紧急呼叫等功能,升级空间大。

十、总结与展望

1. 项目总结

本作品成功实现了基于二哈 2 视觉识别的 AI 智能循迹盲杖,完成了盲道识别、语音引导、按键控制的完整功能,解决了视障人士出行的核心痛点。项目严格遵循比赛要求,完成了从模型训练、硬件搭建、程序编写到测试优化的全流程,同时真实反馈了开发中遇到的识别不准确、语音启动失败等问题,体现了项目的真实性与探索性。

2. 未来展望

- 优化模型,提升复杂场景下的盲道识别准确率;

- 解决语音线程冲突问题,实现语音播报 100% 稳定;

- 添加超声波障碍物检测,实现 “盲道引导 + 障碍预警” 双功能;

- 优化结构,减轻重量,提升便携性与握持舒适度;

- 邀请更多视障人士试用,持续优化产品体验,打造真正实用的智能导盲设备。

十一、参赛声明

本作品为本人独立创作完成,所有内容真实有效,不存在抄袭、造假行为。项目中使用的开源硬件、技术均遵循相关开源协议,符合比赛要求。

返回首页

返回首页

回到顶部

回到顶部

_深蓝_2026.04.15

有赛事模版的样子,肯定是经常参加赛事的大佬