一、项目核心定位

本项目聚焦“人脸识别+表情识别”双技术融合,以“精准身份核验+实时情绪感知”为核心,落地于多场景智能化服务与管理,解决传统身份验证单一、情绪状态无法实时捕捉的痛点,为不同行业提供高效、便捷、人性化的技术解决方案,兼顾安全性与用户体验,打造可复用、可扩展的智能识别系统。

二、项目背景与痛点

随着智能化技术的普及,单一的人脸识别已无法满足多行业的深度需求——在身份核验场景中,仅确认身份无法判断用户当前状态(如疲劳、烦躁、异常情绪);在服务场景中,无法快速感知用户情绪,难以提供个性化服务;在管理场景中,无法实时掌握人员情绪波动,存在安全隐患或服务漏洞。

例如:在兵工厂等危险的厂房,识别人脸与表情,排除前瞻性危险;校园门禁仅能确认学生身份,无法发现学生入校时的异常情绪(如抑郁、烦躁),难以及时干预;企业考勤仅能记录到岗情况,无法感知员工上班时的疲劳、低落状态,影响工作效率与安全生产;线下服务门店(如银行、营业厅)无法快速识别客户情绪,难以针对性调整服务态度,影响客户体验。

基于此,本项目融合人脸识别与表情识别技术,实现“身份确认+情绪感知”一体化,填补单一识别技术的短板,适配多行业实际需求,解决上述核心痛点。

三、项目介绍

演示视频如下:

三、项目实施

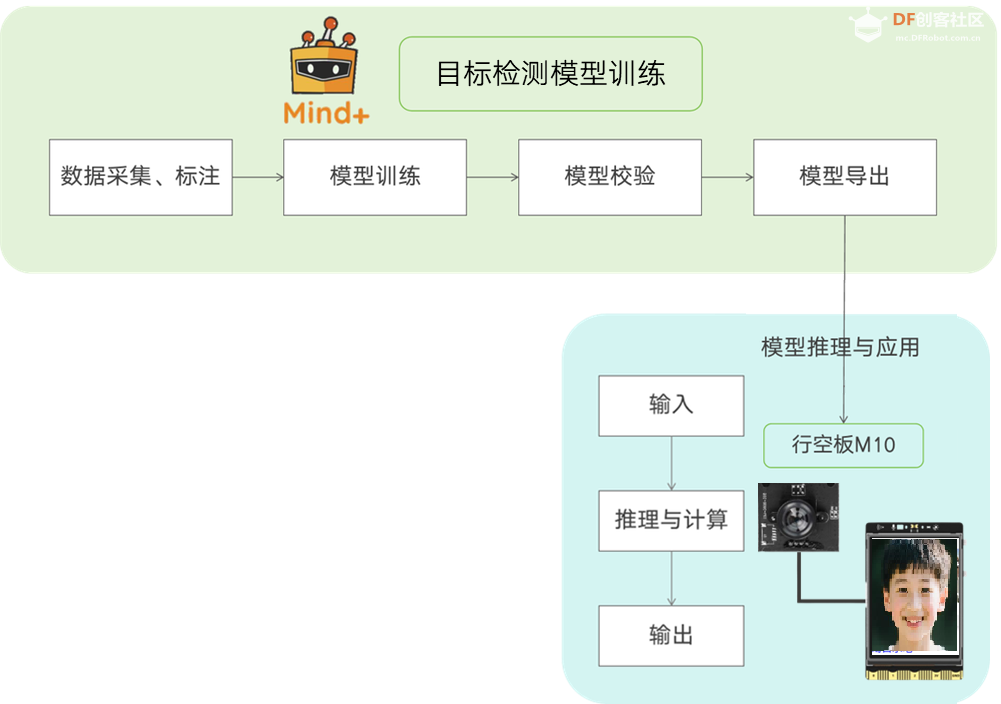

该项目通过Mind+2.0模型训练工具中的图像分类模块训练“人脸识别+表情识别”,并将模型部署到行空板M10实现人脸与表情检测。行空板M10将接收的信息呈现,语音播报提醒。

(1)软件准备

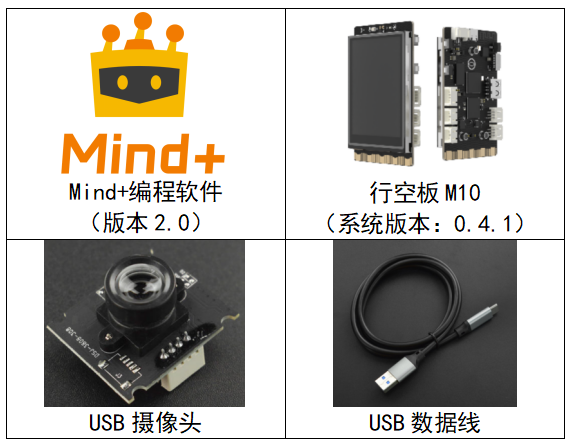

1.软硬件器材清单

注意:Mind + 编程软件版本需为V2.0及以上。

2.软件平台准备

官网下载安装Mind+ V2.0及以上版本安装包,安装完成后,双击打开

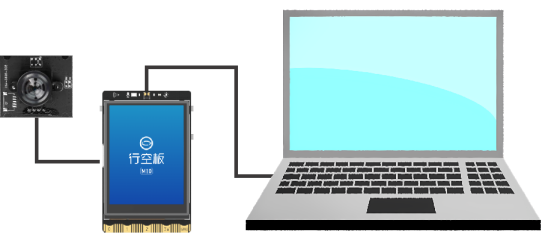

3.请参照连接图,完成电脑、行空板与 USB 摄像头的连接:

本项目需要行空板的Python环境的版本为3.12.7,请根据下面的步骤将其切换到指定版本。

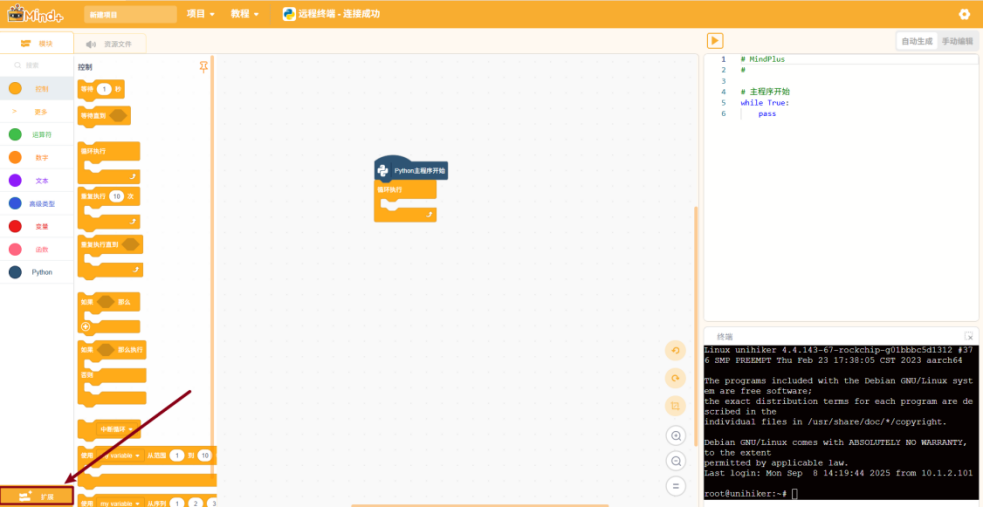

打开编程软件Mind+,选择“程序设计”中的“Python模式”。

进入 “扩展” 页面并搜索 “行空板”,点击扩展包上的 “下载” 按钮。

下载完成后点击该扩展包完成加载,再点击 “返回” 按钮返回编程界面。

在终端连接选项中中选择“默认-10.1.2.3”以连接行空板M10。

由于依赖库是要下载到行空板中的,我们需要先给行空板联网。

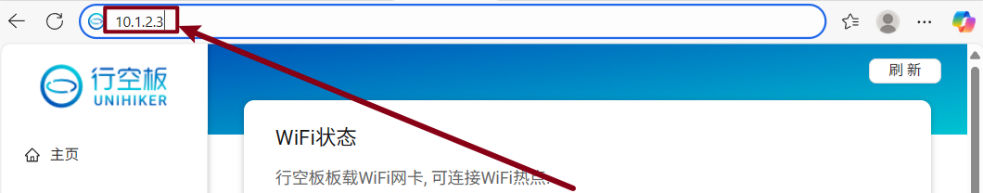

在浏览器地址栏中输入“10.1.2.3”。

选择“网络设置”->点击“扫描”->选择无线网络名称并输入密码->点击“连接”。

显示“wifi连接成功”,你的行空板已经连接好了网络。

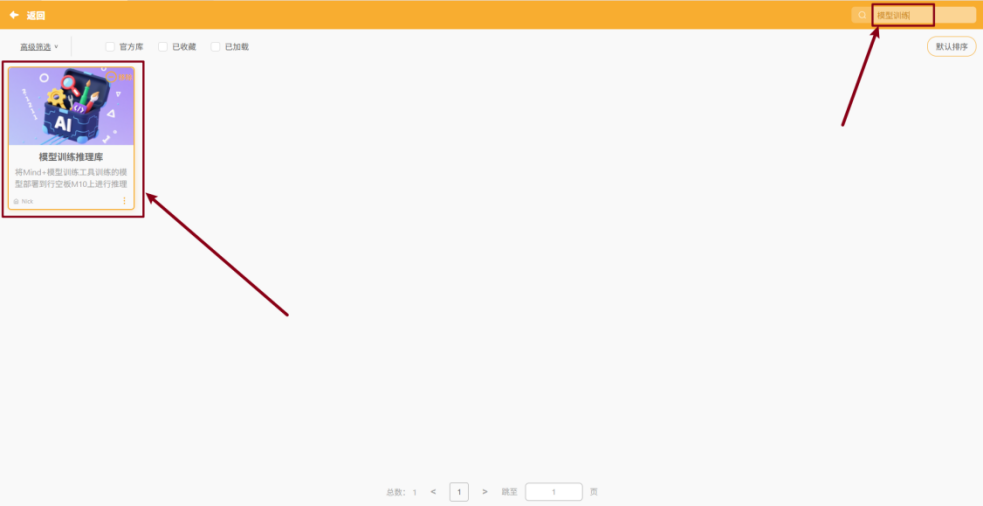

行空板的环境和网络都设置成功了,接下来需要加载模型推理相关的扩展。

在扩展中搜索“模型训练”点击下载并添加该用户库。

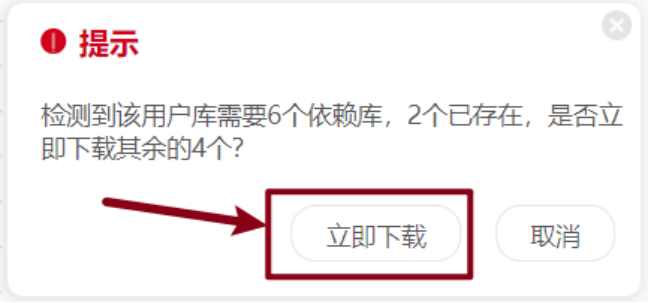

出现下载指定依赖库的提示后,按照提示点击 “确定” 进行下载。

我们使用Mind+中的模型训练来完成人脸表情的采集、模型训练和导出。

首先,打开Mind+软件,选择“模型训练”并打开“图像分类”(注意:只有Mind+2.0及以上版本才有模型训练功能)。

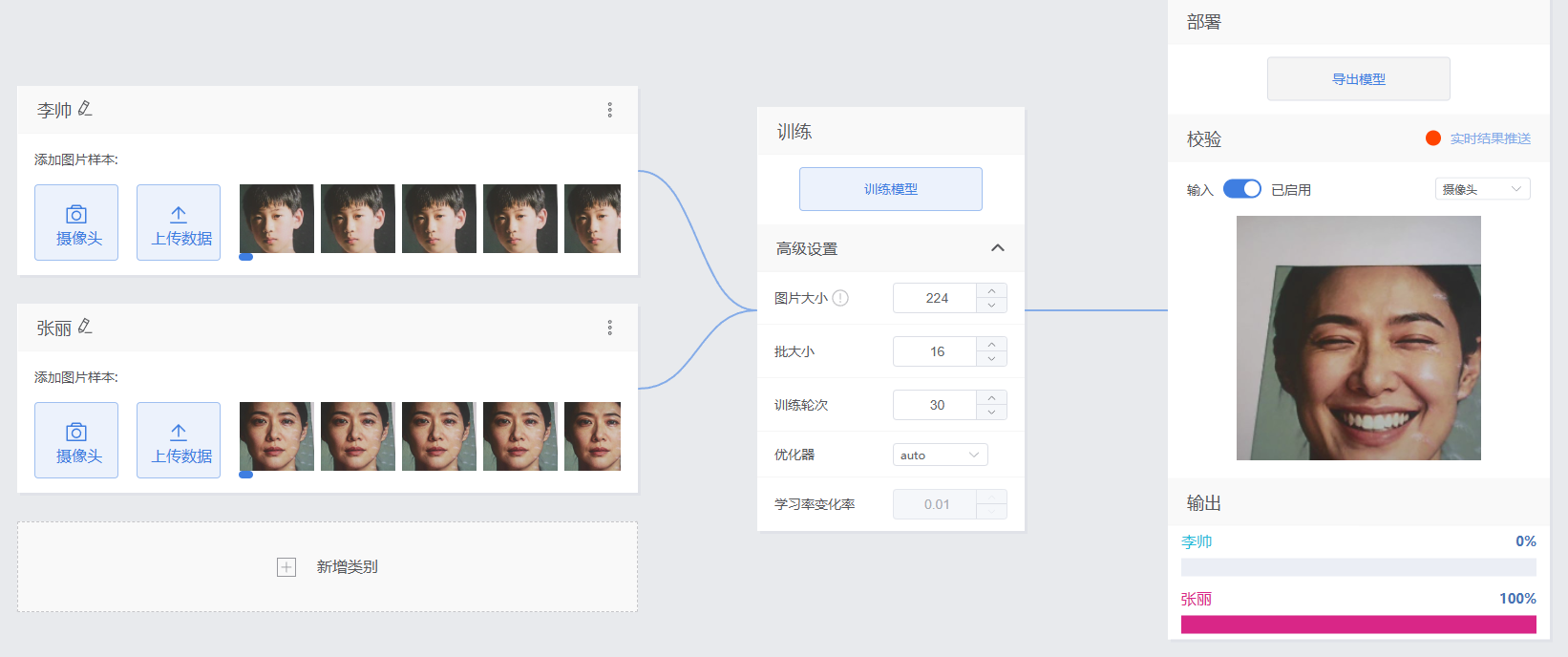

页面分为三部分,从左至右依次为:数据采集、模型训练、模型校验与导出(后面会详细说明各部分的使用方法)。

4.1数据采集(表情数据/人脸数据)

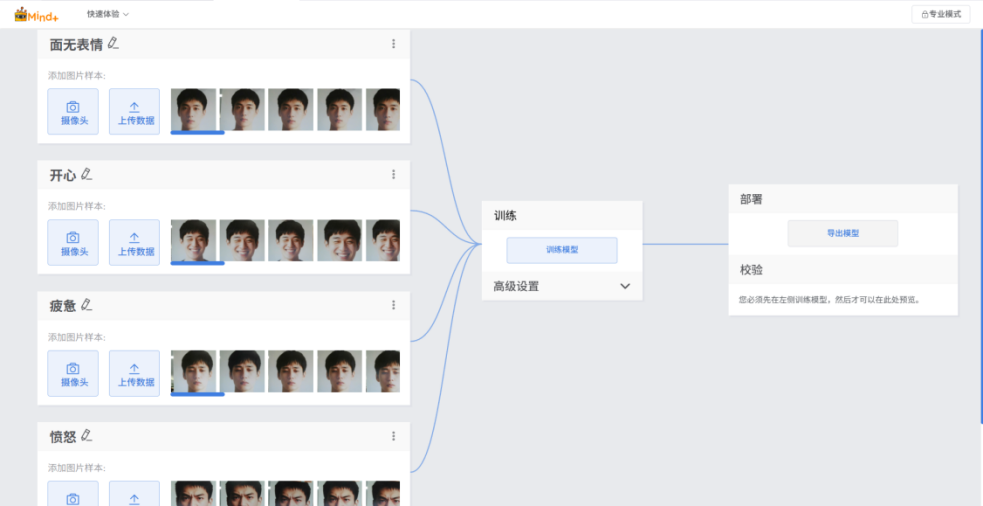

为了训练表情分类模型,我们需要准备含有不同类别的数据集。

本项目中使用了面无表情、开心、疲劳和愤怒的三种表情,所以需要添加四个类别,设置好的类别如下:

点击摄像头进行数据采集,长按“按住即可录制”按钮开始数据采集。

默认为一秒采集一张照片,可根据需要在设置中进行调整。

所有表情采集结束后,关闭摄像头。

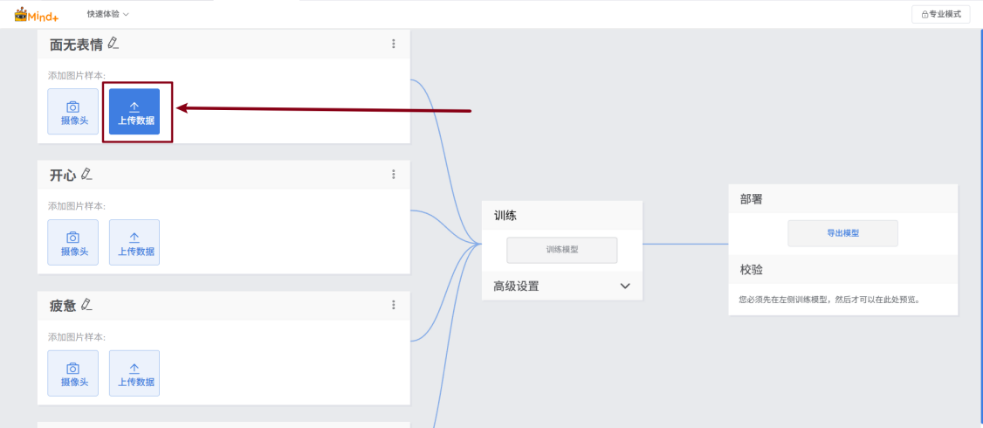

也可以通过下面的步骤上传数据。

点击“上传数据”,并选择“选择文件上传”。

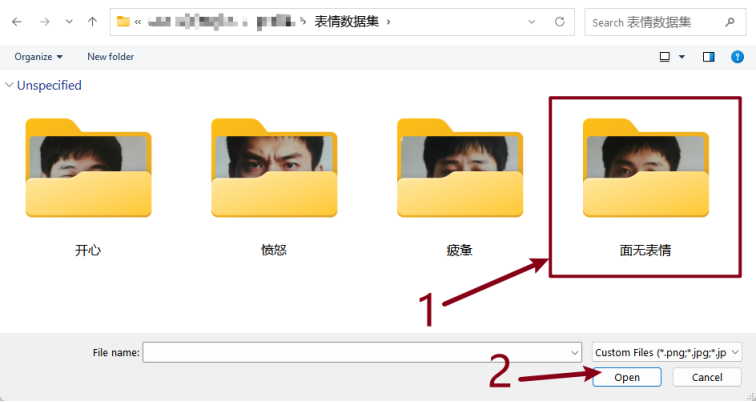

打开数据集对应类别的数据集文件夹。

数据集准备完成后,我们即可进入模型训练环节。

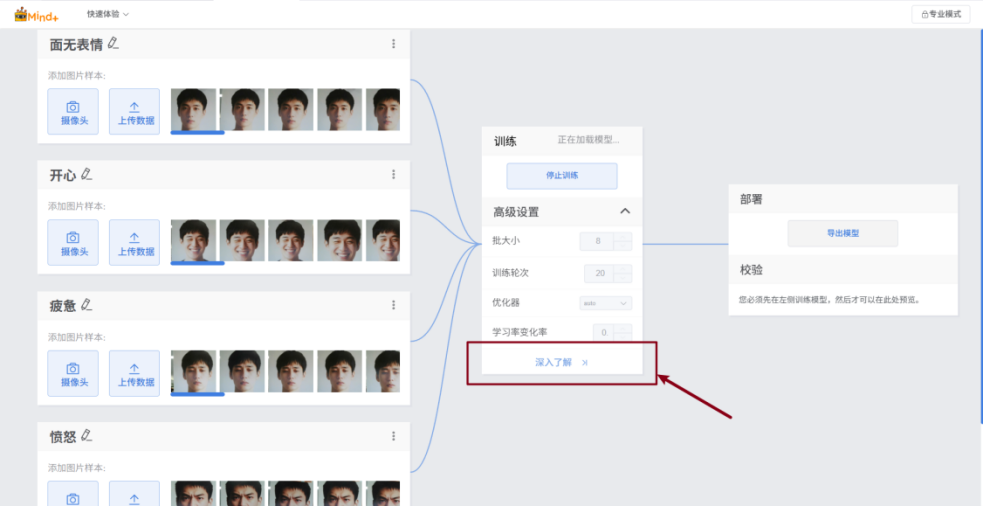

4.2模型训练

在训练模型前,我们需要根据数据集特点修改训练参数。

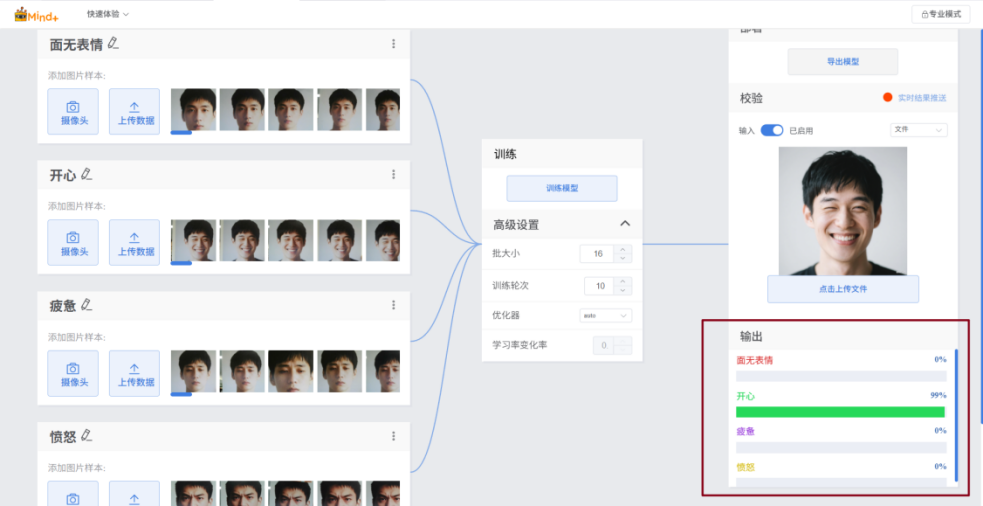

4.3模型校验与导出

模型训练结束后,可以通过模型校验来验证模型效果。请按照下面的步骤使用摄像头拍摄进行校验。

开启“输入”开关->选择摄像头->将摄像头对准目标->观察输出

同时,该项目的附件中也提供了测试文件,可通过下面的步骤进行上传文件的校验。

开启“输入”开关->选择“文件”->点击“选择文件上传”->选择文件并点击确定->观察校验结果。

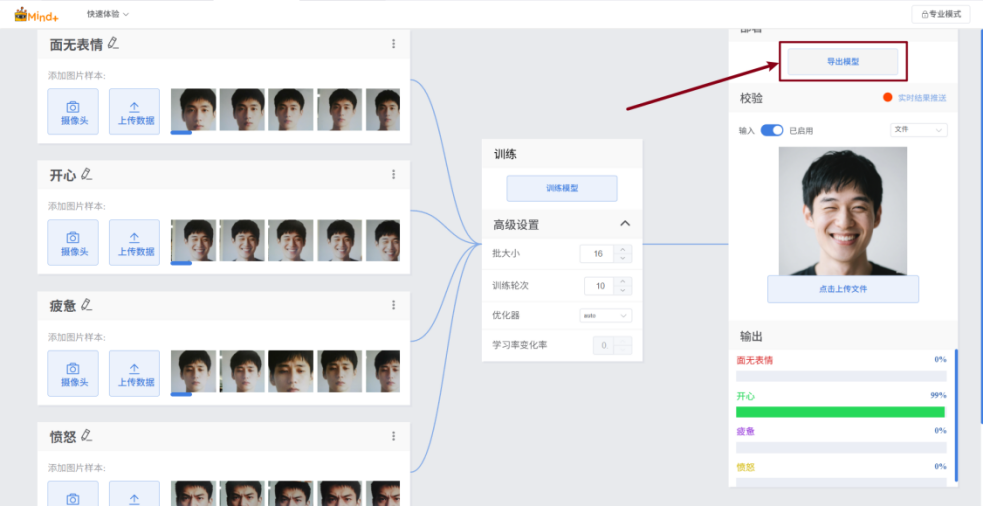

校验结果符合预期后,即可导出模型文件。

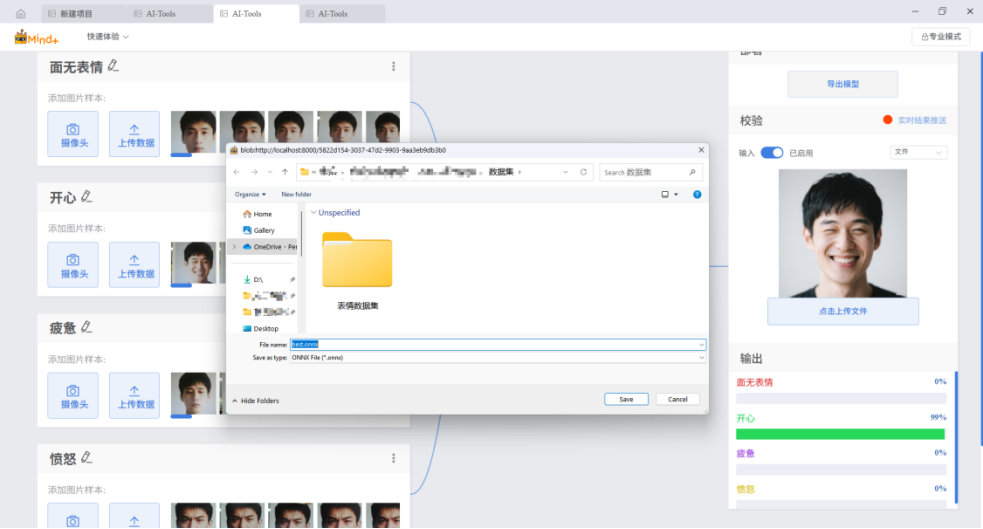

点击“导出模型”将模型导出为onnx格式的文件和yaml格式的配置文件(上述两个文件在模型推理与应用中会使用到)。

选择位置保存模型文件。

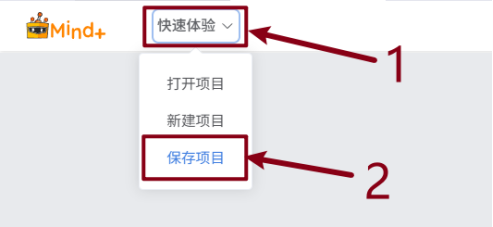

建议将该模型训练项目保存为项目文件,方便后期对模型进行优化和调整。步骤如下:

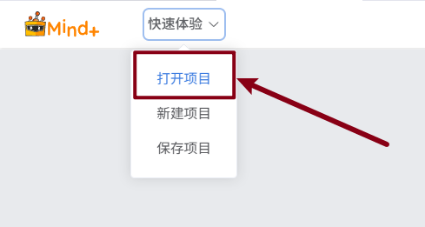

展开“快速体验”,选择保存项目。选择要保存的位置,点击“确认”完成保存操作。并通过“快速体验”中的“打开项目”打开保存的项目文件。

模型训练和导出到这一步就结束了,之后就是模型的推理与应用了。

4.4模型推理与应用

请按照下列步骤将模型训练导出的模型文件上传到行空板M10中,并编写程序完成表情的图像分类并执行对应结果。

请按照下面的步骤上传模型文件。

打开Mind+编程软件并进入python模式。

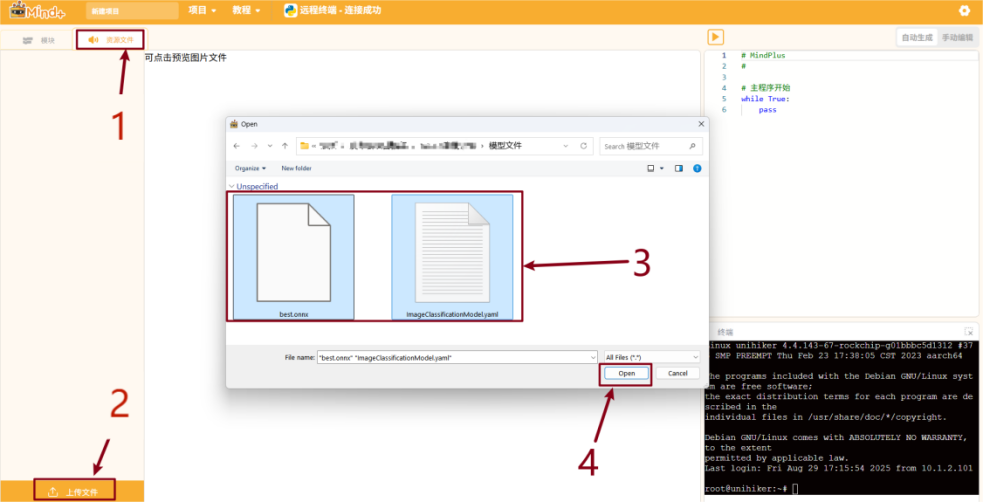

第一步:请按照下面的步骤上传模型文件。

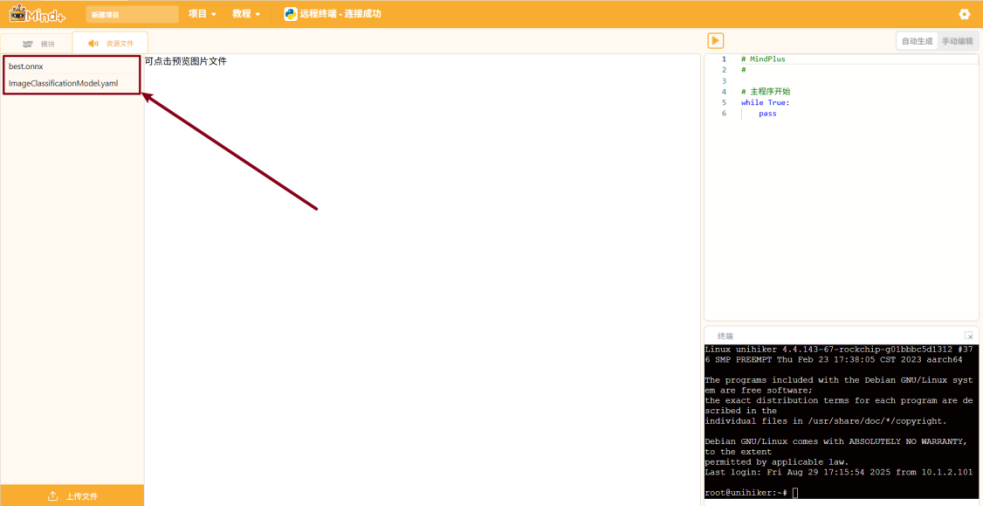

点击“资源文件”->选择“上传文件”->选择模型(.onnx)及其配置文件(.yaml)->点击“打开”。

模型文件上传成功。

同样的方法,图像识别人脸

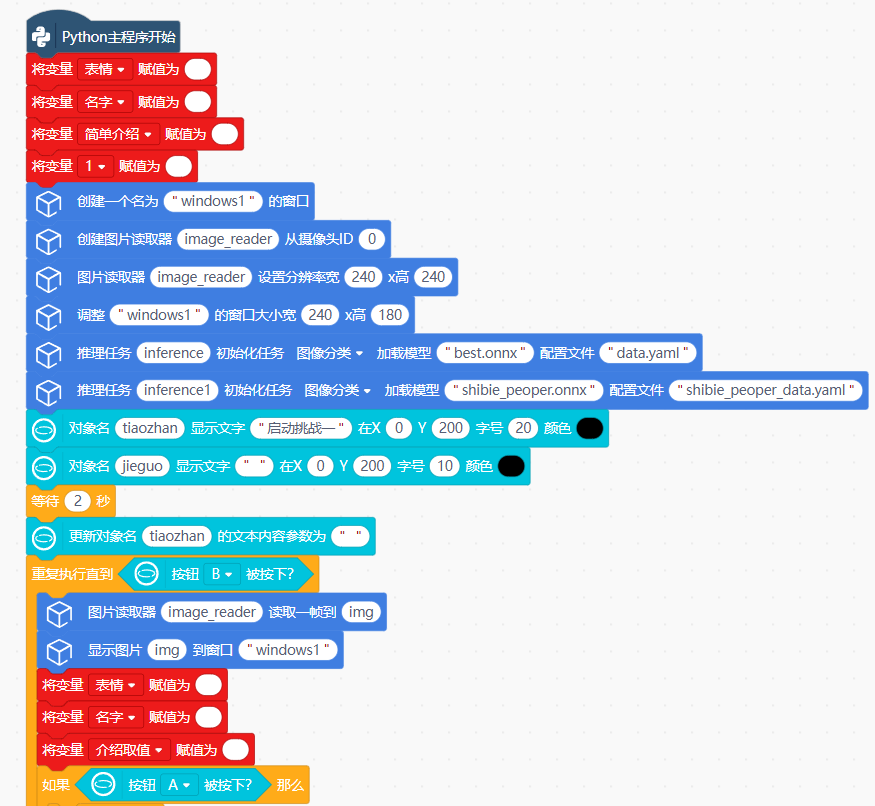

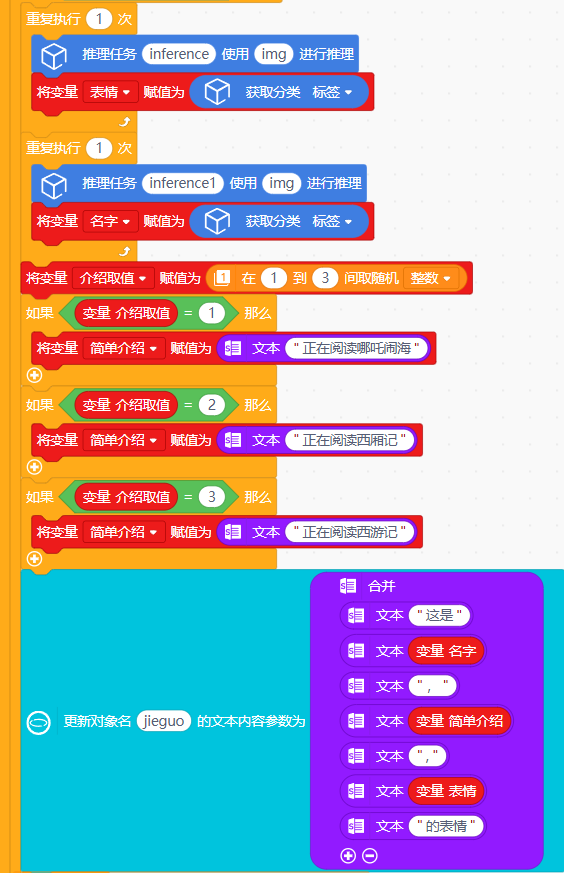

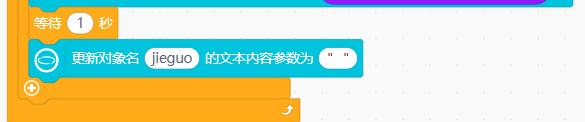

(2)编写程序

四、项目延伸方向

项目落地后,可基于现有技术框架,延伸至更多场景:如智能驾驶中的驾驶员疲劳、情绪监测(防范危险驾驶);线上教育中的学生注意力、情绪监测(辅助教师调整教学节奏);心理健康测评中的情绪数据采集(为心理评估提供客观依据),进一步拓展项目的应用价值与市场空间。

下载链接:通过网盘分享的文件:模型与代码.rar

链接: https://pan.baidu.com/s/1COYECBaQGBBmic0XZ9NfYw?pwd=5py9 提取码: 5py9

返回首页

返回首页

回到顶部

回到顶部

评论