1.项目介绍

1.1演示视频

1.2项目背景

学过一段时间尤克里里,它小巧柔和,我一直想把音乐和AI结合做个项目。我特别喜欢《茉莉花》,曲子简单、旋律温柔,和尤克里里音色很搭。于是就有了想法:用AI姿态分类技术,实现无实物弹奏交互,不用实体琴、对着镜头做姿态,AI识别后就能发出《茉莉花》的旋律,算是兴趣和技术结合的一次小尝试。

1.3项目说明

本作品通过 AI 姿态识别,触发《茉莉花》旋律播放。用户点击绿旗启动程序后,将通过摄像头捕捉人体姿势:识别到姿势 1 播放第一段旋律,识别到姿势 2 播放第二段旋律,识别到姿势 3 播放第三段旋律,完成整首乐曲的交互演奏。

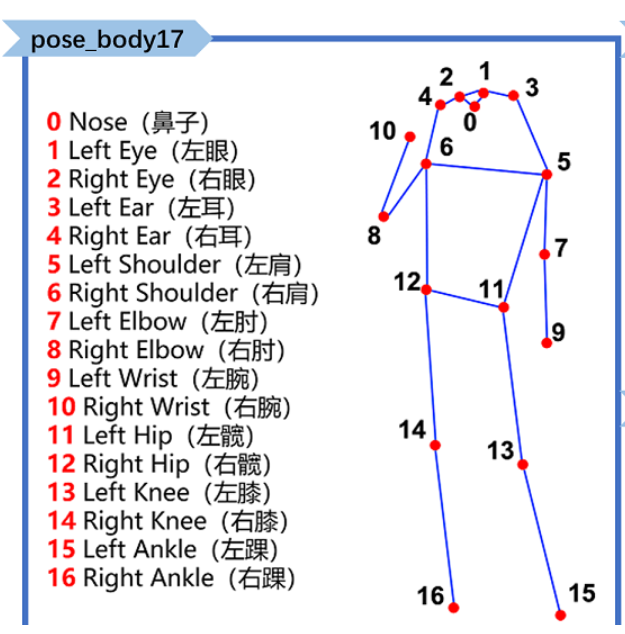

2. Mind+ V2姿态分类功能简介

姿态分类是一种基于人体关键点信息的智能识别功能。通过对图像或视频中的人体姿态进行分析,系统能够将不同的动作或姿态划分到预设类别中。例如,判断一个人是“站立”“挥手”还是“下蹲”。与普通动作识别不同,姿态分类更关注身体各部位的相对位置和动作模式,因此不仅能识别静态姿势,还能支持体感交互,实现与用户的实时互动。

应用场景:

- 运动健身:识别跑步、深蹲、俯卧撑、瑜伽等运动姿势,帮助用户纠正动作。

- 健康监测:检测坐姿、站姿或睡姿,提醒不良姿势,辅助办公或康复训练。

- 智能交互:通过特定手势或身体姿势控制设备,例如挥手切换页面、抬手接听电话。

- 教育与训练:用于体育教学或舞蹈训练,分析动作标准度并提供反馈。

- 安全监控:检测危险姿势(如弯腰过度、跌倒),实现实时报警与安全防护。

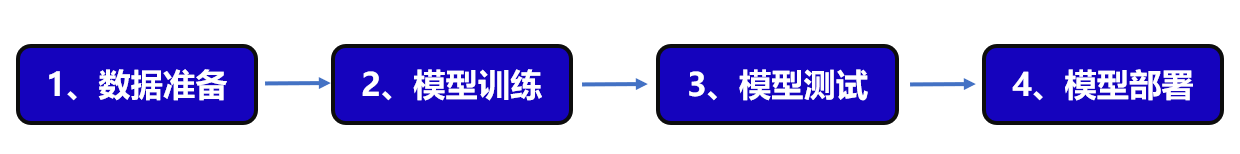

3.创作过程

3.1创作思路

3.2下载软件及创建训练项目

Mind+官方下载 - 一站式满足程序设计、模型训练、界面设计。

新建项目——模型训练——姿态分类

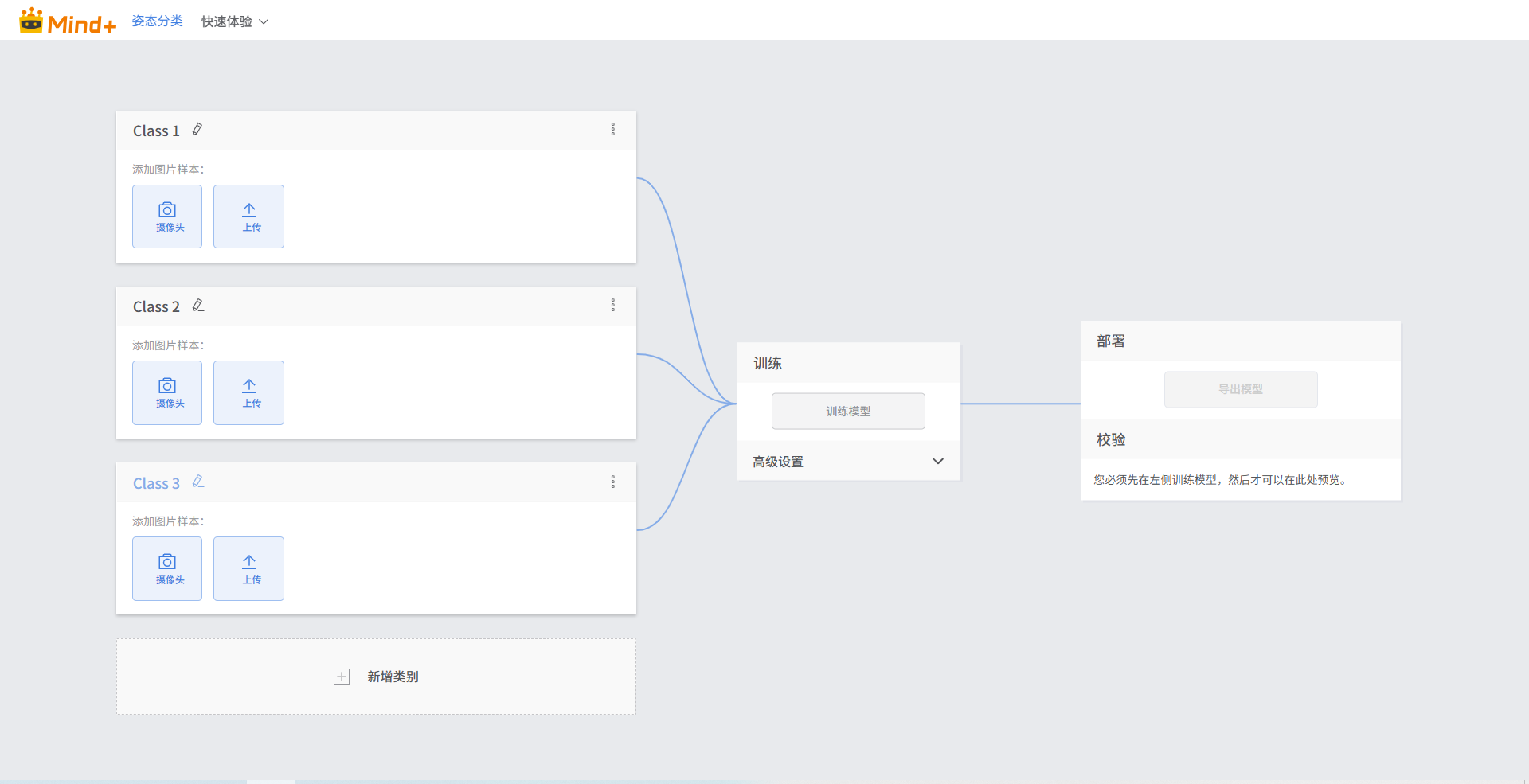

3.3数据准备

·标签设置

Class 1、Class2、Class 3均可修改名称,改成自己需要的类别名称

·数据采集

数据的采集可以通过摄像头采集也可以通过本地上传数据。

本作品每个类别50张图片样本,每个类别建议100-200图片样本。

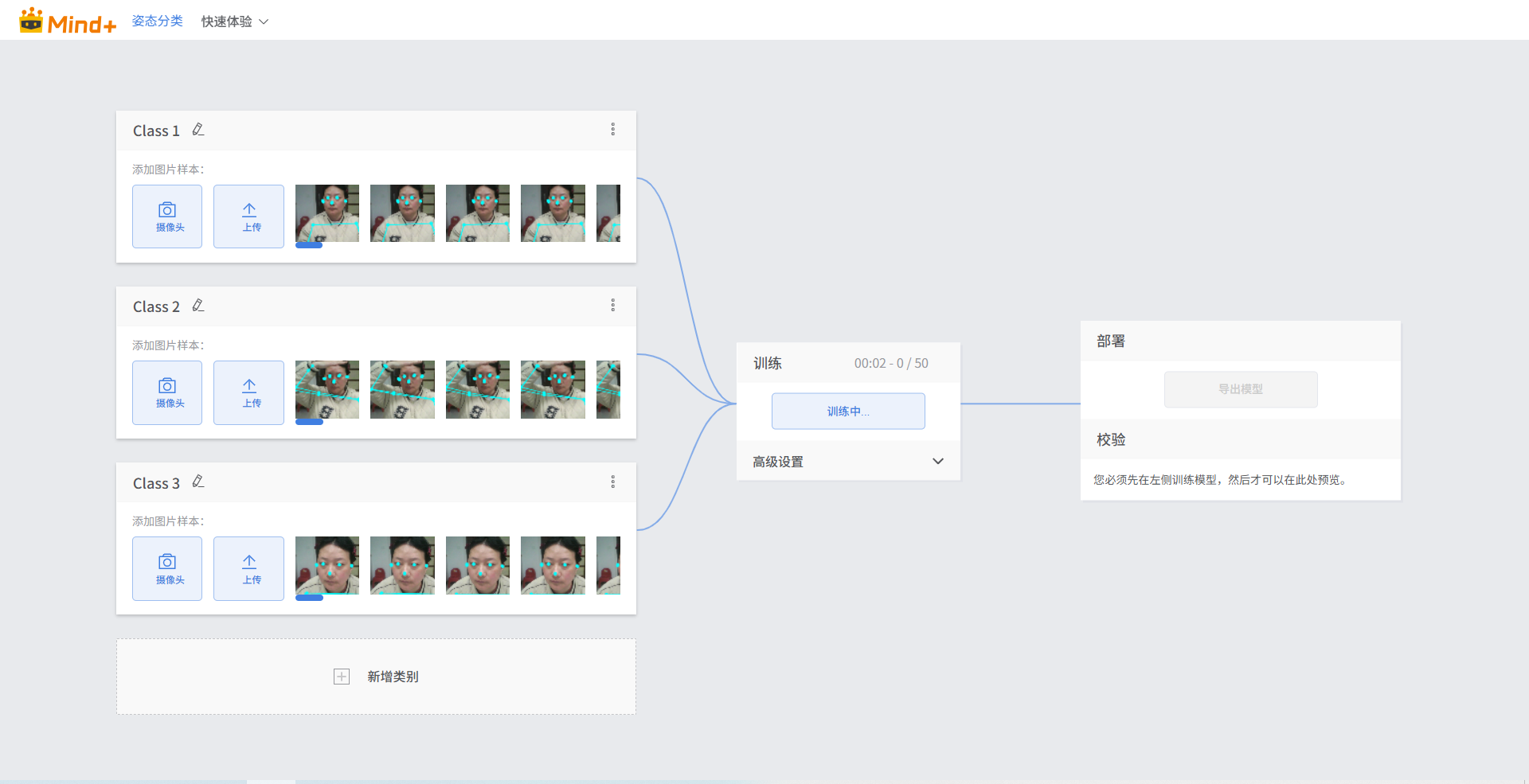

3.4模型训练

·训练模型

点击“训练模型”按钮,即可开始训练模型。

·点击“高级设置”按钮,可进行参数设置。

·训练过程与结果观察

3.5模型校验

·单张图片测试

选择“文件”,点击“点击上传文件”,选择一张没有训练过的图片进行校验。

·实时测试

选择“摄像头”,进行实时目标检测。

·模型优化与再训练

当模型校验结果不理想时,我们可以通过数据质量优化,模型参数调整等方法,再次训练模型。

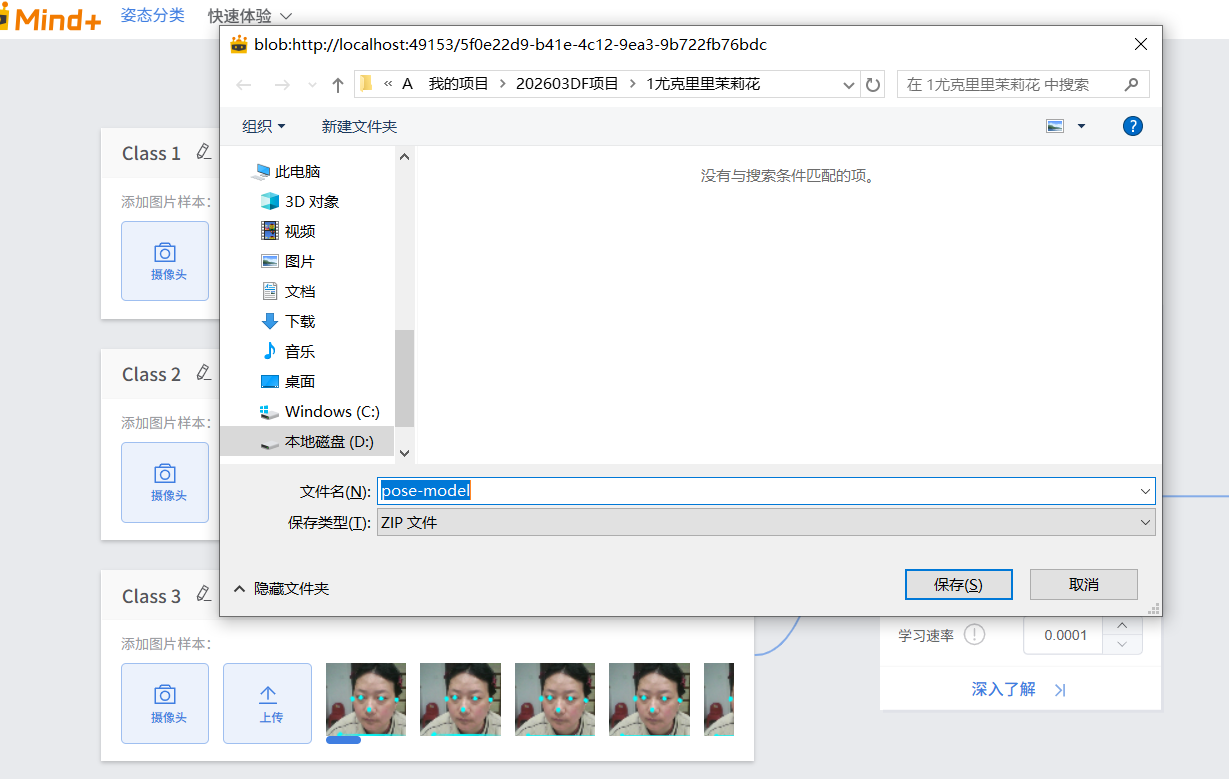

3.5模型导出

4.模型部署

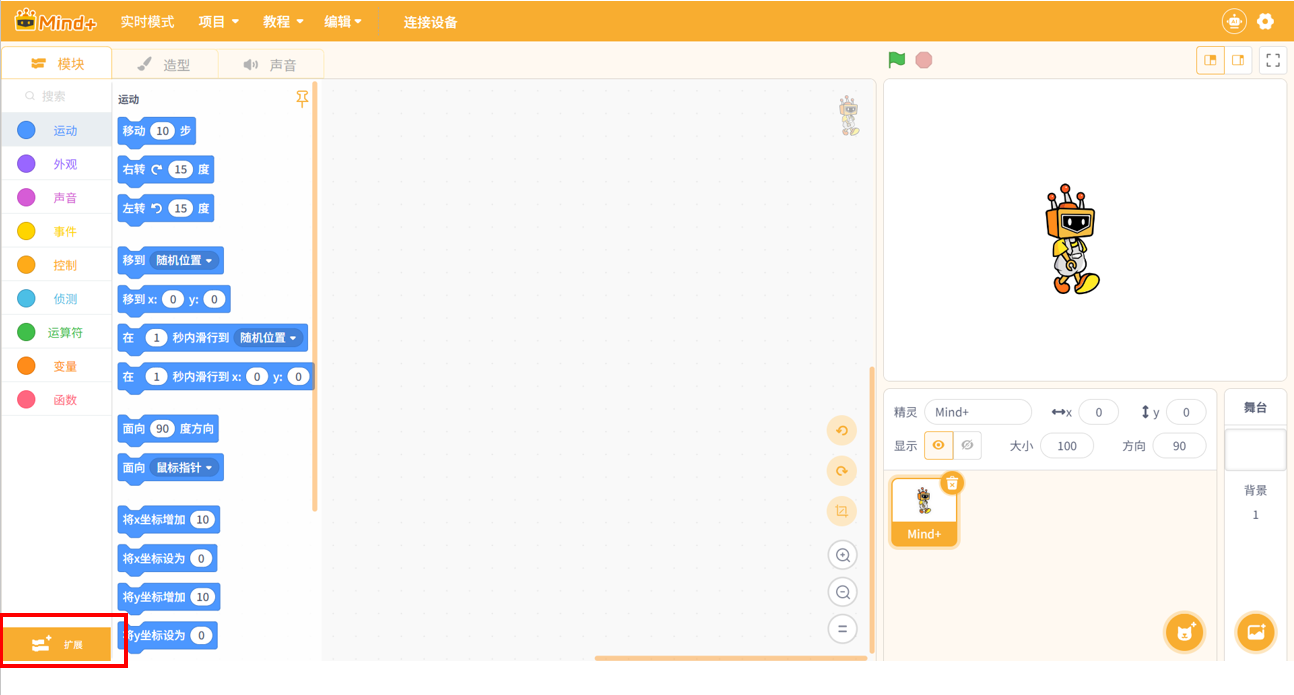

4.1程序编辑

新建项目后,点击扩展,找到模型训练推理库

4.1完整程序

5.项目总结

5.1素材采集

·角色、背景均由AI生成

·声音素材均由作者弹奏录音

5.2项目拓展

本项目以 AI 姿态分类为核心,实现了无实物音乐交互,易上手的 AI + 音乐创意实践。项目结构简洁、门槛低,无需复杂硬件与环境,普通学习者都能按流程完整复现,对入门 AI 交互的同学具有很好的参考价值。

同时项目具备很强的拓展与泛化能力,可自由替换旋律、修改姿态数量、切换主题风格,非常适合在校园教学中使用。教师只需设定音乐类主题,就能引导学生自主创作,让 AI 创意项目更易落地、更有乐趣。

附件

附件

附件

返回首页

返回首页

回到顶部

回到顶部

孙洪尧19852026.03.31

我特别羡慕彤彤老师的创意和态度,向你学习

tongtong203362026.04.01

感谢孙老师,我们一起学习

恩果2026.03.23

多才多艺😄