1.项目总览

1.1项目介绍

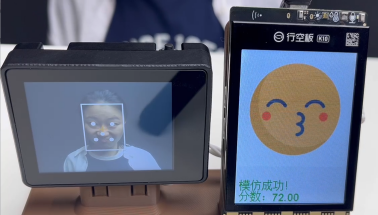

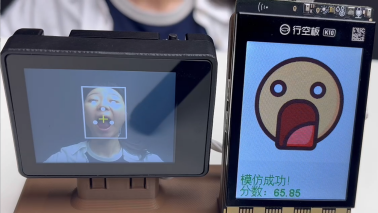

本项目将打造一个智能互动装置,实现对你表情模仿的评定和打分。该项目不仅仅是对人脸的识别,它会先精准捕捉你脸上的五官关键点:比如嘴巴张多大、嘴角扬多少、眼睛距离多远等等。接着根据这些关键点的位置,计算出你模仿的表情像不像;最后再拿你的表情数据和标准emoji表情数据对比,得到一个分数。快来和朋友用它比一比谁学emoji表情更像吧!

更有意思的是,这个从“日常表情互动”出发的小项目,还能灵活变身,适配更多场景:在艺术培训机构,它能帮学表演、播音的学生精准矫正表情,比如判断“悲伤时嘴角下垂的幅度够不够”、“愤怒时皱眉的力度对不对”,让练习更有针对性。从模型推理,到数据计算,再到指令执行,这样一套流程,完整展现了人工智能技术在生活里能被轻松落地实践,让人脸识别技术变得能被触摸、能互动起来,还更有乐趣!

1.2演示视频

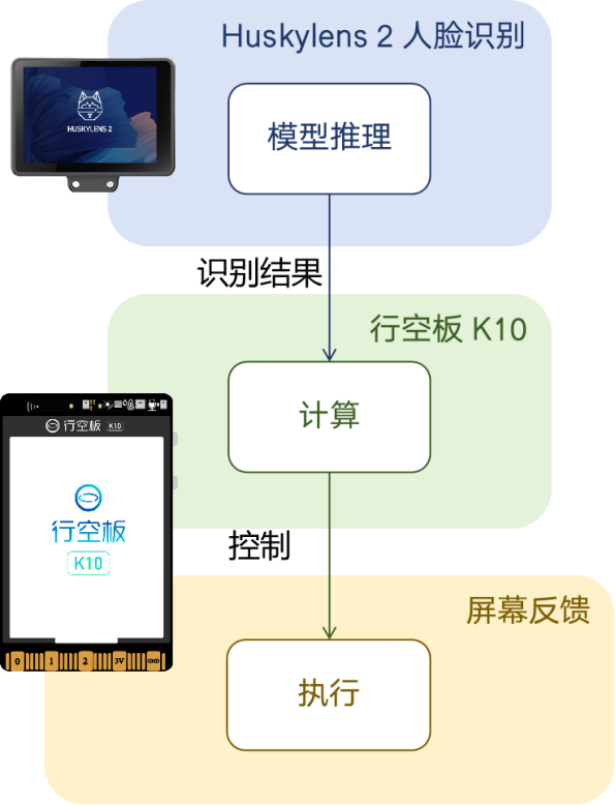

2. 项目实现原理

它的核心逻辑如下:人工智能摄像头(二哈识图2)中内置了人脸识别的模型,该模型不仅能识别人脸,还可以获取人脸关键点的坐标。当你对着二哈识图2模仿表情时,二哈识图2中的模型会实时推理出你面部的五官关键点,再把这些关键点数据传递给行空板K10,接着行空板对“你模仿的表情数据”和“标准答案卡数据”做计算,比对出两者的相似度,最后根据计算出的相似度来进行反馈和打分:要是相似度高,就给出“模仿成功”并给出分数。

3.软硬件准备

3.1软硬件器材清单

注意:Mind+编程软件版本为v2.0,HuskyLens的版本为二哈识图2。

3.2硬件连接

请按照下方连接图,将电脑、行空板K10、二哈识图2进行连接。

3.3软件平台准备

官网下载安装Mind+2.0及以上版本安装包,安装完成后,双击打开。

4.项目制作

4.1二哈识图2操作

首先,由于出厂语言默认为英文,我们可以使触屏的方式左右滑动,找到“System Settings”(系统设置)图标,将系统语言设置成自己想要的语言(支持英文,中文简体和中文繁体)。

点击进入“System Settings”,下滑至底部找到“Language”选项。点击“Language”,进入设置语言界面。

点击自己想要的语言选项。之后,系统会切换语言并自动返回至菜单页面,如下图是切换为中文简体的示意图。

其次,选择二哈识图2的通信方式。

二哈识图2支持UART(串口)和I2C两种通信方式,本教程中使用I2C通信模式。

点击系统设置->协议种类->选择I2C通讯模式后返回主菜单界面。

最后,滑动屏幕,找到“人脸识别”功能。

将二哈识图2对着含有人脸的画面,检测到人脸时,屏幕上会用白色方框,框出画面中的所有人脸,并显示人脸关键点(注意:二哈识图2才支持人脸关键点坐标的获取)。

二哈识图2的更多详细使用方法见下面的网址:

https://wiki.dfrobot.com.cn/_SKU_SEN0638_Gravity_HUSKYLENS_2_AI_Camera_Vision_Sensor

二哈识图2中的参数配置以及模式选择完成后,即可开始编写代码,实现一个基于人脸识别的表情模仿评分机。

4.2代码实现

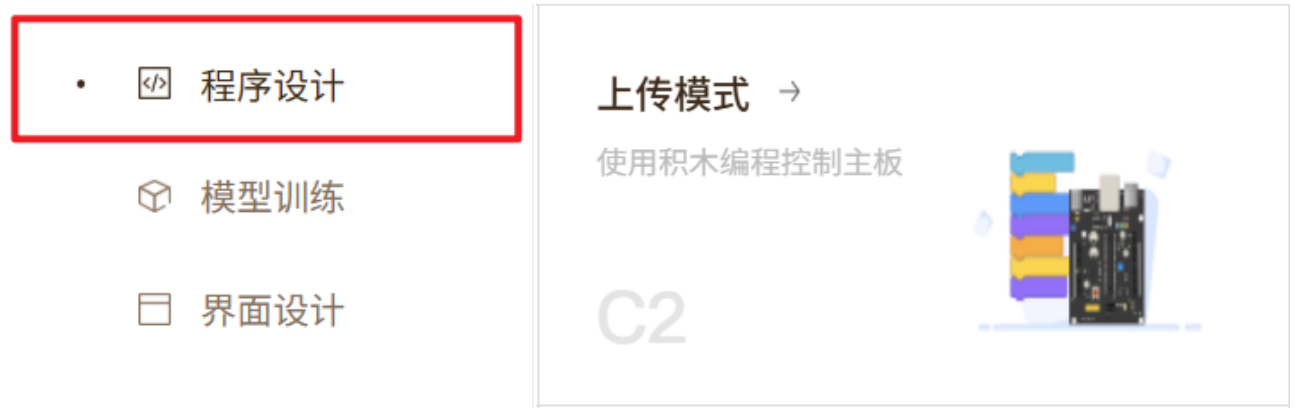

打开编程软件Mind+,选择“程序设计”中的“上传模式”。

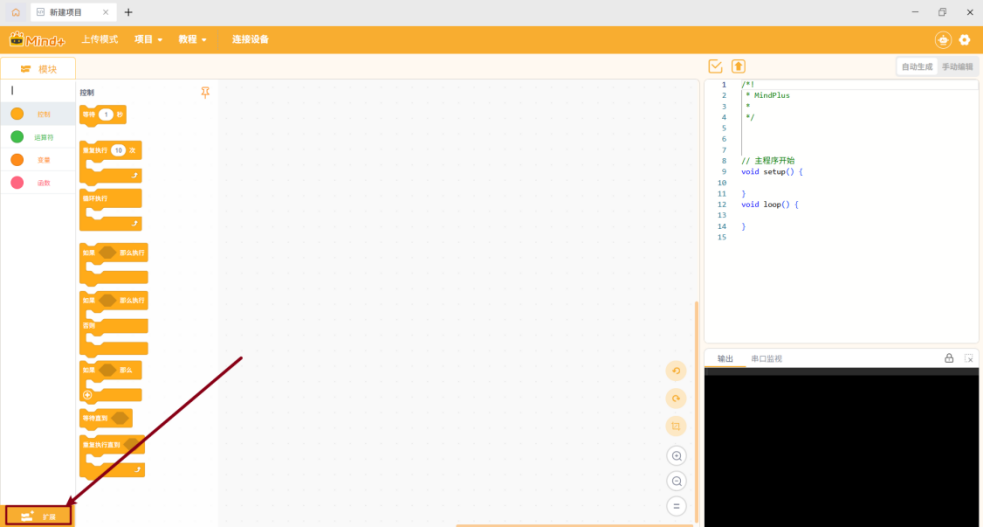

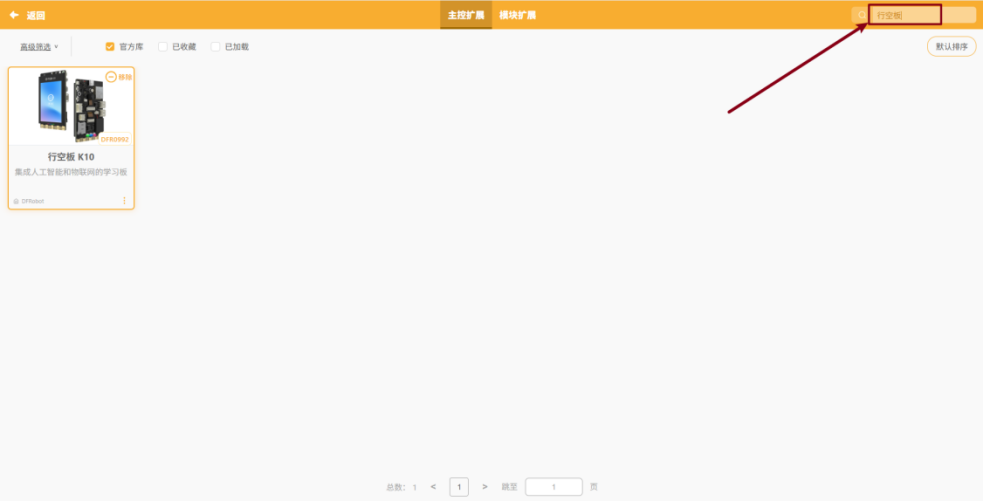

首先,我们需要在Mind+中添加相应的扩展,包括行空板K10和二哈识图2。

进入“扩展”页面并搜索“行空板K10”。

点击扩展包上的“下载”按钮,等待下载完成。

点击该扩展包完成加载。

按照加载“行空板K10”的步骤加载用户库“Huskylens2 AI摄像头”。

“行空板K10”和“Huskylens2 AI摄像头”的用户库加载完毕后,

点击“返回”按钮返回编程界面。

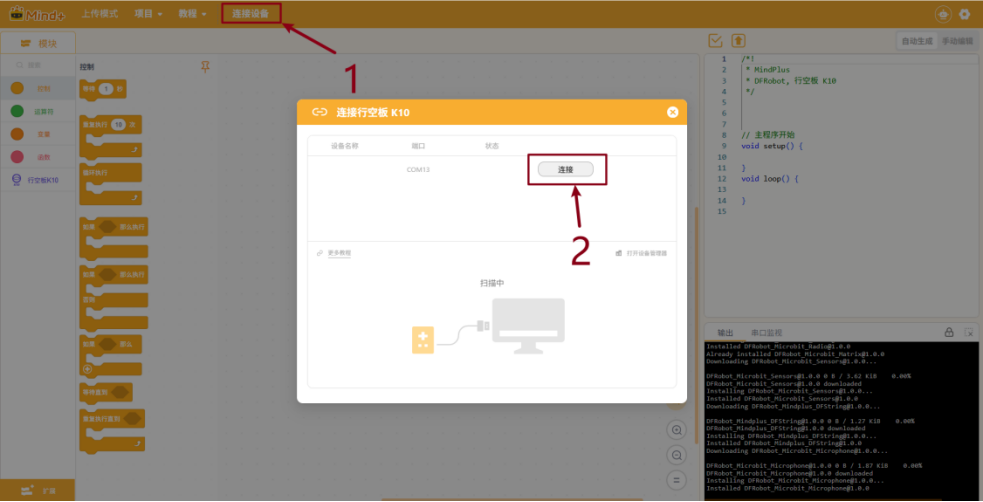

在连接设备中点击“连接”。

连接成功界面如下,点击“×”返回。

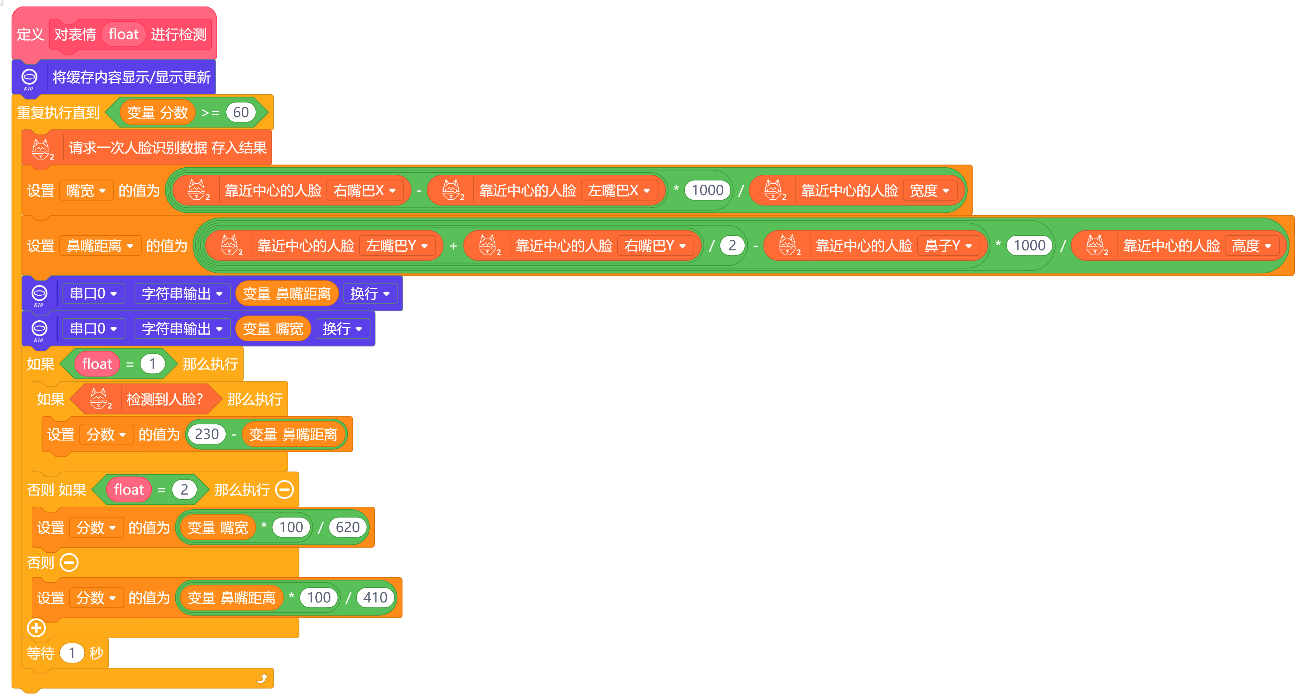

设备连接成功后,编写程序如下:

核心代码解析如下:

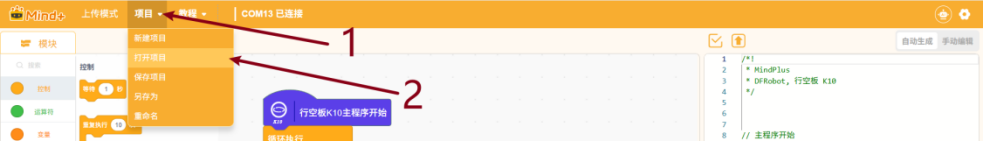

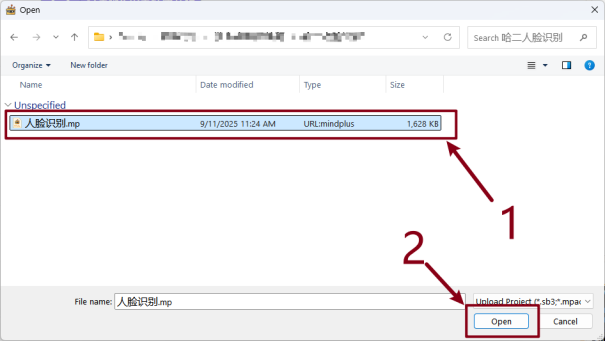

附件中有该项目的完整程序文件,展开项目,点击“打开项目”。

选择附件中的项目,并点击“打开”。

点击“上传到设备”运行程序。

程序上传成功后,将二哈识图2设置为“人脸识别”模式。

实现效果如下:

5.附件清单

文件链接: https://pan.baidu.com/s/1mi1VAqBfQqM-tdzCifJbag?pwd=y6jn

返回首页

返回首页

回到顶部

回到顶部

罗罗罗2025.11.16

666