一、项目背景

1.1 项目介绍

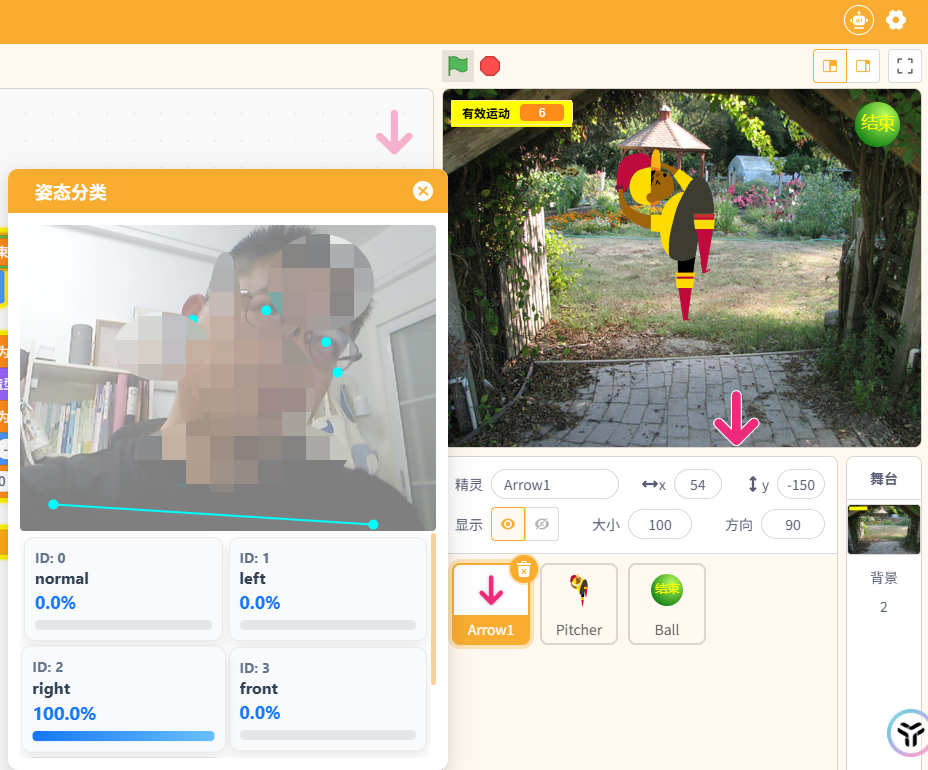

本项目基于 Mind+ V2 的姿态分类模型训练功能,训练了一个能够识别头部姿态的 AI 模型。使用者只需坐在或站在摄像头前,通过头部向前、向后、向左、向右四个方向的自然转动,就能实时触发颈部锻炼引导,完成针对性的颈部舒缓与锻炼动作。

不需要任何额外设备——你的头部姿态,就是颈部锻炼的“控制器”。

1.2 设计理念

这个项目源于对当代人颈部健康问题的深度思考:

💻 颈部劳损怎么缓解? 现代人日常久坐办公、低头看手机,每天保持固定姿势6-10小时,颈部肌肉长期紧张,易引发酸痛、僵硬甚至劳损问题。

🧘 锻炼能不能便捷化? 多数人没有专门的时间和场地进行颈部护理,能不能让“碎片化休息”与颈部锻炼结合,无需刻意准备就能完成舒缓?

🏠 不便外出怎么办? 久坐人群(办公室职员、学生、居家办公者),无需外出、无需专业器械,利用日常间隙就能完成颈部锻炼,避免因忙碌忽略颈部健康。

头部姿态识别颈部锻炼项目,就是对这些问题的探究:仅需一台电脑和一个摄像头,在任何室内空间(办公室、教室、卧室、书房),就能通过头部姿态识别,实现便捷、高效的颈部锻炼。同时,整个项目从体验头部姿态控制锻炼、图形化积木编程搭建,到认识头部姿态分类原理、数据采集、模型训练和部署应用的全流程,都可以手把手带使用者完成,兼顾健康与科普,寓教于乐、寓练于闲。

二、 姿态分类模型训练

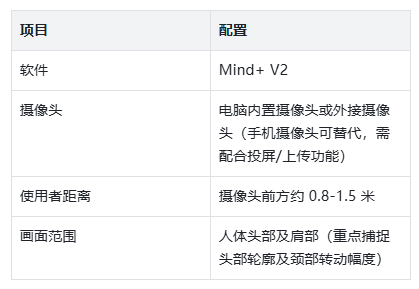

2.1 训练环境

因为前后左右的区分度是比较明显的,所以能够有效识别前、后、左、右,四个方位,但要注意距离的把控。(AI生图,请见谅)

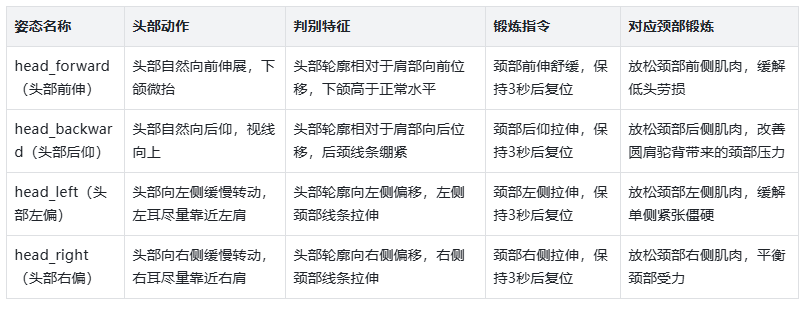

2.2 姿态类别设计

本项目设计了 4 种头部控制姿态,每种姿态对应一项颈部锻炼引导动作,无需额外控制器,头部姿态直接触发锻炼指令:

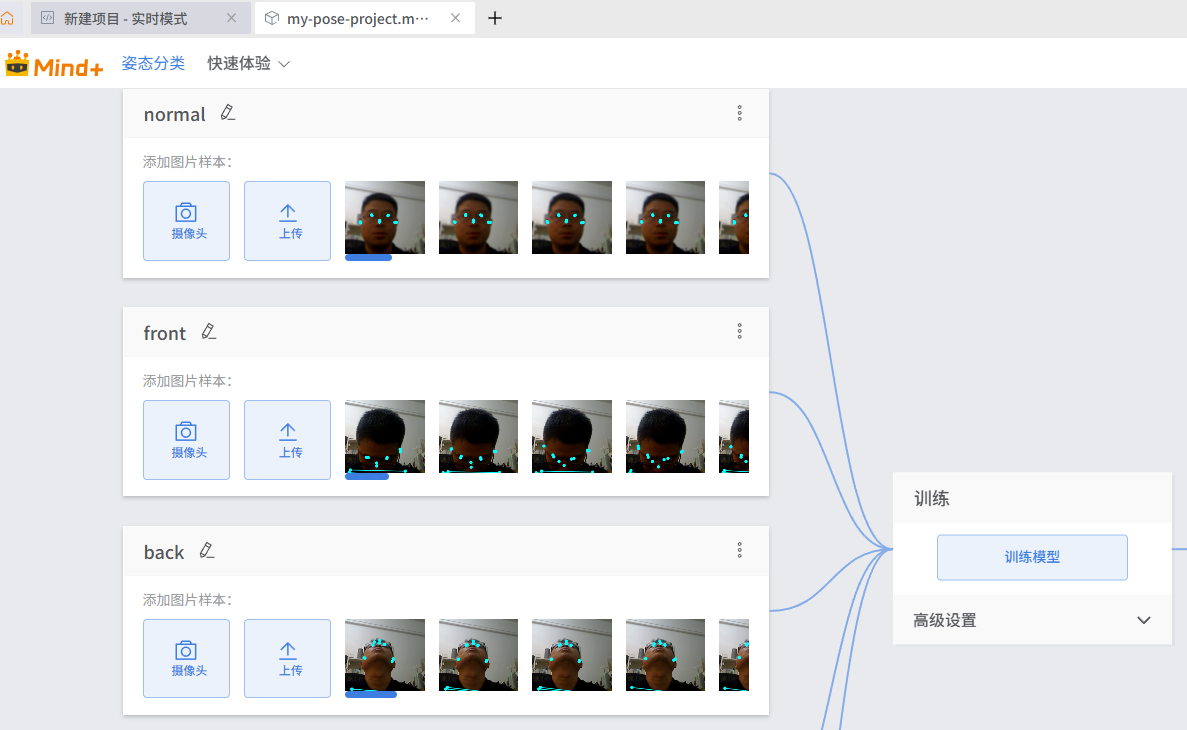

2.3 数据采集

数据采集核心是获取清晰、多样的头部姿态样本,确保模型能精准识别不同人群的颈部转动动作,步骤如下:

步骤1:新建项目

打开 Mind+ V2 → 选择姿态分类任务 → 新建项目 → 进入模型训练模块,命名为“头部姿态识别-颈部锻炼”。

步骤2:背景样本采集

新增类别,命名为“空背景”,点击“摄像头”按钮,在无人状态下采集当前使用环境(办公室、卧室等)的背景图像,采集数量建议30-50张,覆盖不同光线条件(如自然光、灯光)。

步骤3:姿态样本采集

新增4个类别,分别命名为“头部前伸”“头部后仰”“头部左偏”“头部右偏”,逐一采集对应姿态样本,每个类别需保证样本多样性(不同角度、不同力度的转动)。同时为了区分,还要新增,正常状态下的一个分类。

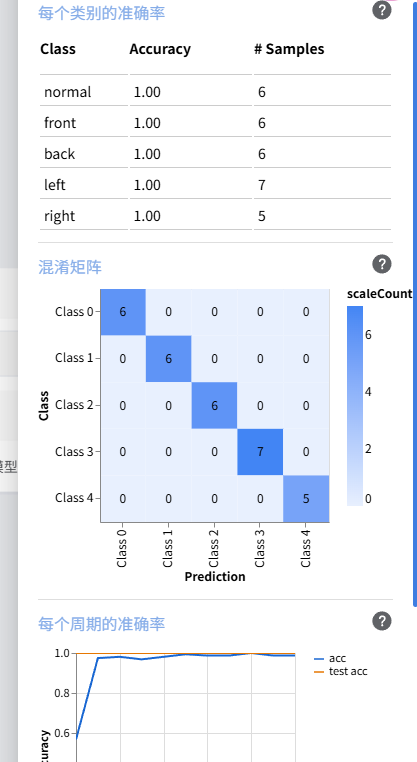

参数保持默认即可。训练发现,准确率是很高的。

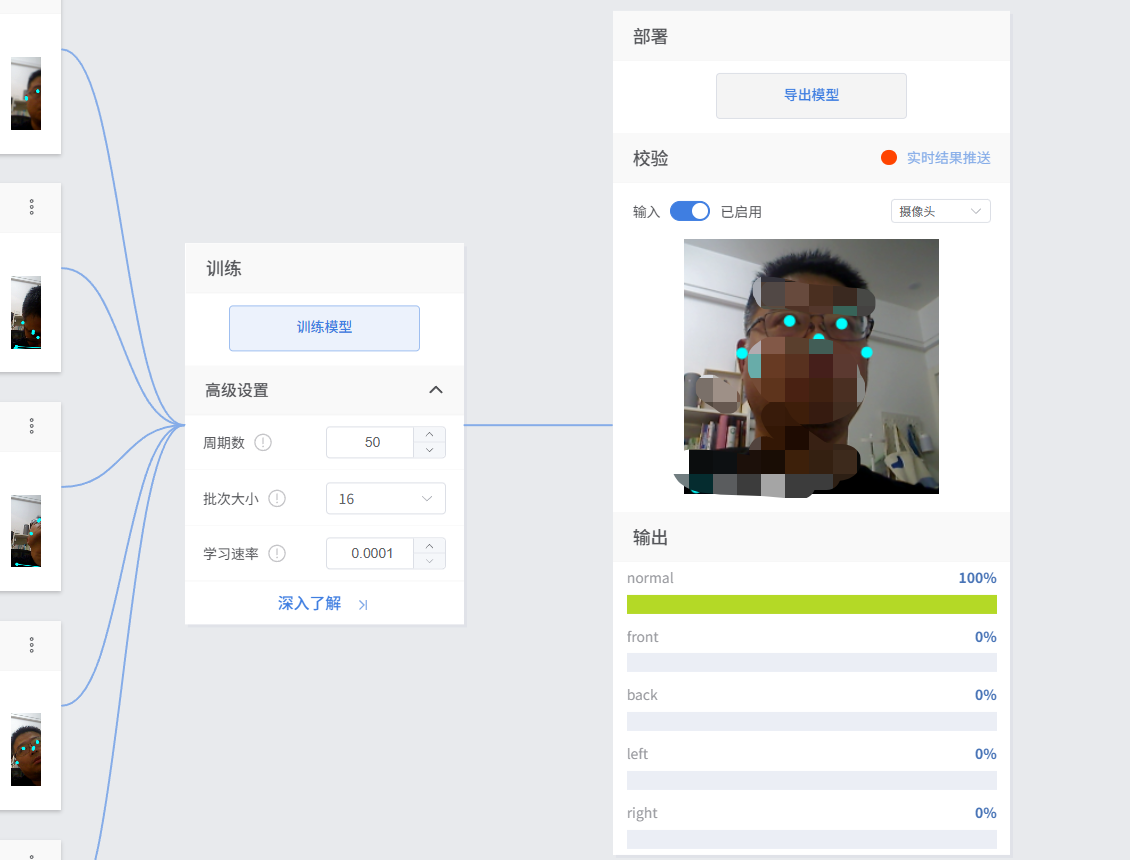

2.5 模型校验

切换到“摄像头”校验模式,使用者站在摄像头前方0.8-1.5米处,依次做出头部前伸、后仰、左偏、右偏四个姿态,每个姿态保持3-5秒,观察屏幕上的识别结果是否准确、响应是否及时。

校验标准:四种姿态识别准确率≥90%,无明显误触发、无延迟(响应时间≤0.5秒)。校验通过后,点击“导出模型”,将模型导出文件保存到项目文件夹中,便于后续部署应用,实现颈部锻炼的实时引导。

三、程序设计与实现

3.1 姿态识别集成

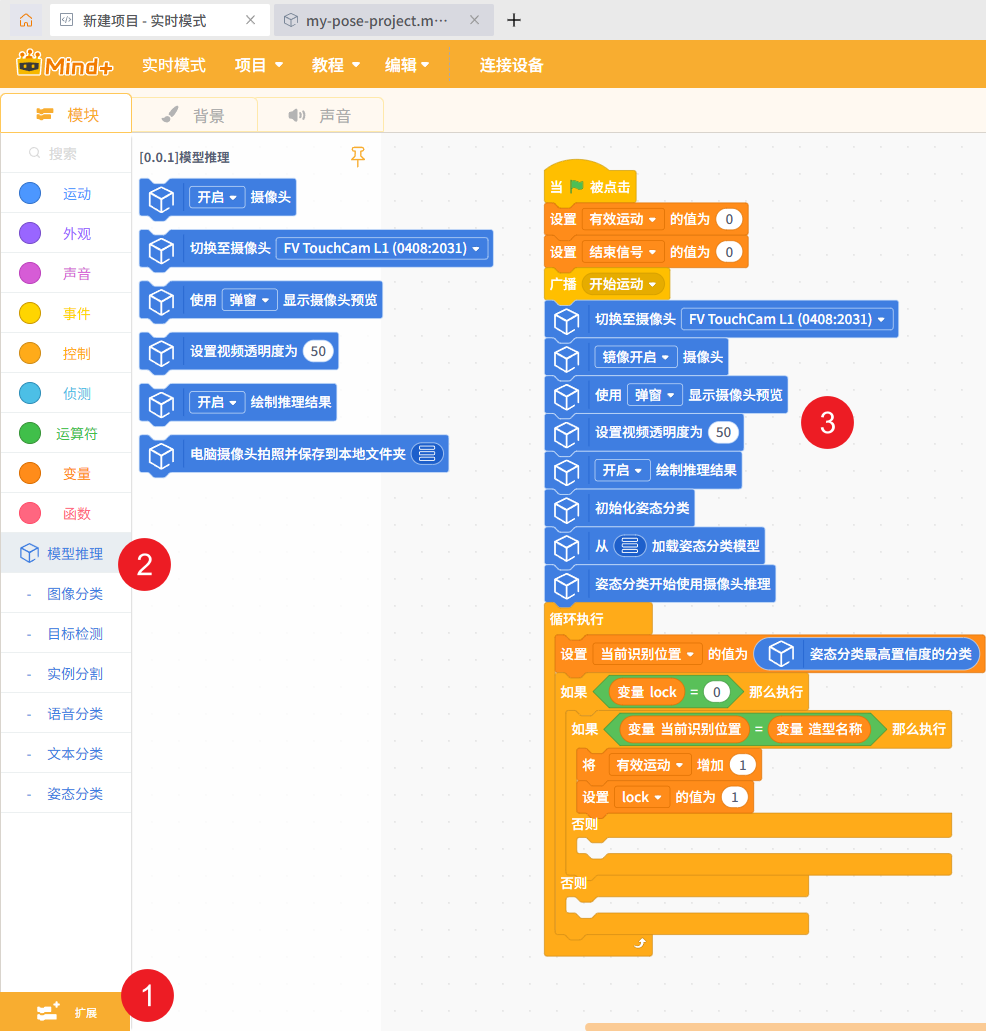

添加扩展库

在 Mind+ V2 图形化编程模式下,点击"扩展",搜索并添加模型训练推理库。初始化摄像头并载入姿态分类模型。

代码逻辑

代码逻辑主要分以下几个步骤:

循环识别,是否识别到的头颈位置和随机生成的方向相符,这里引入了 lock 锁,防止一个时间段(1秒)内,被重复识别。

随机生成方向位置。

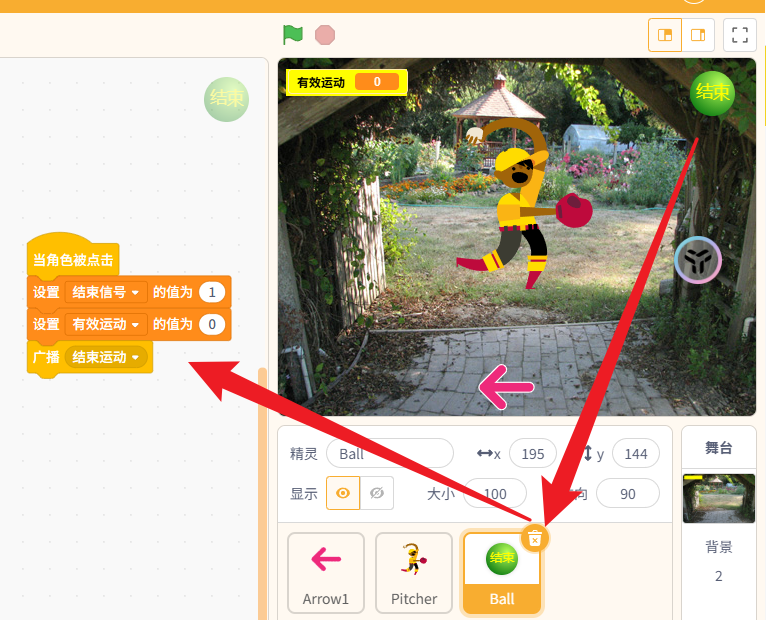

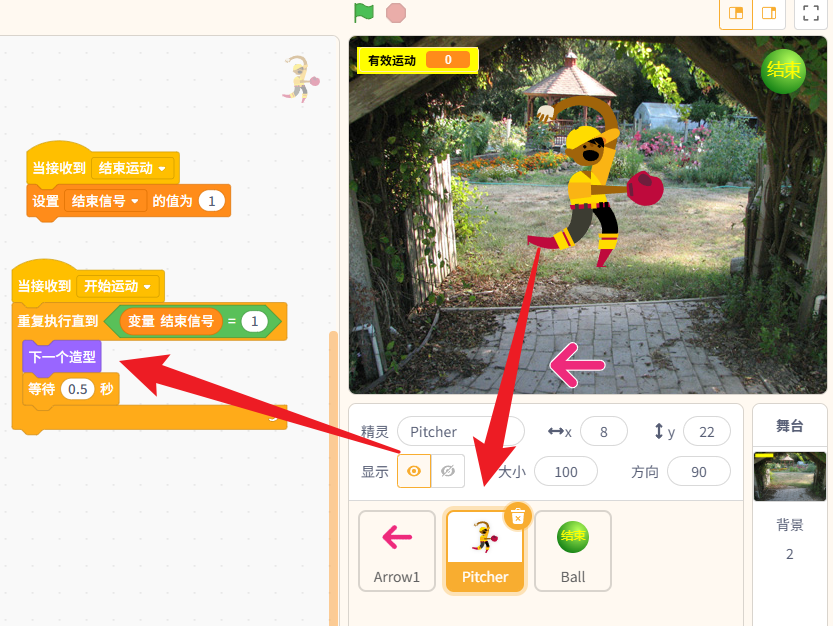

其它代码比较简单,结束按钮主要设置两个变量的值。

人物造型就是 动次打次,动次打次

四、项目总结与拓展

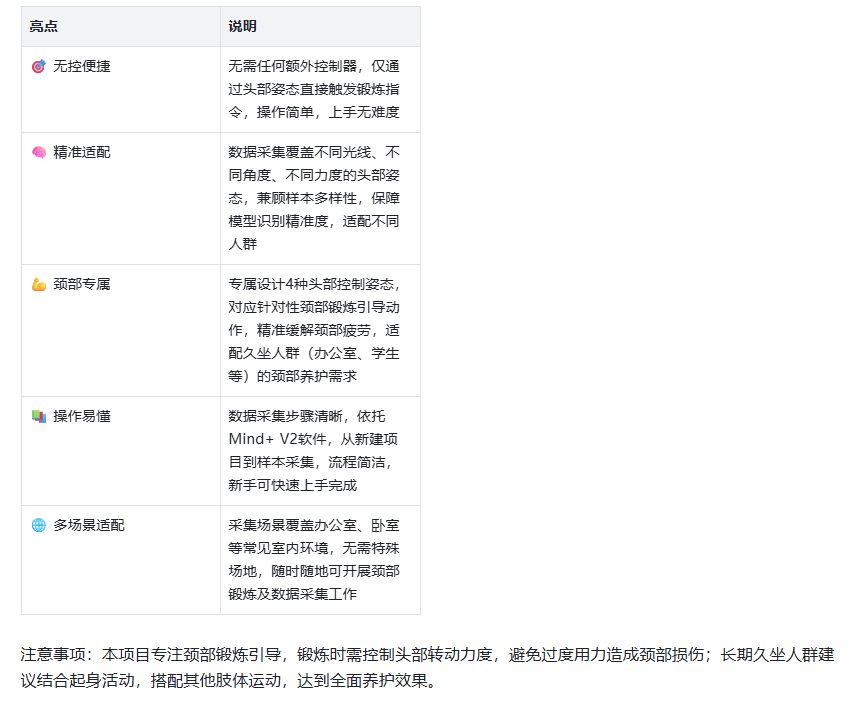

4.1 项目亮点

4.2 拓展方向

优化数据采集流程,增加样本采集数量建议(如每个姿态类别采集50-80张),新增样本质量校验功能,筛选模糊、不合格样本。

新增姿态锻炼计时功能,可设置单次锻炼时长,搭配语音提示,引导用户规范完成颈部锻炼动作。

增加姿态识别灵敏度调节功能,适配不同人群(如老人、青少年)的头部动作幅度,提升使用体验。

新增锻炼数据统计功能,记录每次锻炼的姿态完成次数、时长,生成颈部锻炼周报/月报,直观呈现锻炼效果。

拓展多设备适配,支持手机摄像头采集样本及触发锻炼指令,打破电脑设备限制,提升便捷性。

新增错误姿态纠正功能,当用户头部转动角度、力度不当时,发出语音提示,引导用户调整至标准姿态。

其它:

因为涉及到人脸打码麻烦,视频就不放了。虽然看起来是比较搞笑的。(指示方向1秒走完,要准备记录的话,头颈还是会手忙脚乱的)

附件

返回首页

返回首页

回到顶部

回到顶部

评论