1.项目说明

1.1创作背景

创作灵感源于自身喜好,平时喜欢听一些节奏感强的音乐,这类音乐动感且充满活力。基于此,结合图像分类技术,设计手势控制音乐项目,用简单手势实现操控,搭配彩灯和街舞动画,提升项目的观赏性和体验感,打造低成本、易实现的入门级智能交互创客小制作。

1.2功能说明

本项目核心通过图像分类技术识别两类手势,整体实现“手势操控+视觉反馈+听觉体验”的一体化,操作便捷且富有趣味性。

(1)手掌张开触发音乐播放,彩灯同步亮起,营造氛围,同时行空板M10屏幕显示跳街舞的小女生动画,与音乐节奏呼应;

(2)握拳触发音乐暂停,彩灯熄灭,动画定格

1.3演示视频

2 .项目实现原理

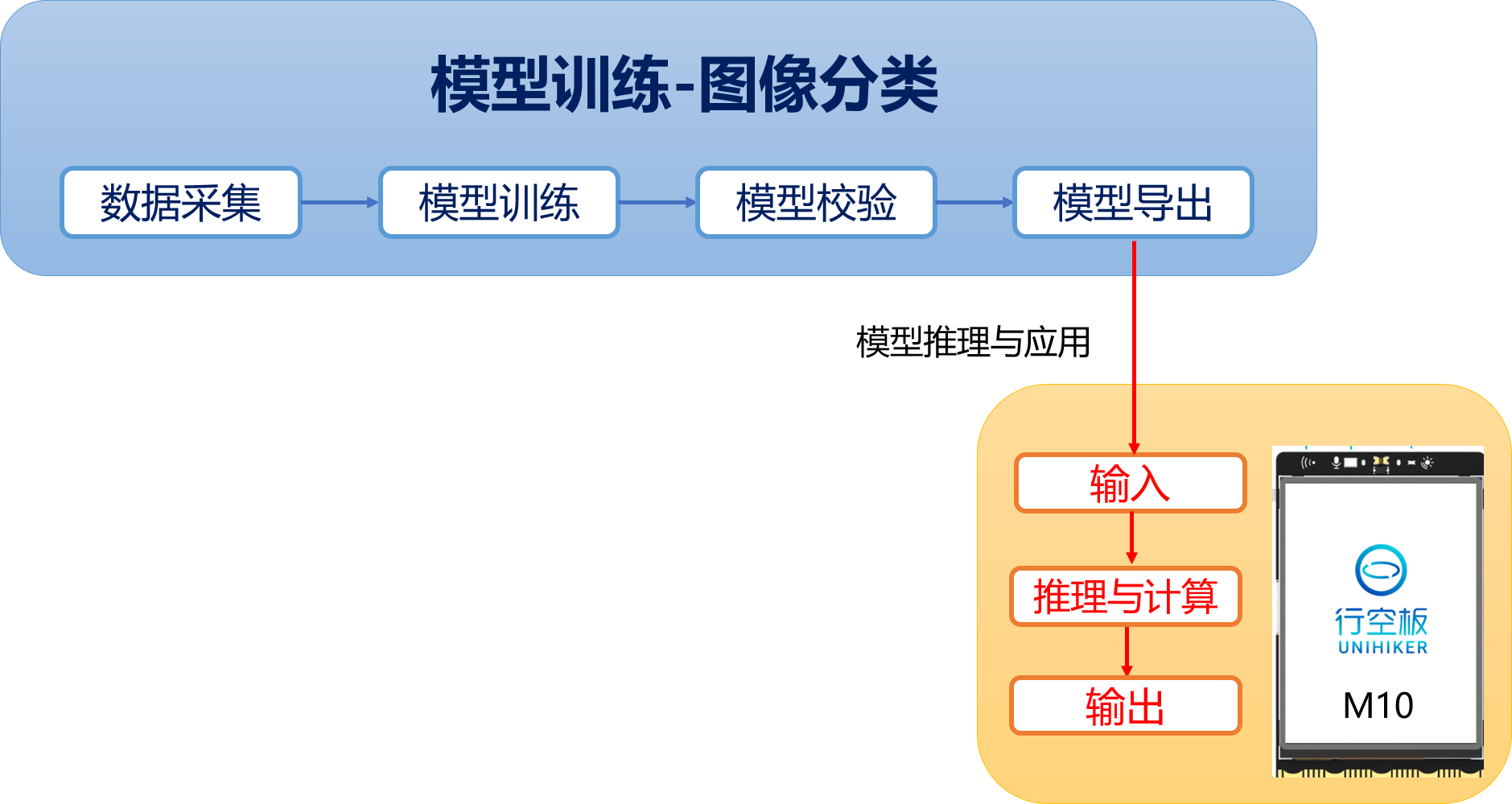

本项目基于图像分类技术实现手势识别与互动功能,整个实现过程涵盖从数据准备到模型推理与应用的全流程。

(1)通过Mind+ V2 进行图像分类模型的图像采集与模型训练;

(2)训练完成后,对模型进行校验与优化,并导出为适用于行空板M10的格式;

(3)将模型部署至行空板M10进行推理应用,利用其摄像头捕获实时画面,由模型进行推理识别,输出手势类别,并执行对应的操作。

Mind+ V2图像分类

功能简介

图像分类是人工智能中的基础任务之一,它可以让计算机自动识别图片所属类别。通过分析图片的内容,计算机能够判断图中对象是猫、狗、交通标志,或者其他指定类别。

它不仅能对静态图片进行识别,还能实时分析摄像头采集的画面,快速判断当前场景中出现的物体类别,实现动态识别和监控。这让图像分类不仅适用于照片整理和教学演示,也能应用于安防、智能驾驶、宠物识别等多种场景。

应用场景

- 物体识别:识别动物、植物、交通标志等,实现计算机对图片内容的自动识别分类。

- 工业检测:检查产品外观或发现缺陷,提高生产效率和质量控制水平。

- 教育与科研:用于快速实验、教学演示或科研数据分析,帮助理解人工智能的应用原理。

3.软硬件环境准备

3.1软硬件器材清单

注意:行空板系统版本在 v0.4.1 及以上均适用于本项目制作,行空板的 Python 环境版本为 3.12,Mind + 编程软件版本为 v2.0。

3.2硬件连接准备

本项目需在行空板上实现图像 “输入 - 推理与计算 - 输出” 流程:通过 USB 摄像头拍摄图像,在行空板部署图像分类模型完成推理与结果输出。

3.3软件平台准备

官网下载安装Mind+ 2.0及以上版本安装包,安装完成后,双击打开。

4.模型训练

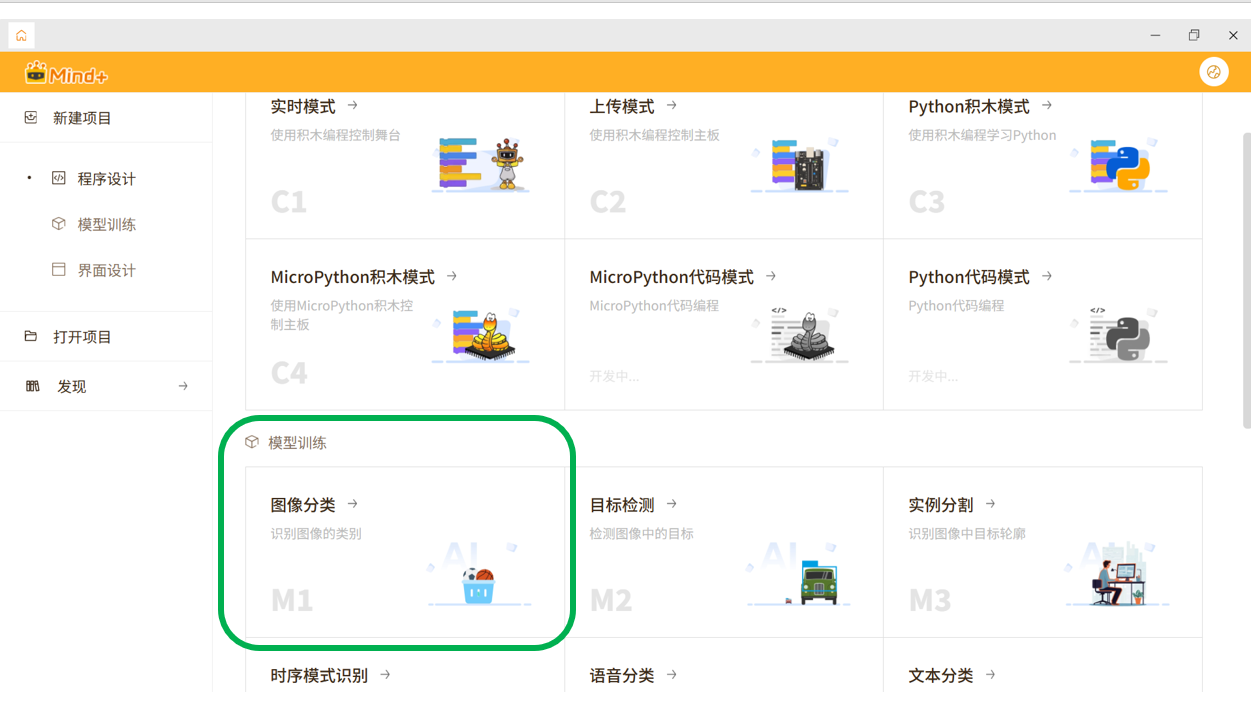

我们使用Mind+中的模型训练来完成手势的采集、模型训练和导出。

首先,打开Mind+软件,选择“模型训练”并打开“图像分类”(注意:只有Mind+2.0及以上版本才有模型训练功能)。

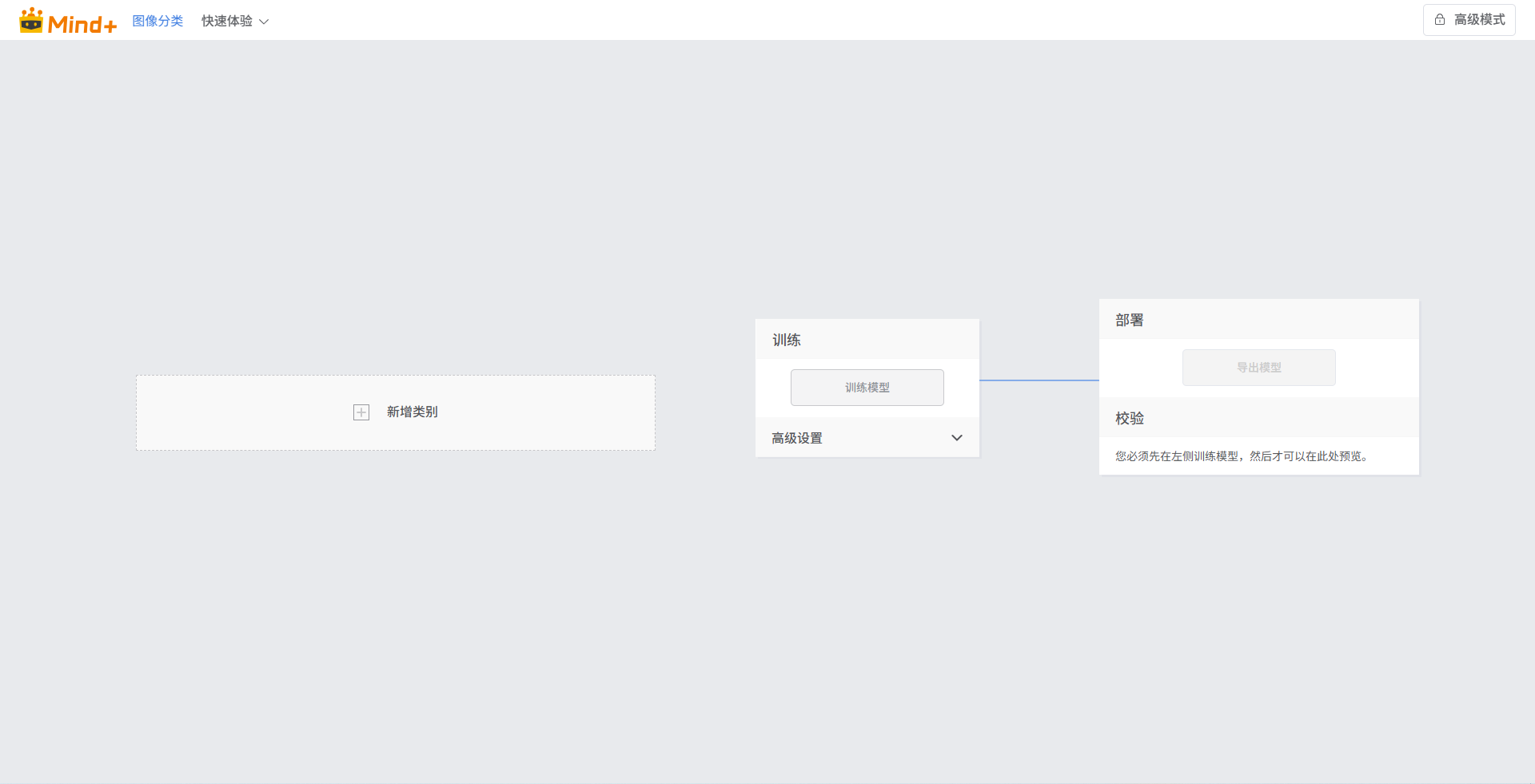

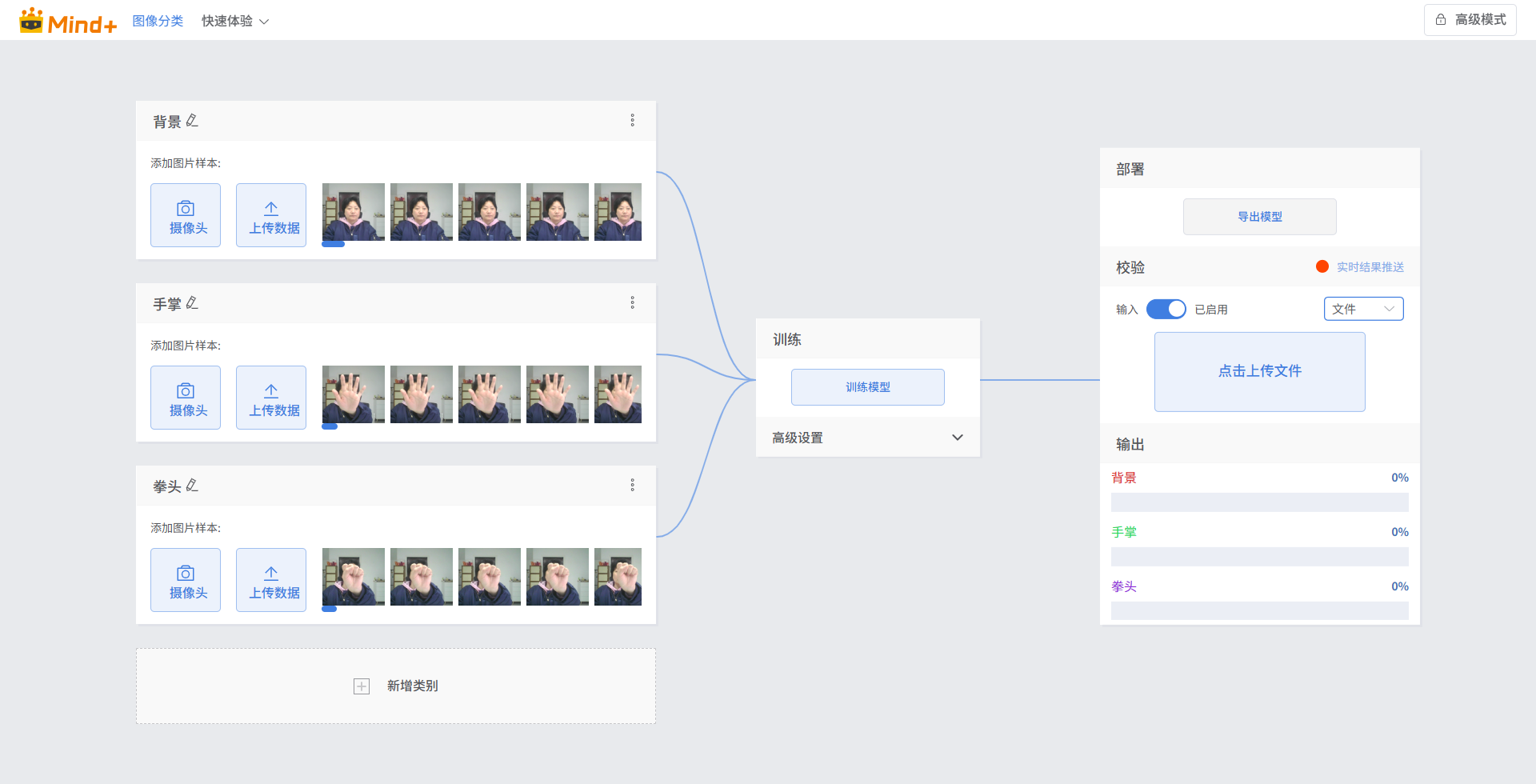

打开初始界面如下:

页面分为三部分,从左至右依次为:数据采集、模型训练、模型校验与导出(后面会详细说明各部分的使用方法)。

4.1数据采集

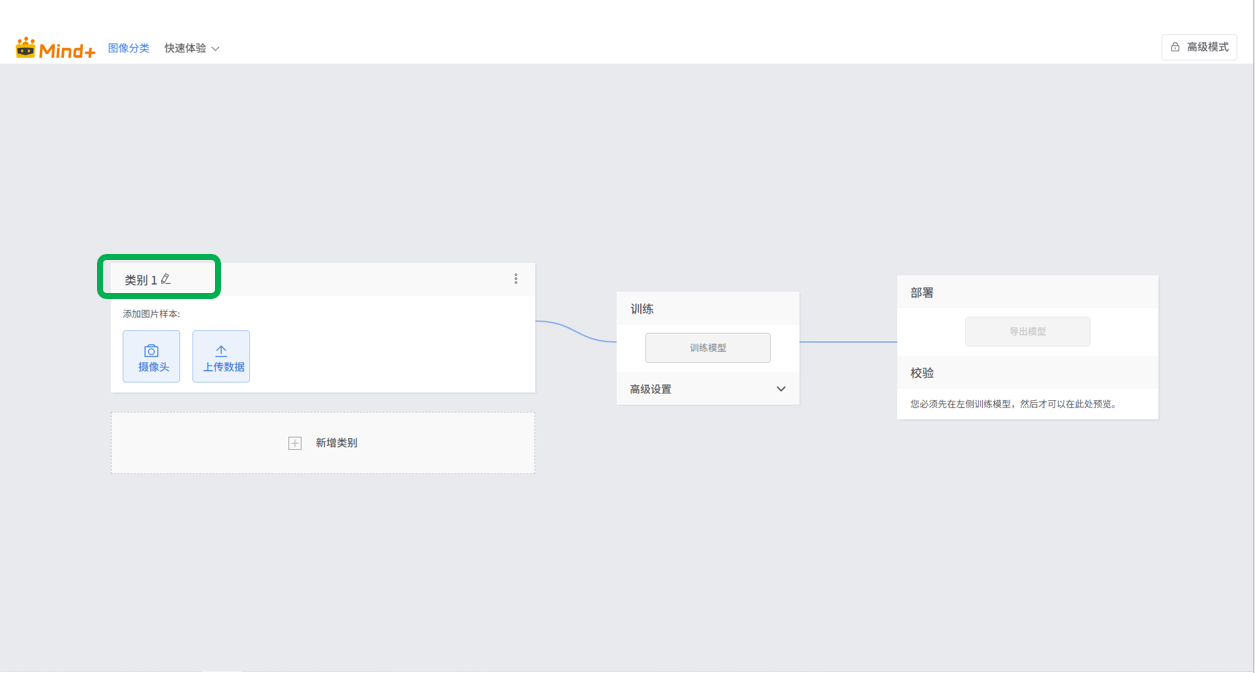

·标签设置

类别1可修改名称,改成自己需要的类别名称

本项目中使用了背景、手掌、拳头三个类别图片,所以需要添加三个类别,设置好的类别如下:

·数据采集

数据的采集可以通过摄像头采集也可以通过本地上传数据。

本作品每个类别50张图片样本,每个类别建议100-200图片样本。

4.2模型训练

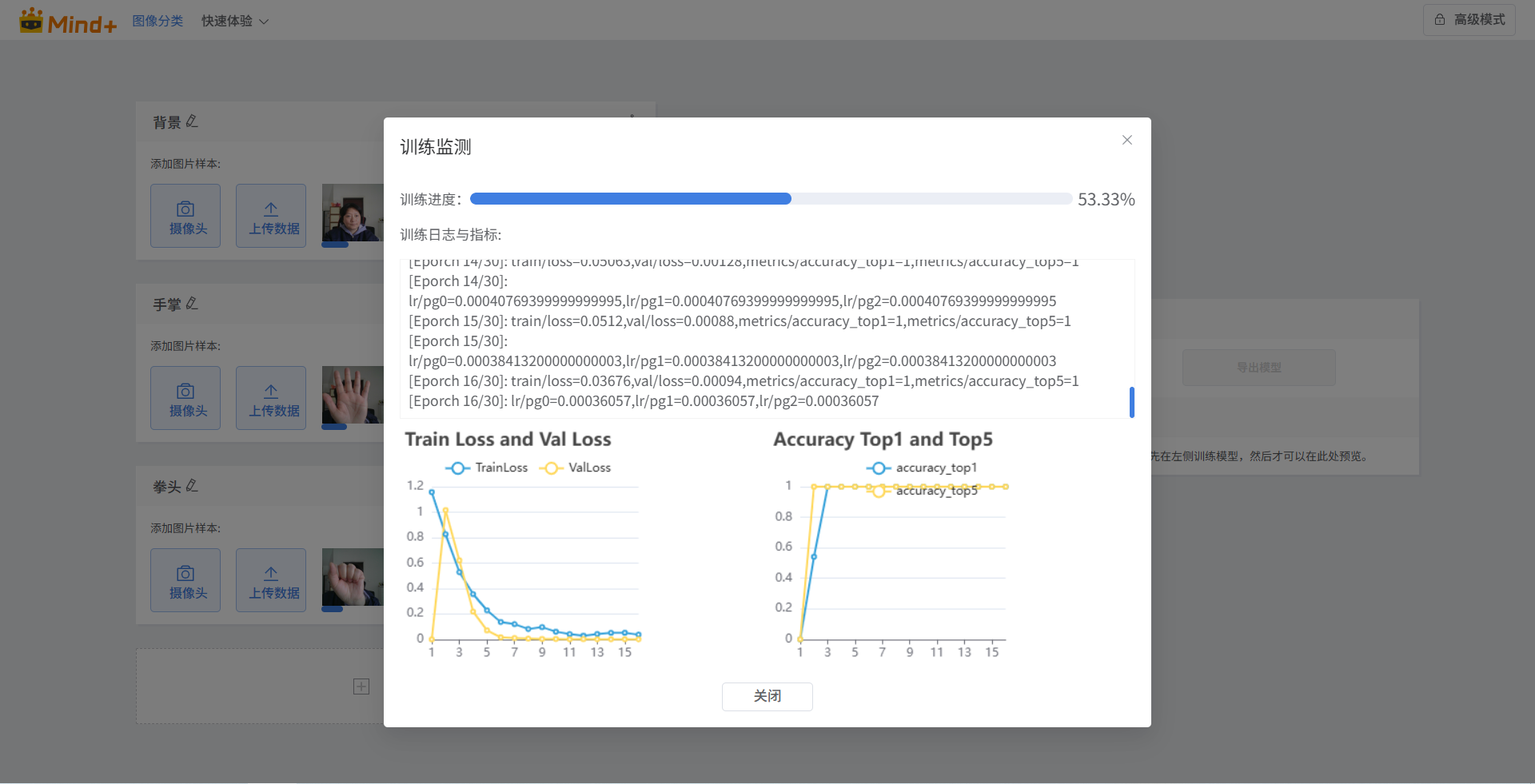

·训练模型

点击“训练模型”按钮,即可开始训练模型。

·点击“高级设置”按钮,可进行参数设置。

·训练过程与结果观察

4.3模型校验

·单张图片测试

选择“文件”,点击“点击上传文件”,选择一张没有训练过的图片进行校验。

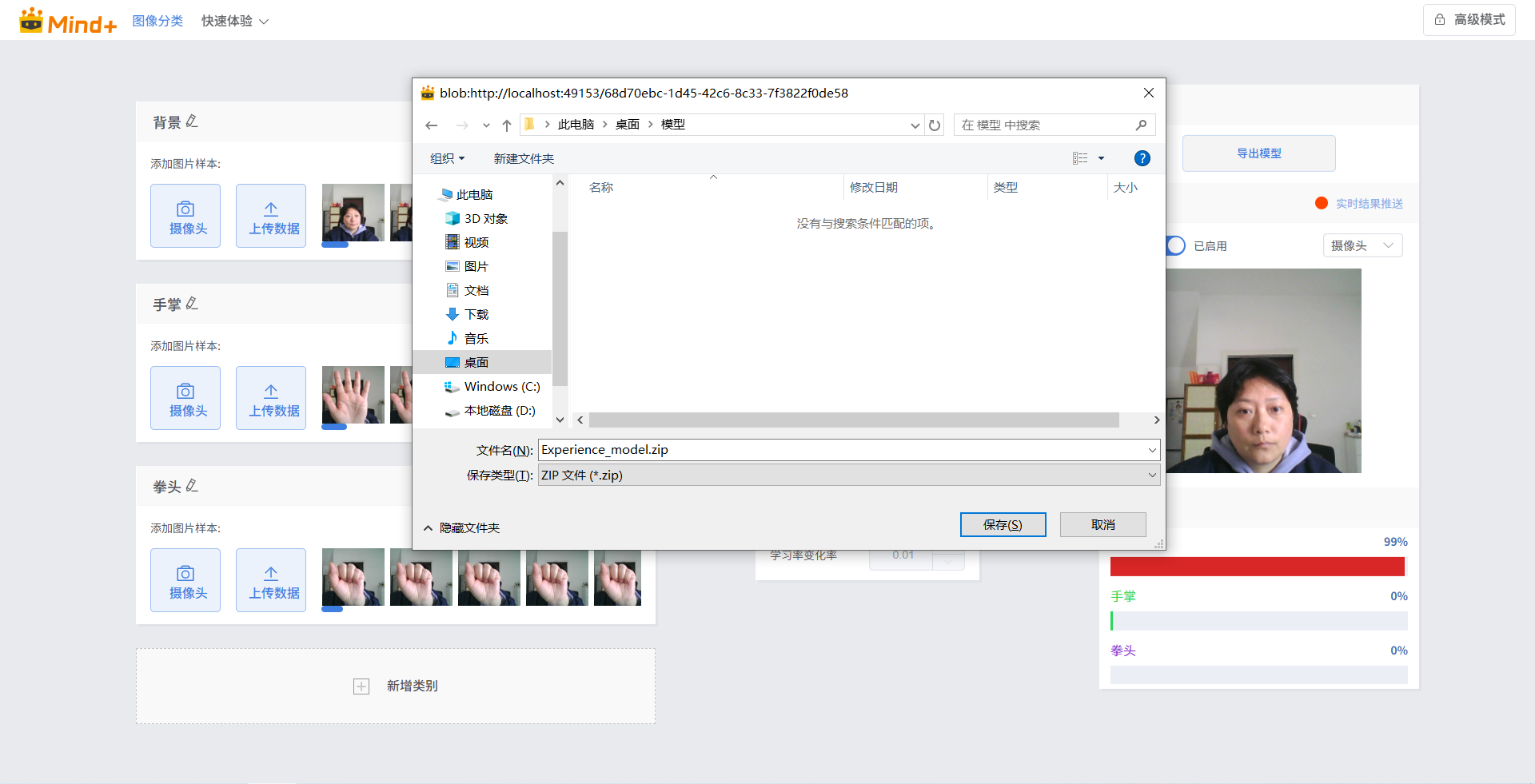

·实时测试

选择“摄像头”,进行实时目标检测。

·模型优化与再训练

当模型校验结果不理想时,我们可以通过数据质量优化,模型参数调整等方法,再次训练模型。

4.4模型导出

5.环境和扩展准备

本项目需要行空板的Python环境的版本为3.12.7,请根据下面的步骤将其切换到指定版本。

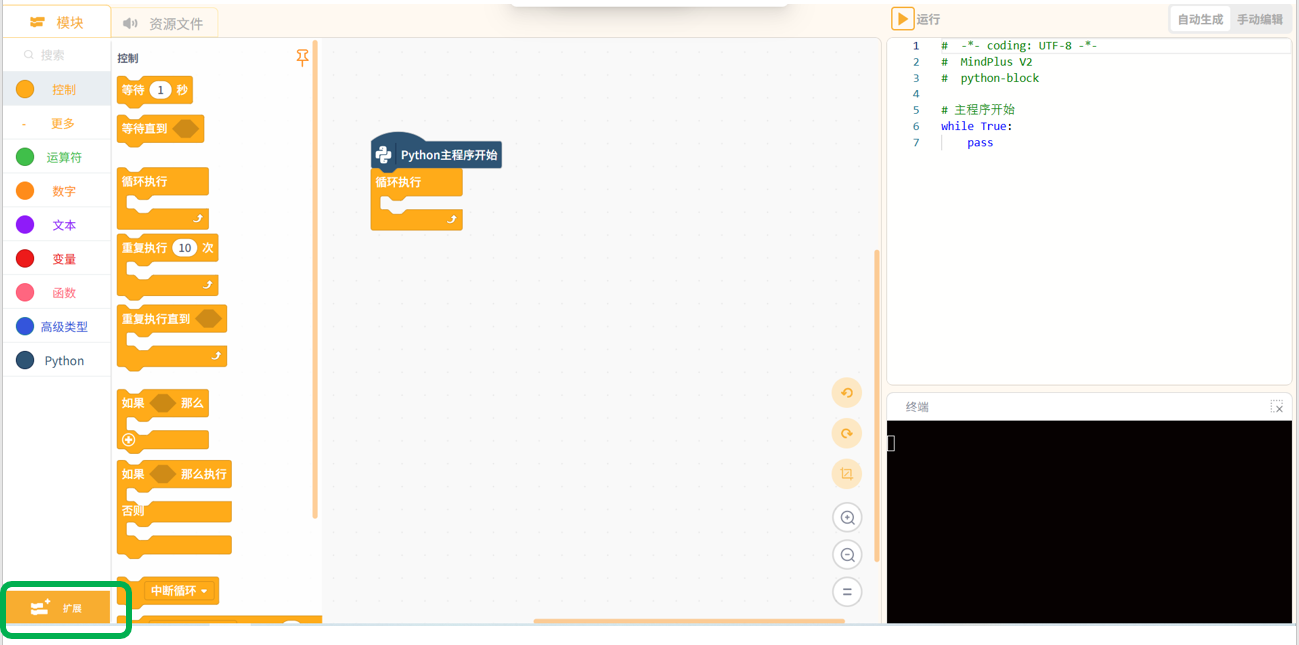

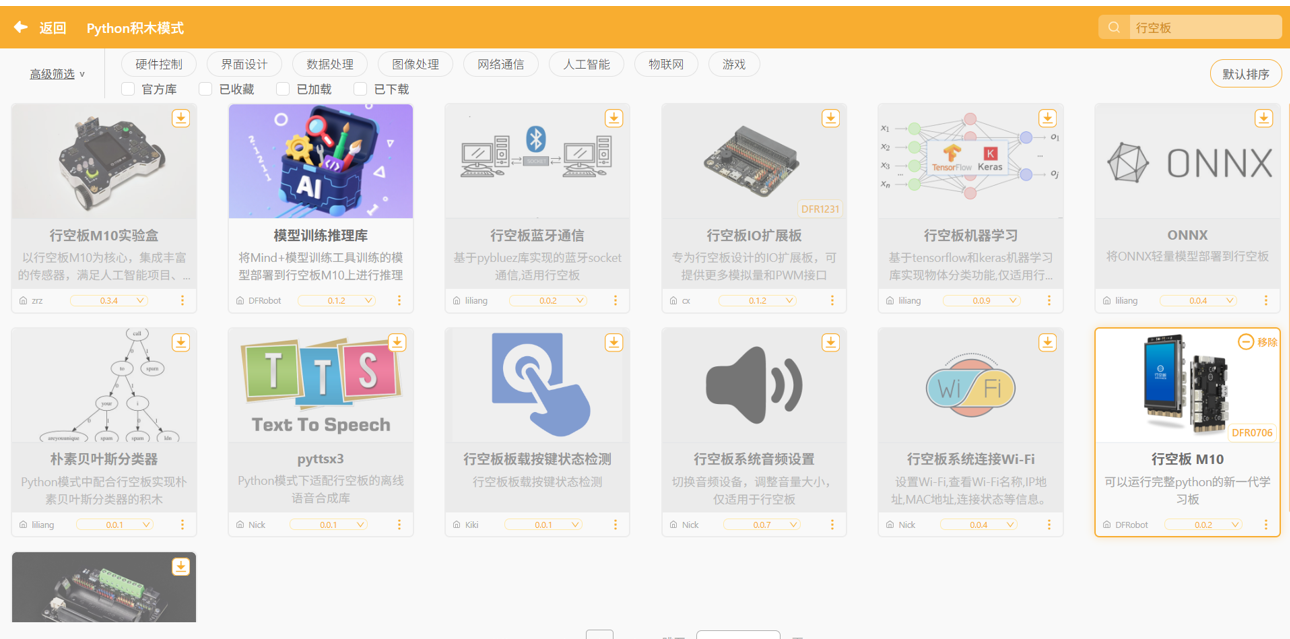

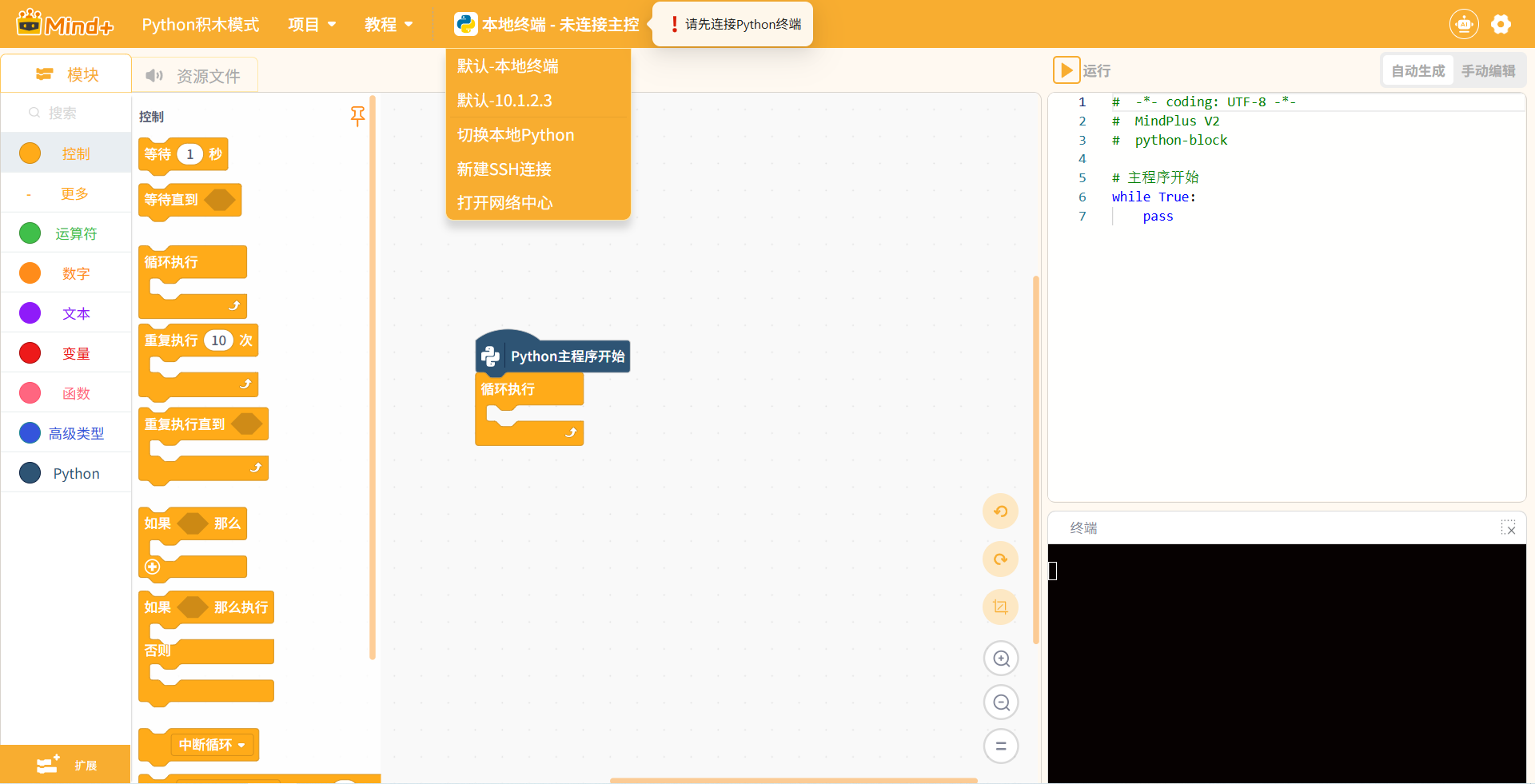

打开编程软件Mind+,选择“程序设计”中的“Python模式”。

进入 “扩展” 页面并搜索 “行空板”,点击扩展包上的 “下载” 按钮。

下载完成后点击该扩展包完成加载,再点击 “返回” 按钮返回编程界面。

在终端连接选项中中选择“默认-10.1.2.3”以连接行空板M10。

行空板的环境和网络都设置成功了,接下来需要加载模型推理相关的扩展。

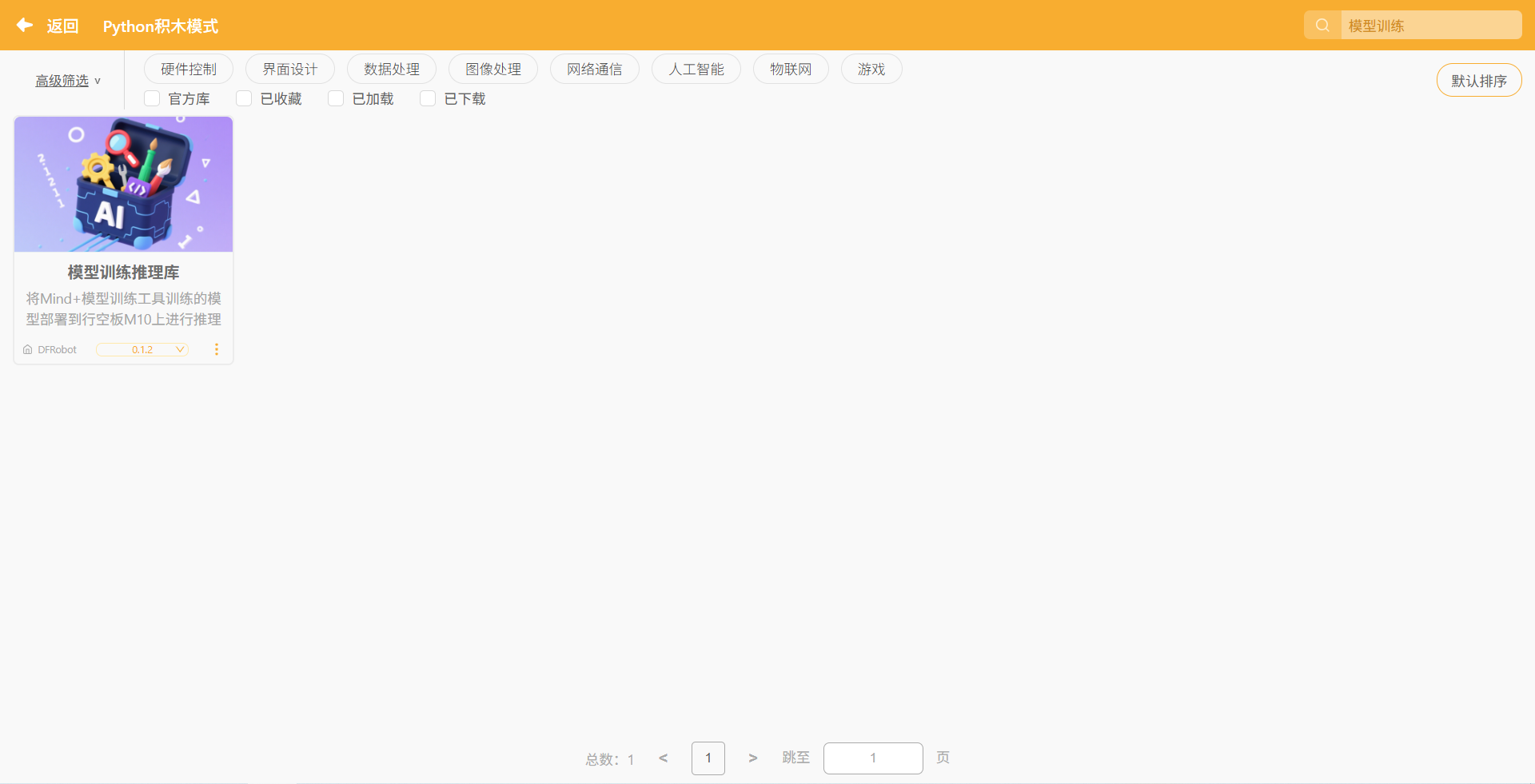

在扩展中搜索“模型训练”点击下载并添加该用户库。

6.模型部署

6.1模型部署

打开Mind+编程软件并进入python模式。

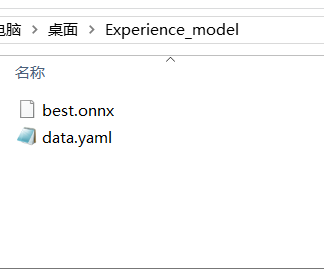

将导出的模型解压,上传模型文件。

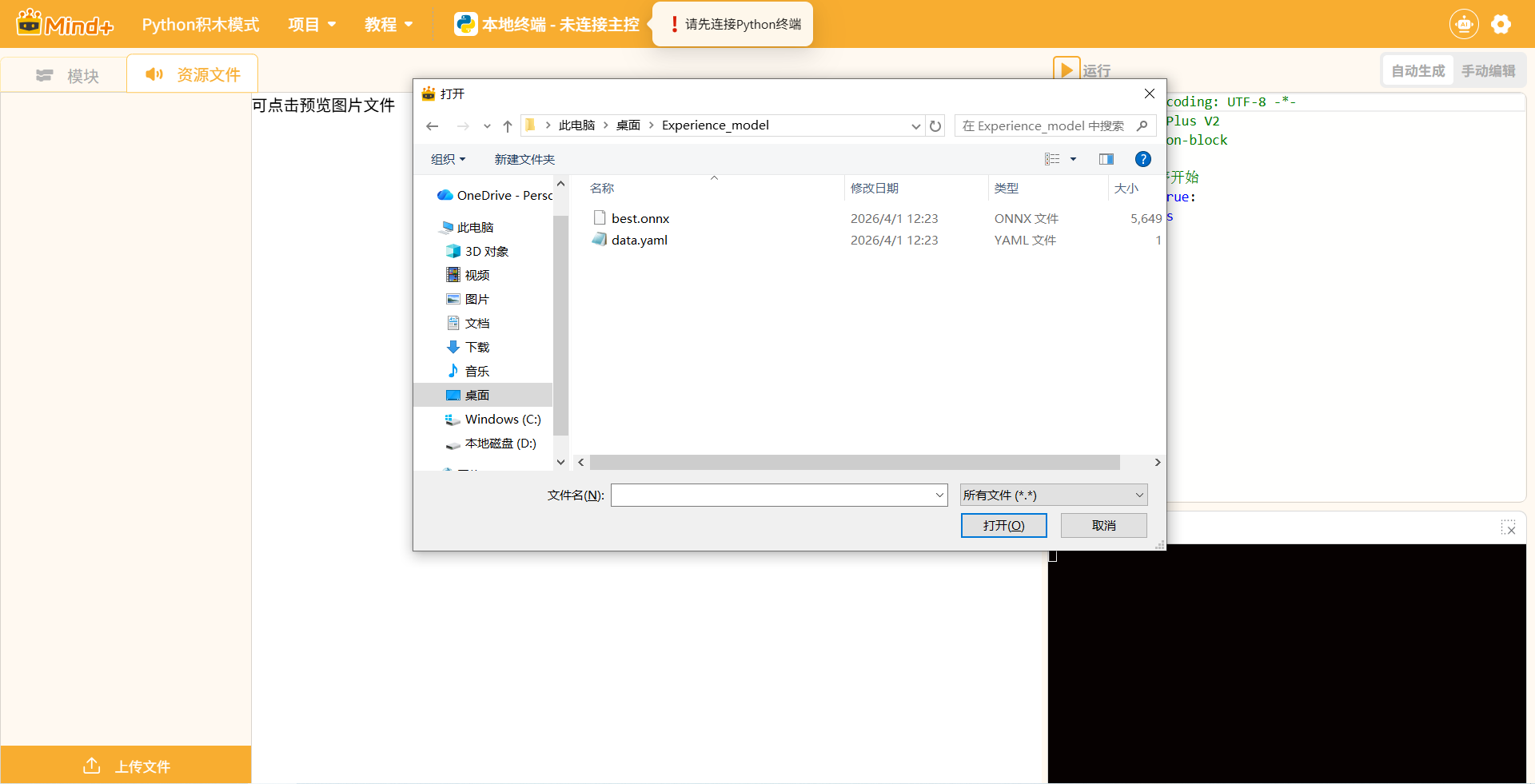

点击“资源文件”->选择“上传文件”->选择模型(.onnx)及其配置文件(.yaml)->点击“打开”

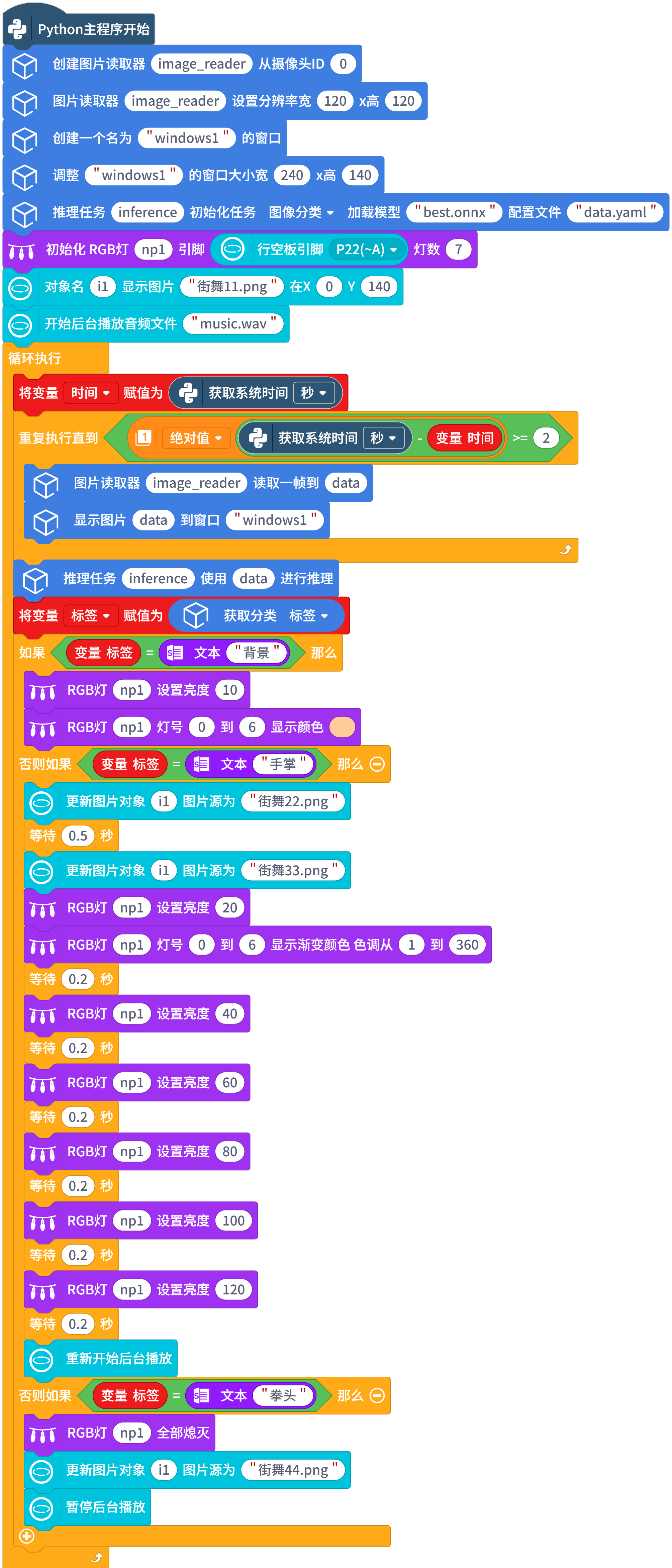

6.2程序编辑

7.项目总结

本项目已顺利完成,核心实现了手势控制音乐播放/暂停、彩灯联动及动画同步的功能,依托图像分类技术,确保手势识别精准、操作流畅,既满足了自身听动感音乐的便捷操控需求,也完成了一款低成本、易复刻的入门创客作品,兼顾实用性与趣味性,达成了初始创作目标。

7.1素材采集

·项目角色由AI生成(豆包平台生成,做了好几版,选了女生版街舞者)

·声音素材录音获取

7.2项目反思

(1)手势识别场景适配性有限,仅能在光线充足、手势角度规范的环境下精准识别,复杂光线、遮挡或手势不标准时易出现识别误差;

(2)功能较为单一,仅支持播放与暂停两种操控,无法满足更多样化的使用需求;

(3)联动效果较基础,彩灯闪烁、动画动作与音乐节奏的契合度不高,沉浸感不足。

7.3拓展展望

基于这些不足,项目泛化空间广阔,可从多方面拓展:一是手势拓展,新增不同类型手势,对应音乐切歌、调音量等功能,适配更多操控需求;二是功能延伸,结合音乐节奏,让彩灯闪烁、动画动作与节奏同步,增强沉浸感;四是技术优化,提升复杂环境下手势识别的稳定性,适配不同光线、角度,降低复刻门槛,同时补充教学指导,让更多学习者可参考实现。

附件

附件

附件

返回首页

返回首页

回到顶部

回到顶部

评论