步骤1 项目背景

在当代快节奏的社会环境中,人们面临着来自工作、生活、学习等多方面的多重压力,情绪管理逐渐成为困扰多数人的重要问题。根据《心理健康蓝皮书:中国国民心理健康发展报告(2023—2024)》显示,我国城市人群的焦虑风险显著高于农村人群,日均工作时间超过10小时的群体抑郁水平较其他组别升高23%,6.5%的成年人存在3个及以上持续抑郁症状,情绪调节能力成为国民心理健康的核心短板。职场人士面临业绩考核、职场竞争的压力,学生群体承受学业负担与升学焦虑,普通大众也常被生活琐事、人际关系等困扰,这些压力长期积累,容易导致情绪失控、低落、焦虑等问题,进而影响身心健康、工作效率和人际关系。

与此同时,国民心理健康知识普及率较低,多数人对自身情绪状态的感知不够敏锐,也缺乏便捷、即时的情绪疏导渠道,即便出现负面情绪,也往往因不愿主动倾诉、找不到合适的疏导方式而陷入内耗。在这样的背景下,情感计算技术逐渐成为解决情绪管理问题的重要方向,人脸表情作为非语言信息传递的核心载体,能够直观反映人的情绪状态,为情绪疏导提供了可靠的切入点。

Mind+ V2作为一款便捷的图形化编程与AI模型训练工具,其物体分类功能能够快速实现图像特征的提取与识别,无需复杂的代码编写,降低了AI项目的制作门槛,非常适合用于开发轻量化的表情识别应用。本作品旨在通过简单、便捷、个性化的表情识别与互动方式,帮助人们及时感知自身情绪状态,给予即时的情绪反馈与疏导,引导人们关注情绪健康,养成积极乐观的心态,同时普及基础的情绪管理理念,为人们的心理健康提供轻量化的辅助支持。

步骤2 制作构思

核心构思是“识别情绪、反馈情绪、引导情绪”,以Mind+ V2的物体分类功能为技术核心,结合人脸表情的特点,构建一个能够实时识别五种常见表情、并给出对应互动反馈的轻量化小助手。

核心需求:

一是能够准确识别五种常见表情(正常、微笑、大笑(开心)、生气(愤怒)、伤心),覆盖日常最易出现的情绪状态;

二是识别后能给出贴合情绪的个性化互动反馈,避免生硬的机械回复;

三是操作简单,无需专业知识,普通用户可快速上手;

四是基于Mind+ V2平台开发,确保模型训练与程序运行的稳定性和便捷性。

功能设计与互动逻辑构思

功能设计围绕“识别-反馈-引导”的核心逻辑,分为表情实时识别、个性化互动反馈两个核心功能,同时兼顾操作便捷性,具体构思如下:

1. 表情实时识别:程序启动后,自动调用设备摄像头,实时捕捉人脸图像,通过训练好的模型快速识别当前表情,识别结果实时显示在界面上,包括表情名称(如“微笑”“生气”),让用户清晰了解自身当前的情绪状态,识别响应速度控制在毫秒级,确保实时性体验。

2. 个性化互动反馈:根据不同的表情识别结果,设计贴合情绪的互动话术,避免统一化、生硬的回复,突出温情化和引导性,具体逻辑如下:

识别到“正常”表情:核心是引导用户关注微笑、传递积极心态,话术设计为“你今天微笑了吗?祝你今天有个好心情,不妨嘴角上扬,给自己一个温暖的鼓励~”,既提醒用户关注情绪,也传递正向暗示;

识别到“微笑”表情:核心是肯定与强化,话术设计为“捕捉到一枚甜甜的微笑!保持这份美好,你的笑容不仅治愈自己,也能温暖身边的人哦✨”,强化用户的正向情绪;

识别到“大笑(开心)”表情:核心是共鸣与延续快乐,话术设计为“哇!看到你发自内心的大笑啦🥳,快乐是会传染的,愿你一整天都被喜悦包围,继续保持这份活力~”,进一步放大用户的积极情绪;

识别到“生气(愤怒)”表情:核心是安抚与疏导,话术设计为“别生气啦,生气会伤身体哦😔,不妨深呼吸,慢慢平复心情,所有的烦恼都会慢慢过去,给自己一点冷静的时间”,帮助用户缓解负面情绪,引导情绪平复;

识别到“伤心”表情:核心是安慰与陪伴,话术设计为“我知道你现在有点难过,没关系,难过是正常的❤️,好好拥抱自己,允许自己低落一会儿,一切都会好起来的,我一直陪着你”,给予用户情感支持,缓解悲伤情绪。

步骤3 图片数据集准备

一、准备数据集图片。

考虑到人脸数据属于个人隐私,无论采集自己或者别人的都感觉不合适,为了演示程序的效果,以下人脸图片全部由豆包生成。

1.正常表情。

2.微笑表情

3.开心(大笑)表情

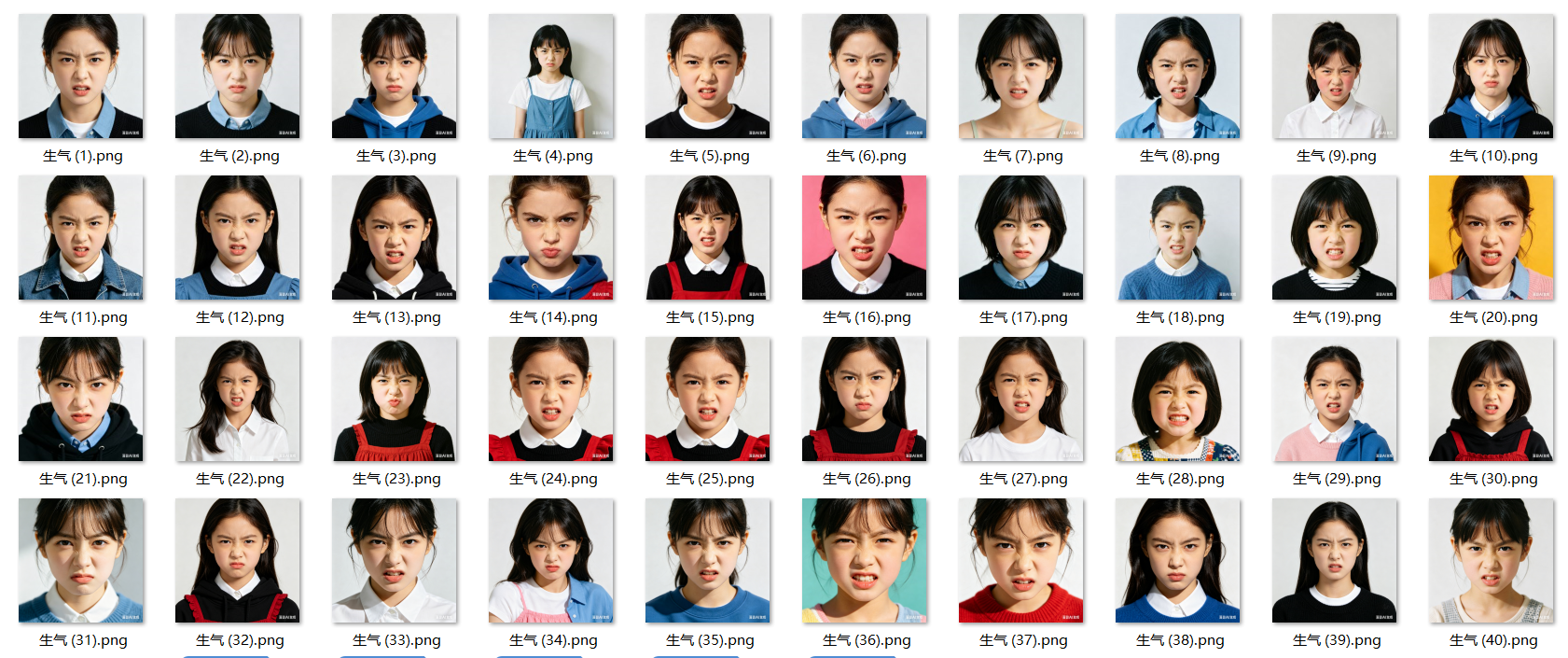

4.生气(愤怒)表情。

5.伤心(难过)表情。

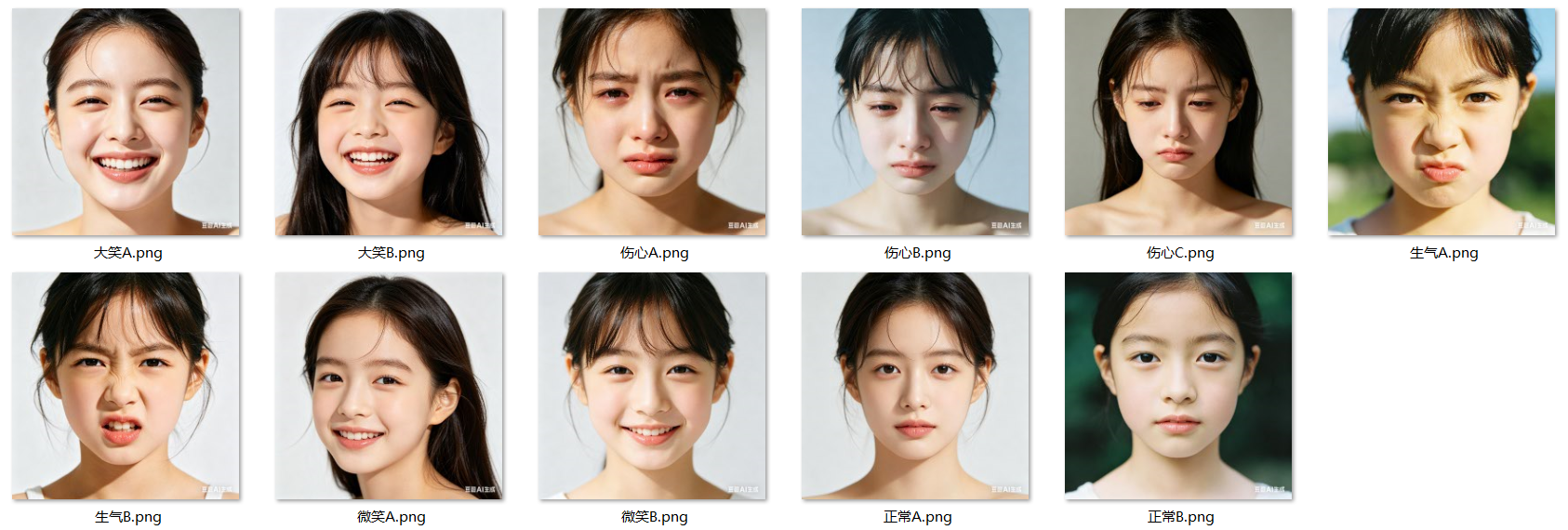

6.测试表情。(包含了以五种表情各1至3张,用于测试模型训练效果)

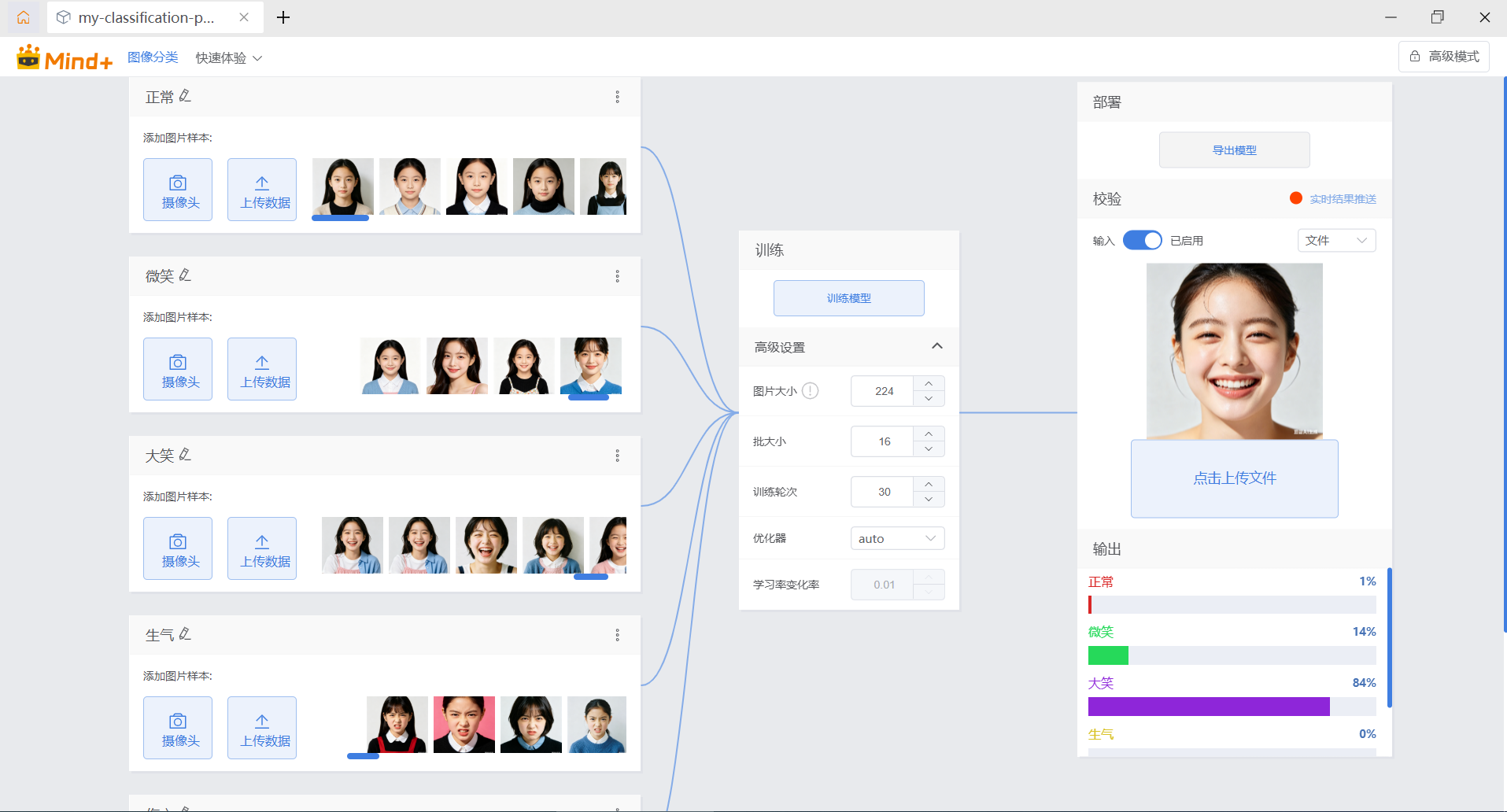

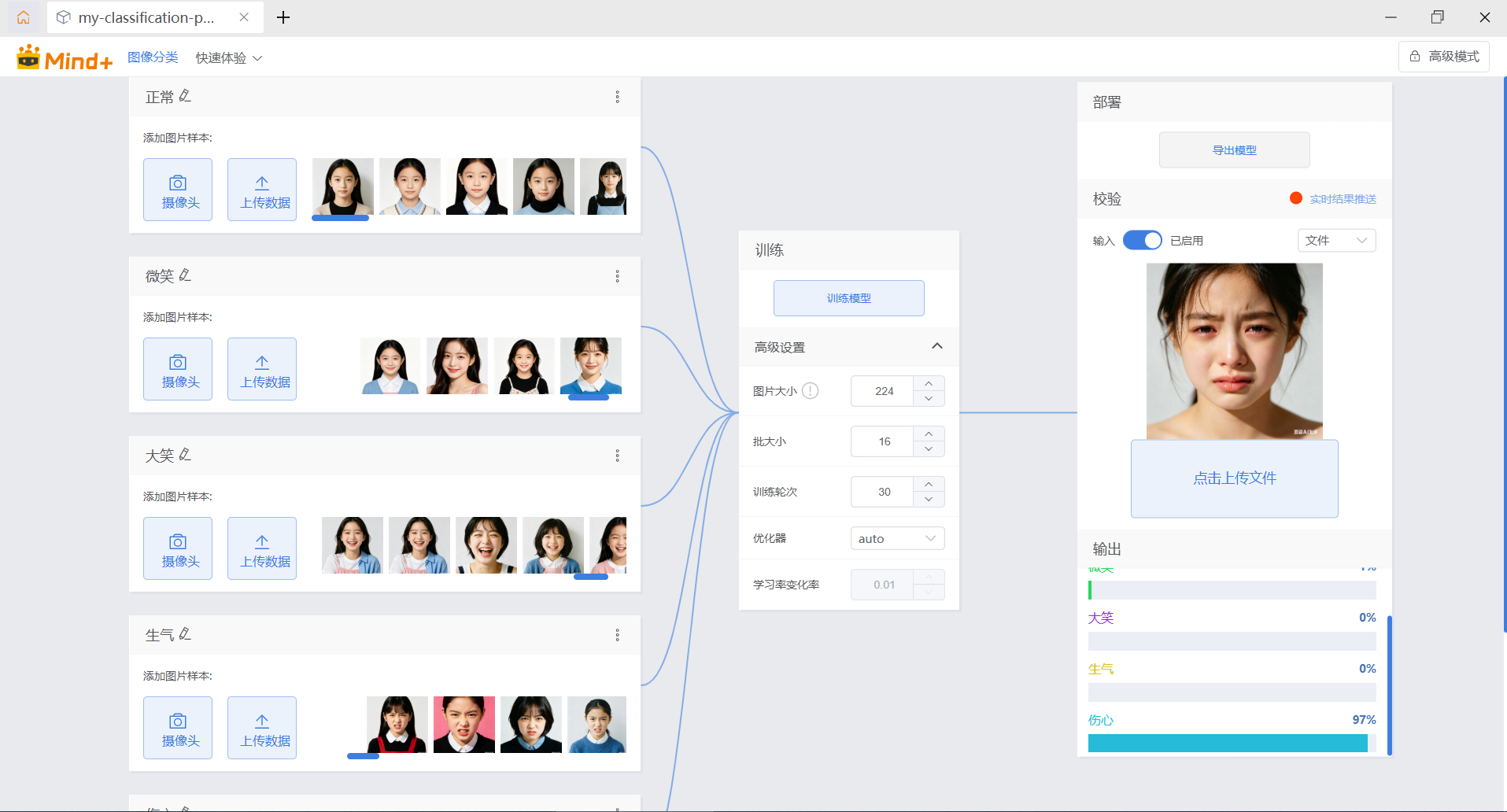

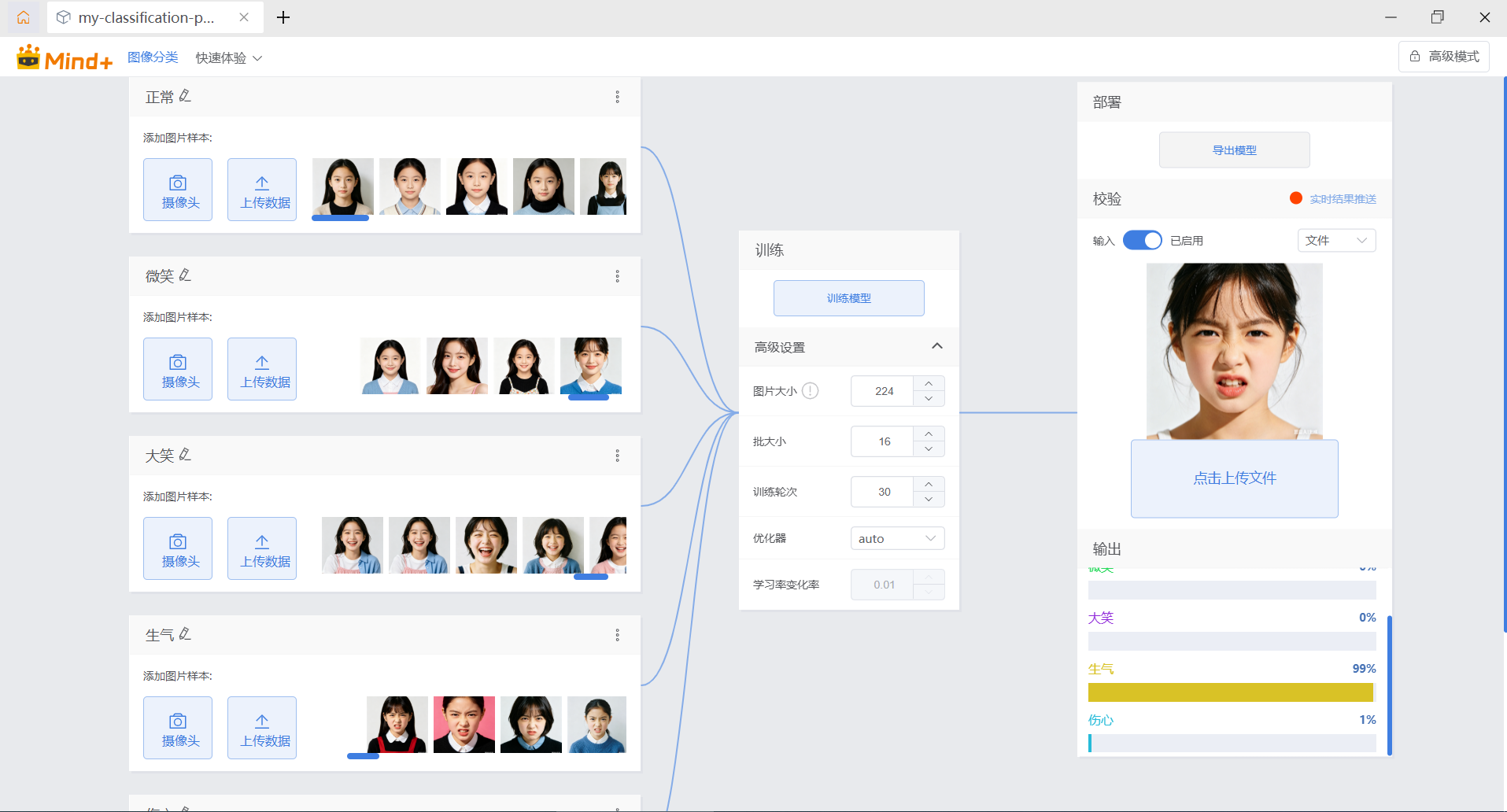

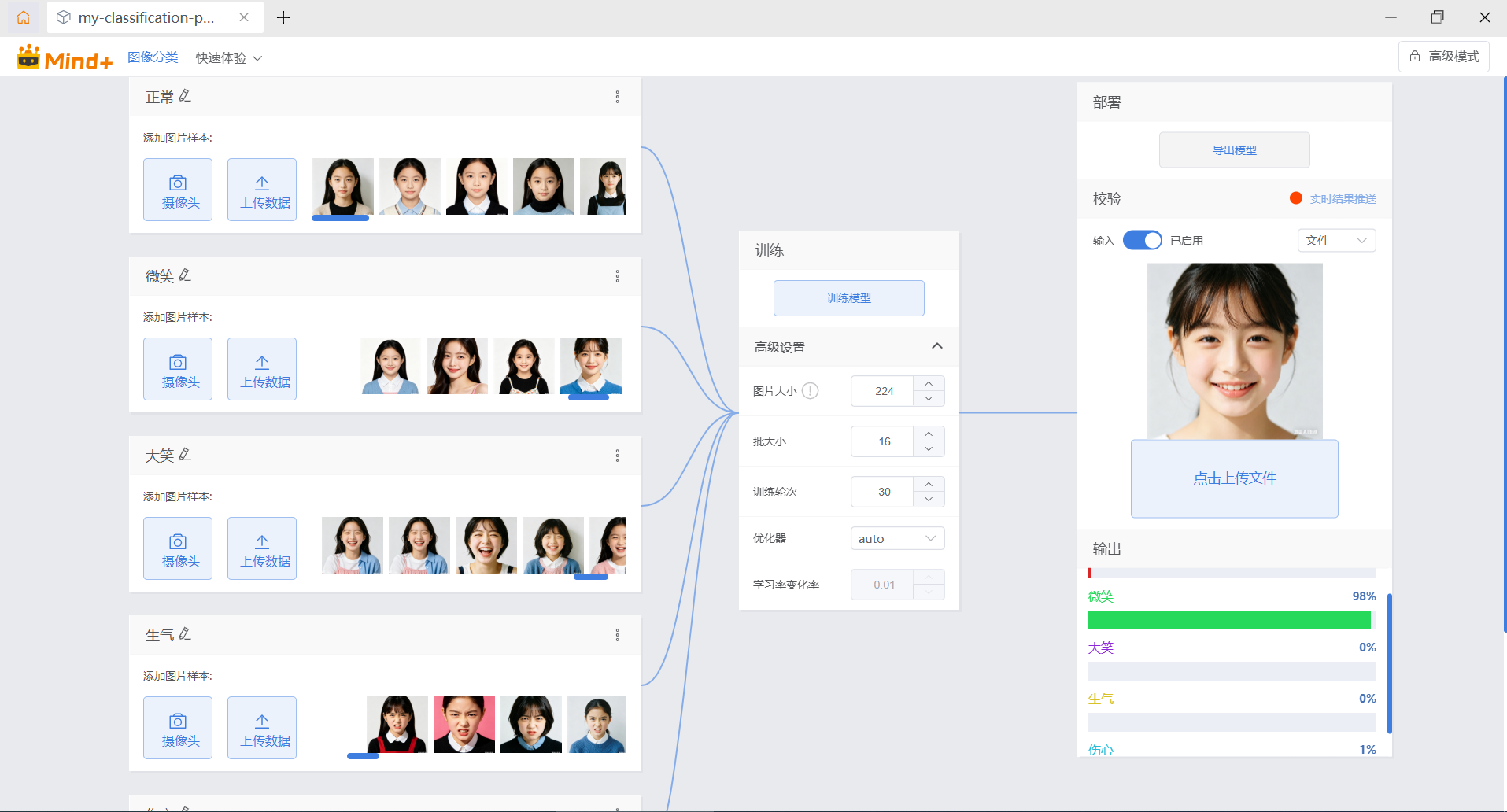

步骤4 训练过程及效果验证

之前我曾使用过浦育平台来训练自己制作的数据集,相对来说已经很方便了。但MIND+2.0的横空出世,直接把模型训练变成傻瓜式的操作,我之前使用python代码来调动摄像头来采集图片,相比用手机一张一张拍照是快了许多,但MIND+2.0使用摄像头来采集图片或录制视频简直不要太容易!

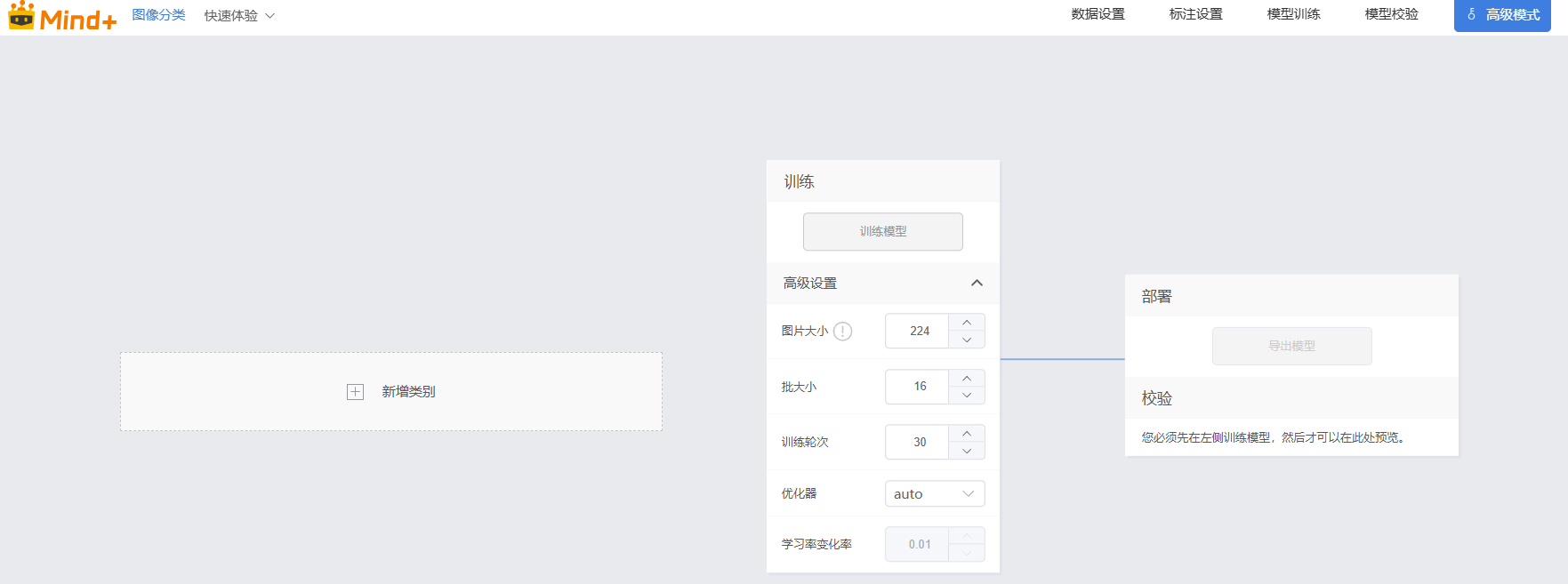

训练过程中支持高级设置。可以调节图片大小、批大小、训练轮次等多项参数,同时高级模式中还提供了数据集标注等功能。按颜色和名称制作分类标签,功能非常强大和贴心!

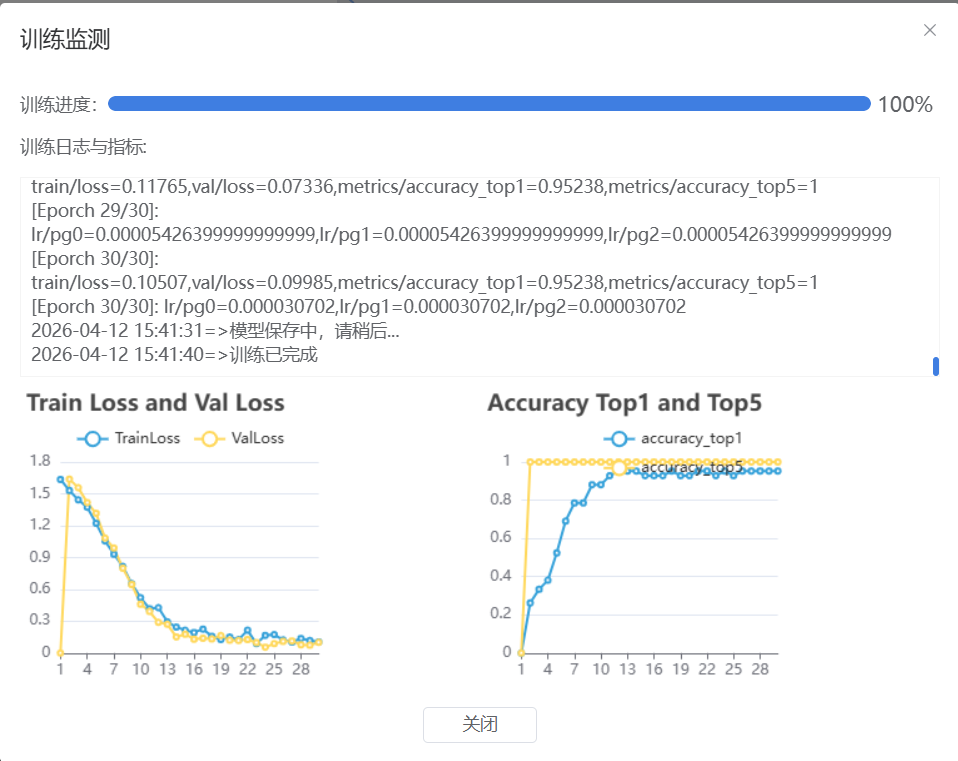

由图片可知,训练效果非常好。五种表情均能被成功识别出来。

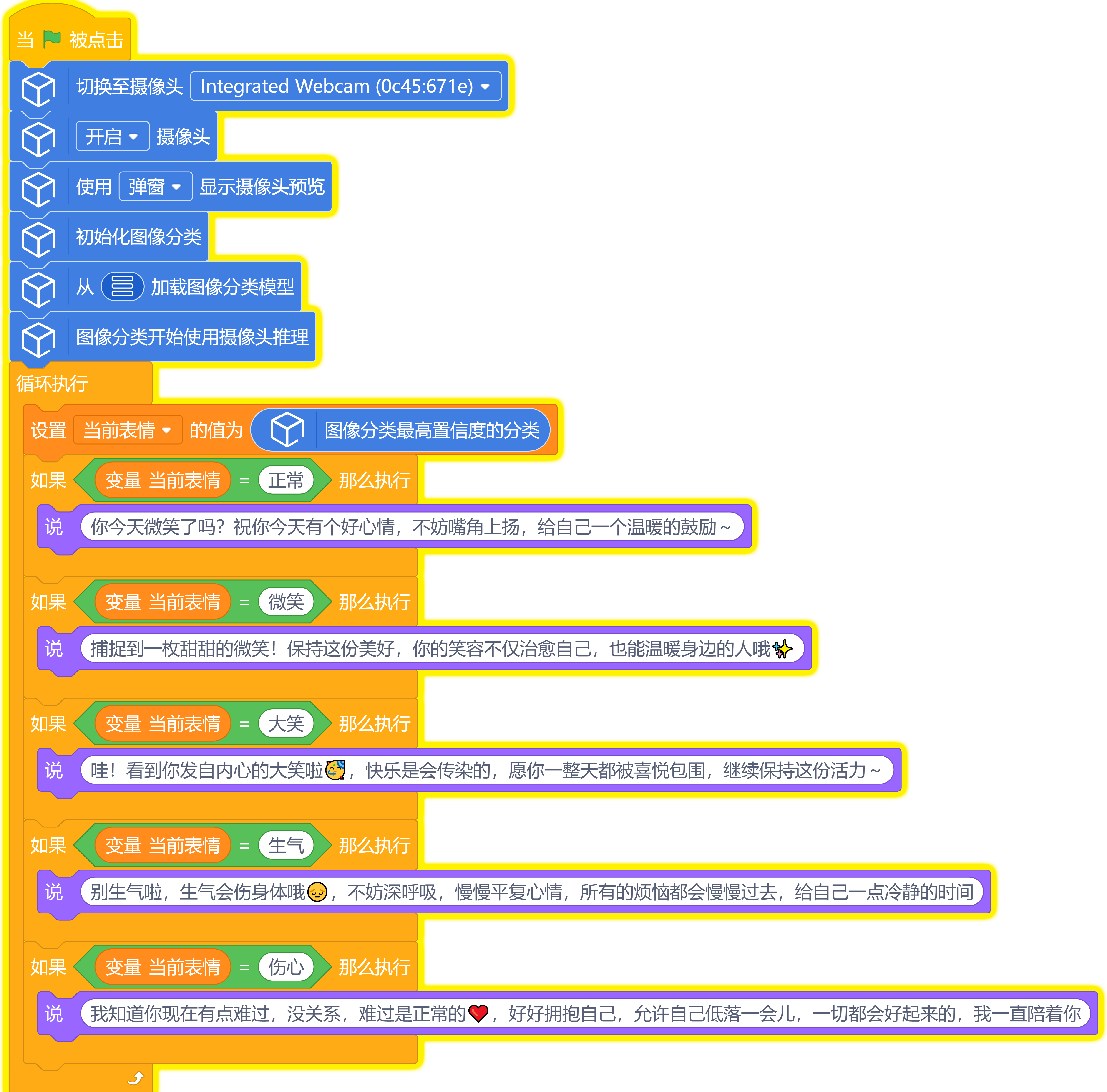

步骤5 程序设计

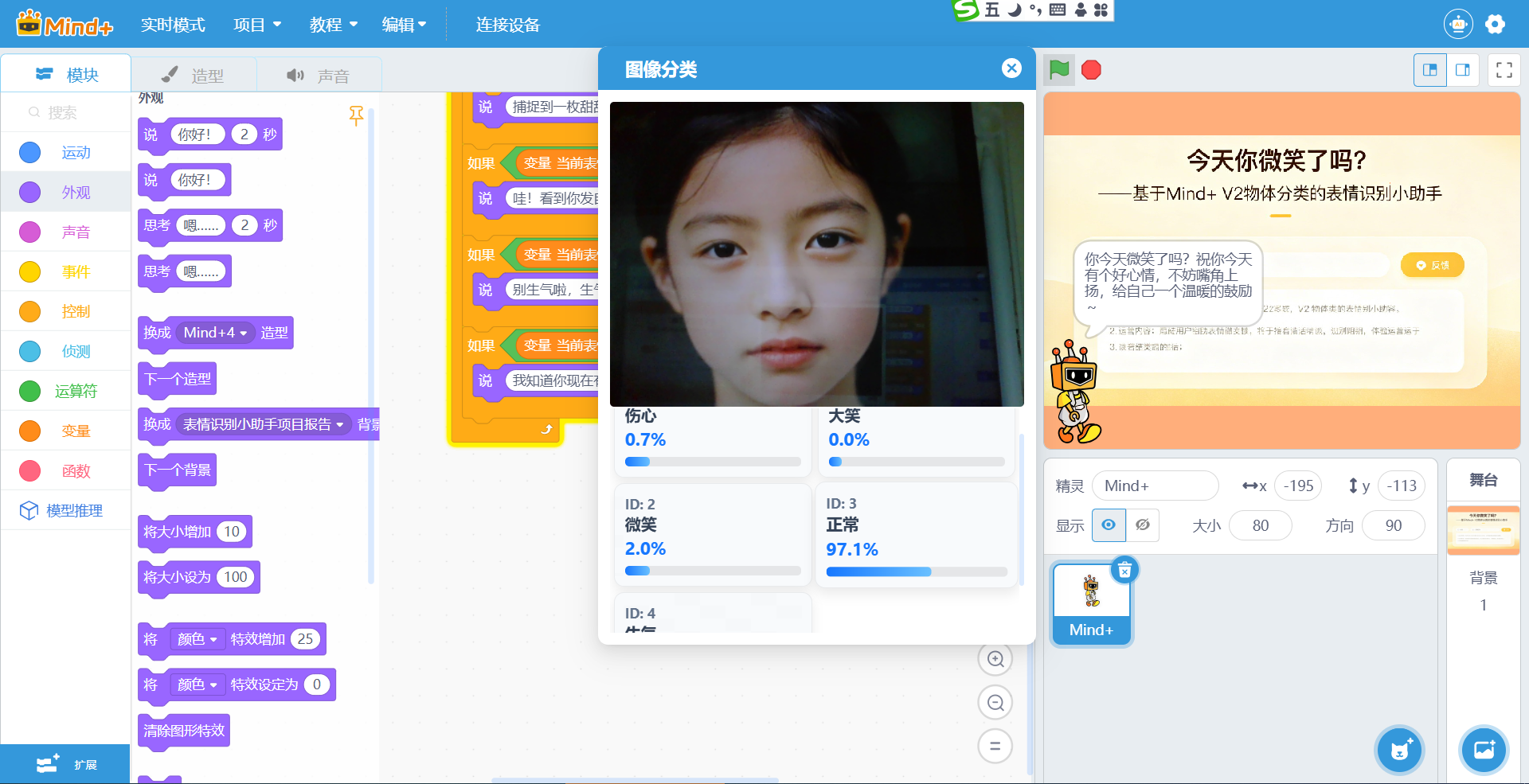

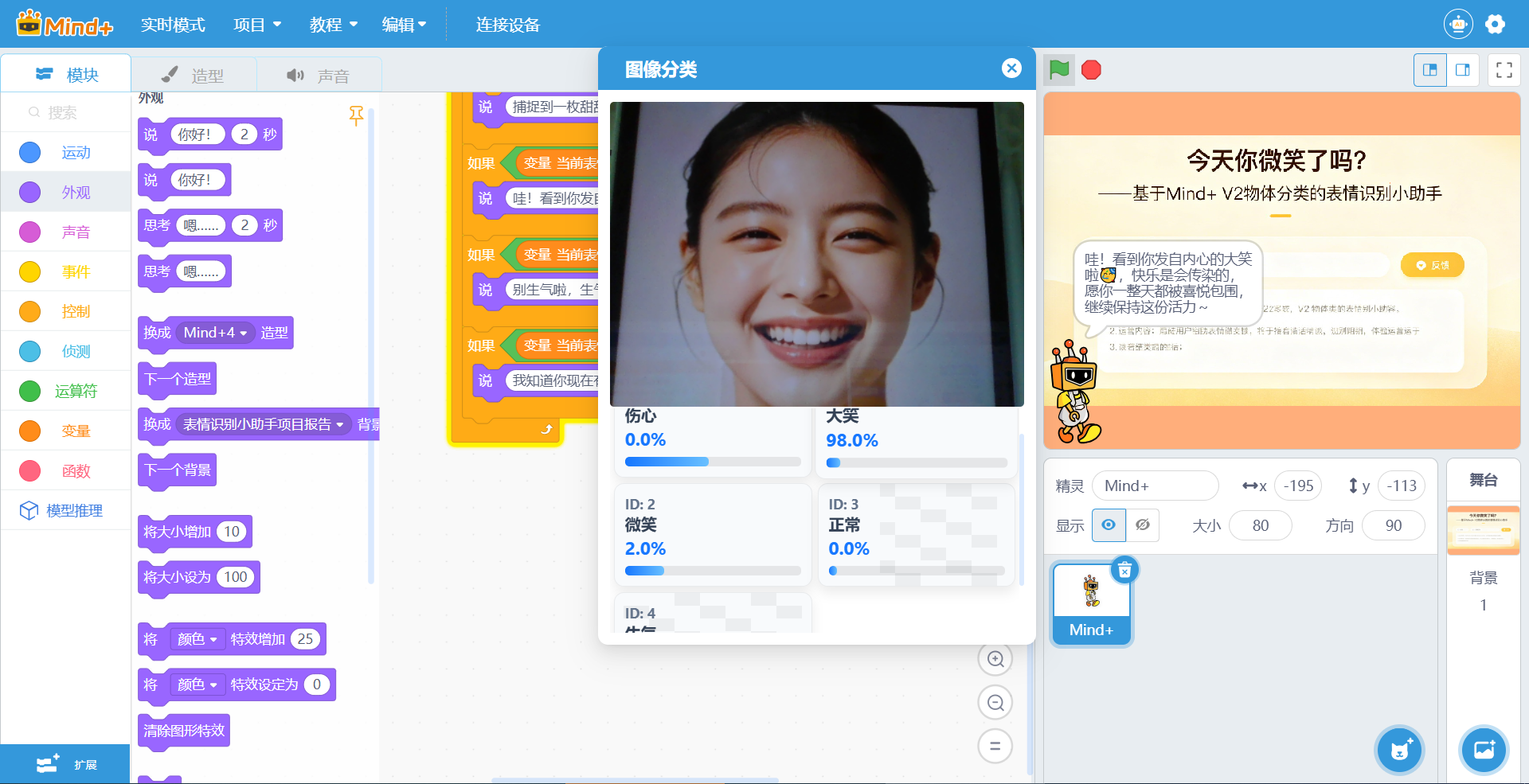

步骤6 运行效果展示

我使用摄像头识别了每种表情,发现识别率还是非常高的,表情识别也非常准确。

步骤7 反思与建议

制作反思:

1.⽬前模型仅能识别五种常⻅表情,对于⼀些复杂表情(如委屈、烦躁、惊讶……)未能覆盖,且在特殊场景下(如光线过暗、⾯部有遮挡、侧脸识别),识别准确率会下降,存在

误判的情况。这主要是因为数据集的采集不够全⾯,仅覆盖了常规光线、正⾯⼈脸的样本,缺乏特殊场景下的样本,同时模型训练的参数仍有优化空间,未能充分捕捉复杂表情的特征。

2.互动话术单一。虽然针对每种表情设计了个性化的互动话术,但话术数量较少,⻓期使⽤

后容易出现重复,⽆法满⾜不同⽤⼾的个性化需求。此外,话术的引导性仍有提升空间,⽬前主要以简单的安抚、⿎励为主,未能提供更具体的情绪调节⽅法(如深呼吸技巧、放松⽅法),难以充分发挥情绪疏导的作⽤,与专业的⼼理健康疏导需求仍有差距。

3.程序功能较为单⼀。⽬前项⽬仅实现了“表情识别+话术反馈”的核⼼功能,缺乏拓展功能,⽐如情绪记录功能(记录⽤⼾不同时间段的情绪状态,帮助⽤⼾了解⾃⾝情绪变化趋势)、⾃定义话术功能(允许⽤⼾根据⾃⾝喜好设置互动话术)、情绪调节建议功能(针对不同负⾯情绪,提供具体的调节⽅法)等,未能充分挖掘项⽬的实⽤价值,功能的丰富度有待提升,难以满⾜⽤⼾⻓期使⽤的需求。

4.由于时间关系,未在行空板上进行测试。

建议:

1.mind+2.0模型训练功能强大,但目前应用最多的可能就是图像分类和目标检测两种,我本来打算使用手势分类功能制作一个互动游戏,但我翘首期盼的手势分类功能暂时没有开发出来,我相信这一功能也将很快会被工程师们攻克。

2.关于模型训练,虽然目前整体而言已经比没有好太多了。但Mind+2.0必须安装在win10以上的系统中。目前许多学校仍使用win7的系统,因此无法使用。其次,模型训练的界面还可以做一些优化,提供更多的参数设置和帮助系统,以帮助更多的人(比如中小学生)能更好的理解和掌握模型训练的方法。

返回首页

返回首页

回到顶部

回到顶部

评论