项目背景:

近年来国际国内经济形势都非常严峻,许多企业裁员,大学毕业生毕业即失业。这种社会氛围传导至中学校园,导致中学生面临巨大的学业压力、心理压力。各类极端事件层出不穷,中学生心理健康问题日益突出。而学校的心理辅导资源有限,专业的心理咨询教师配套不足,学生的主动求助意识也比较薄弱。基于此原因,我们决定设计这款心理健康助手,用于辅助学生进行自我心理调节。

项目功能:

本作品通过摄像头实时捕捉心理求助对象的多类身体姿态(如抱头、低头、捂脸、趴桌、握拳、叉腰、平静等),构建姿态分类模型,实现对不同姿态的自动识别。系统依托行空板进行程序判定,将识别到的身体姿态映射为对应的心理状态(如焦虑、忧郁、愤怒、平静等)。在此基础上,作品根据判定结果,综合运用文字提示、图像展示和声音引导等方式,向求助者提供个性化的心理抚慰与调节建议,实现从“姿态感知—状态识别—情绪判定—安抚反馈”的完整智能干预流程。

软硬件清单:Mind+2.0、行空板M10、USB摄像头、台式电脑(windows10操作系统)、USB喇叭

硬件连接图:

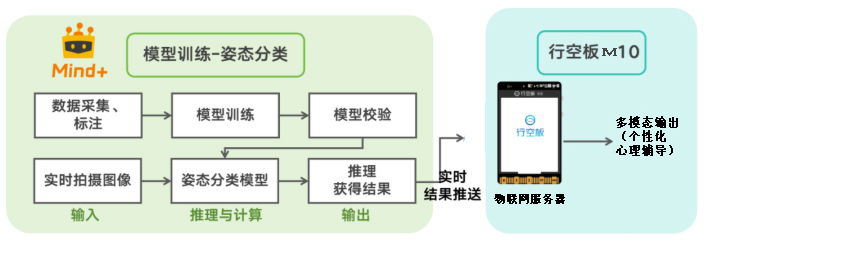

项目基本原理:本项目基于姿态分类技术实现对心理求助对象的心理状态判定。首先通过 Mind+ 模型训练平台进行姿态图像采集与标注,构建数据集,并训练姿态分类模型;训练完成后,在电脑上实现实时推理和输出姿态分类;然后通过物联网平台将推理结果发送到行空板M10,并将身体姿态映射到不同的心理状态,最后通过语音、文字、图像等实现对心理援助对象的个性化辅导。

项目制作:这部分主要采取数据采集——模型训练——模型校验——推理结果推送——程序设计——程序测试与优化的主要工作步骤。下面将逐一讲解。

1.数据采集:

步骤1:打开mind+2.0,进入模型训练界面,选择姿态分类功能。

步骤2:确定要收集抱头、捂脸、正常、低头、趴桌、握拳、插腰这样几类姿态数据。填写分类标签,点击摄像头图标,开始进行人体姿态数据的采集。数据采集时,要注意尽量采集同一姿态不同条件下的样本。如:拍摄角度、光线、位置、人体体型等要有所变化。不同类别间数据量要尽可能平衡。这里出于时间成本、效率等综合考量,每个类别选择了60张左右的样本图片。此外,录制过程中,画面要避免晃动。环境的背景样本在整个数据采集过程中要尽量保持一致性。

2.模型训练:设置模型训练的相关参数,并进行模型训练。具体参数设置如下图所示:

3.模型校验:进行模型的测试,如果测试结果不理想,可以重新增加或修改模型样本数据、调整训练参数,重新进行模型训练,直至效果满意为止。

4.推理结果推送:将推理结果推送至行空板M10。这里需要将MQTT 服务器地址填写为行空板IP (具体如图所示),行空板M10需要和台式电脑接入同一局域网络。

5.程序设计:

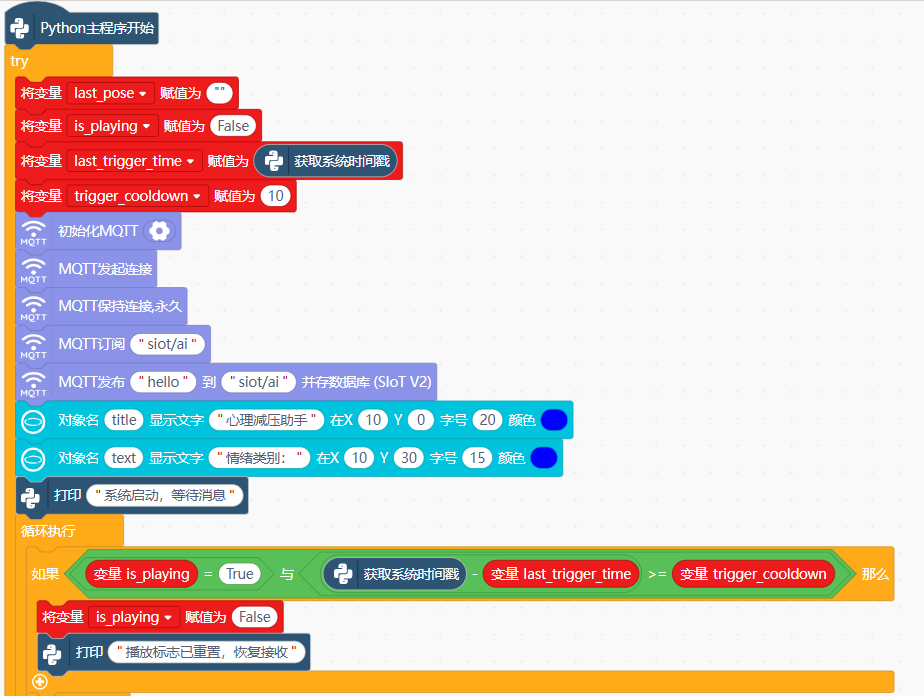

程序的核心功能如下:

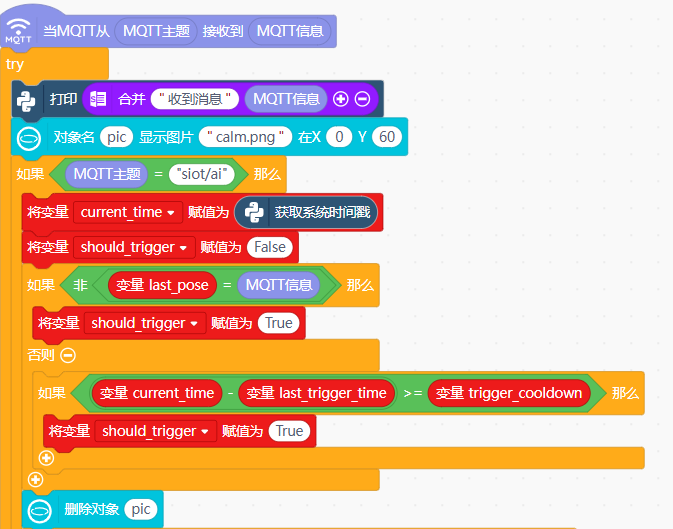

(1)订阅MQTT主题,接收AI模型识别出的姿态分类标签。

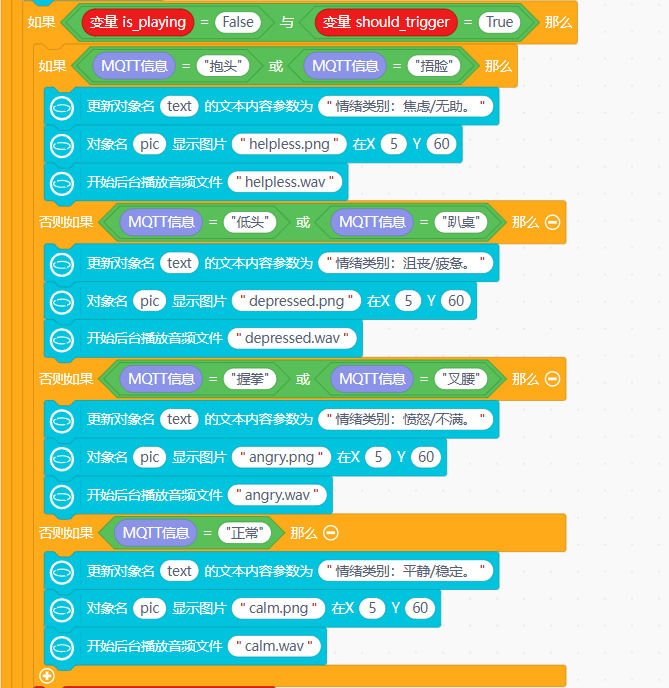

(2)将姿态与情绪逐一映射,并通过行空板做出适当的响应。具体如下:

(3)设定防止重复触发的机制。

冷却时间:同一姿态连续触发需间隔 10秒(trigger_cooldown = 10)

姿态变化优先:如果姿态发生变化(如从"抱头"变为"正常"),可立即触发新响应。

播放锁:音频播放期间(is_playing=True)不会重复触发,避免发生多个音频重叠播放的混乱状况。

(4)行空板的界面设计(如标题、状态文本、配图、播放音频等)

具体代码如下所示:

总结与展望:

本项目完成了一套基于mind+姿态识别和MQTT通信协议的心理健康助手。该系统通过实时捕捉人体姿态,映射识别焦虑、愤怒、忧伤等情绪状态,并通过语音、文字进行相应反馈,助理于中学生的心理自查自助。

项目未来还有如下的拓展和优化空间:

1.模型的准确性和泛化能力还有待提升。目前姿态识别受拍摄角度、光线等影响较大。

2.未来可引入时序模式识别,辅助进行更加精准的情绪识别。

3.多场景适配。除课堂外,未来还可以引入居家学习、老年人情绪监护等,扩大系统的使用范围。

材料清单

- X

返回首页

返回首页

回到顶部

回到顶部

Bruce.冷2026.04.12

教程很好,有意思

Sunny_zhu2026.04.12

谢谢夸奖。