红绿灯目标检测:为红绿色盲打造智能语音辅助系统

一、项目背景与目标

红绿色盲人群在日常生活中面临极大的出行安全隐患,无法快速识别交通信号灯颜色是核心痛点。本项目基于目标检测算法,使用 500 + 张标注好的红绿灯 YOLO 格式数据集训练模型,实现两大核心功能:

实时语音播报:检测到红灯 / 绿灯后自动语音提示,为色盲人群提供听觉辅助;

行空板可视化展示:上半屏实时显示检测画面,下半屏文字明确标注「红灯」/「绿灯」,双视觉强化提示。

项目全程基于轻量化深度学习框架,兼顾检测速度与精度,适配行空板的硬件性能,真正做到低成本、易部署、高实用。

二、数据集准备(YOLO 格式核心要点)

训练集是 500 + 张红绿灯实拍图片,已完成标准 YOLO 格式标注,这是模型训练的基础,先明确 YOLO 数据格式规范:

1. 数据目录结构

traffic_light/

├── images/ # 所有红绿灯图片(jpg/png格式)

├── labels/ # 对应标注文件(与图片同名,.txt格式)

└── data.yaml # YOLO训练配置文件

2. 标注文件规则(.txt)

每一行代表一个目标,格式:类别ID 中心x坐标 中心y坐标 宽度 高度

本项目仅需 2 个类别:0:红灯、1:绿灯

坐标均为归一化数值(0~1 之间),无需手动计算,使用 LabelImg、LabelMe 等标注工具可直接生成 YOLO 格式标签。这里数据集来自Kaggle提供的数据集,原数据集中包含15个Lable,近5000张训练图片,为了可以在Mind+中快速训练简化为两个Lable,500+张训练图片,实测训练时间为3小时候左右在实际测试中须保持程序始终运行不可被打断(如关机,系统挂起等)关于训练本身的信息如何使用和观察将另开一篇文章仔细讲解。

【创意智造组】Mind+ V2 模型训练中的目标检测训练图怎么看

https://makelog.dfrobot.com.cn/article-319188.html

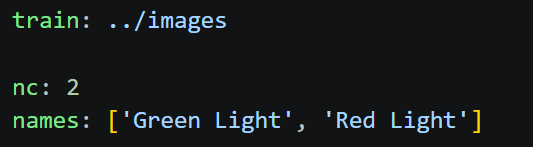

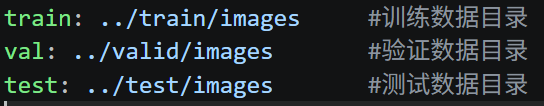

2. 配置文件

traffic_light/

└── data.yaml # YOLO训练配置文件

其中

在Mind+中只给train目录即可

三、 训练模型

1.选择方法

这里我们使用目标检测模型

2.上传数据

选择“有标注数据”并点击文件上传,选择我们刚才打包好的yolo格式的zip文件

3.调整训练参数

初学者可以暂时不关注这里,以后我会单开一篇文章讲解

4.开始训练

点击“训练模型”,然后等待训练结束,这个过程根据模型不同,训练数据不同有很大差异。本项目中采用了561张416x416大小的图片,训练时间大约为3小时。

在训练过程中我们可以观察训练图以决定是否继续训练,训练图怎么看请参考以下文章

【创意智造组】Mind+ V2 模型训练中的目标检测训练图怎么看

https://makelog.dfrobot.com.cn/article-319188.html

5.本地校验

训练完成后可以立即校验

|  |

|  |

6.导出模型到本地

导出的时候注意别把以前训练好的模型给覆盖了。保存好以后把zip包解开会得到两个文件

Experience_model/

├── best.onnx/ # 训练好的模型(onnx格式)

└── data.yaml # 配置文件

四、部署和使用模型

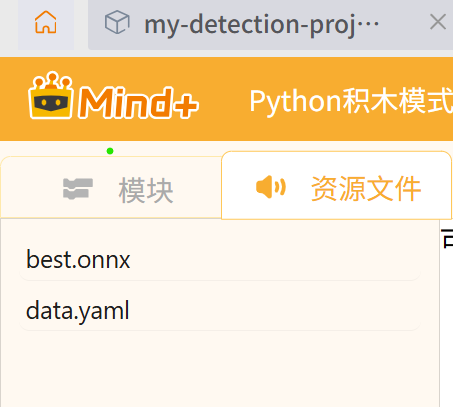

1.选择Python积木模式

2.点击“资源文件”→ “上传文件”→ 选中刚才我们接压出来的两个文件

3.回到模块添加“扩展”→添加“模型训练推理库”和“行空板M10”

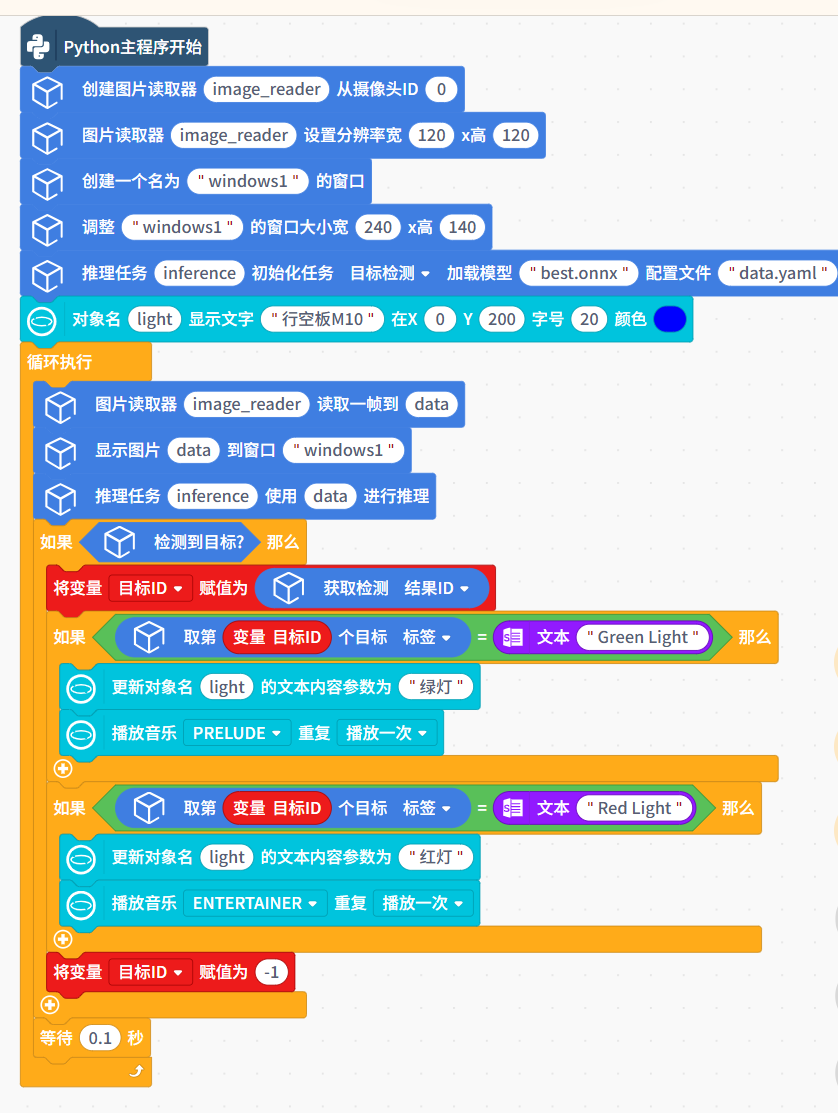

4.编码

5.上传

1.硬件我们使用 行空板M10+电池扩展版+USB摄像头

2.确认行空版系统版本大于0.41

如果不满足要求请参考文章

行空板M10刷固件保姆级视频教程

https://makelog.dfrobot.com.cn/article-317982.html

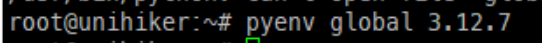

3.Python环境更新

打开网页http://10.1.2.3 为行空板配置网络

http://10.1.2.3/pc/network-setting

SSH模式连接行空板切换Python版本为3.12.7

pyenv global 3.12.7

不会用SSH的请参考如下文章

用mRemoteNG同时远程连接行空板ssh和rdp

https://makelog.dfrobot.com.cn/article-311595.html

4.连接M10

5.初次使用模型模式需要下载支援包,此过程需要几分钟时间

把代码推到行空版我们就可以带着行空板去上街实际测试了

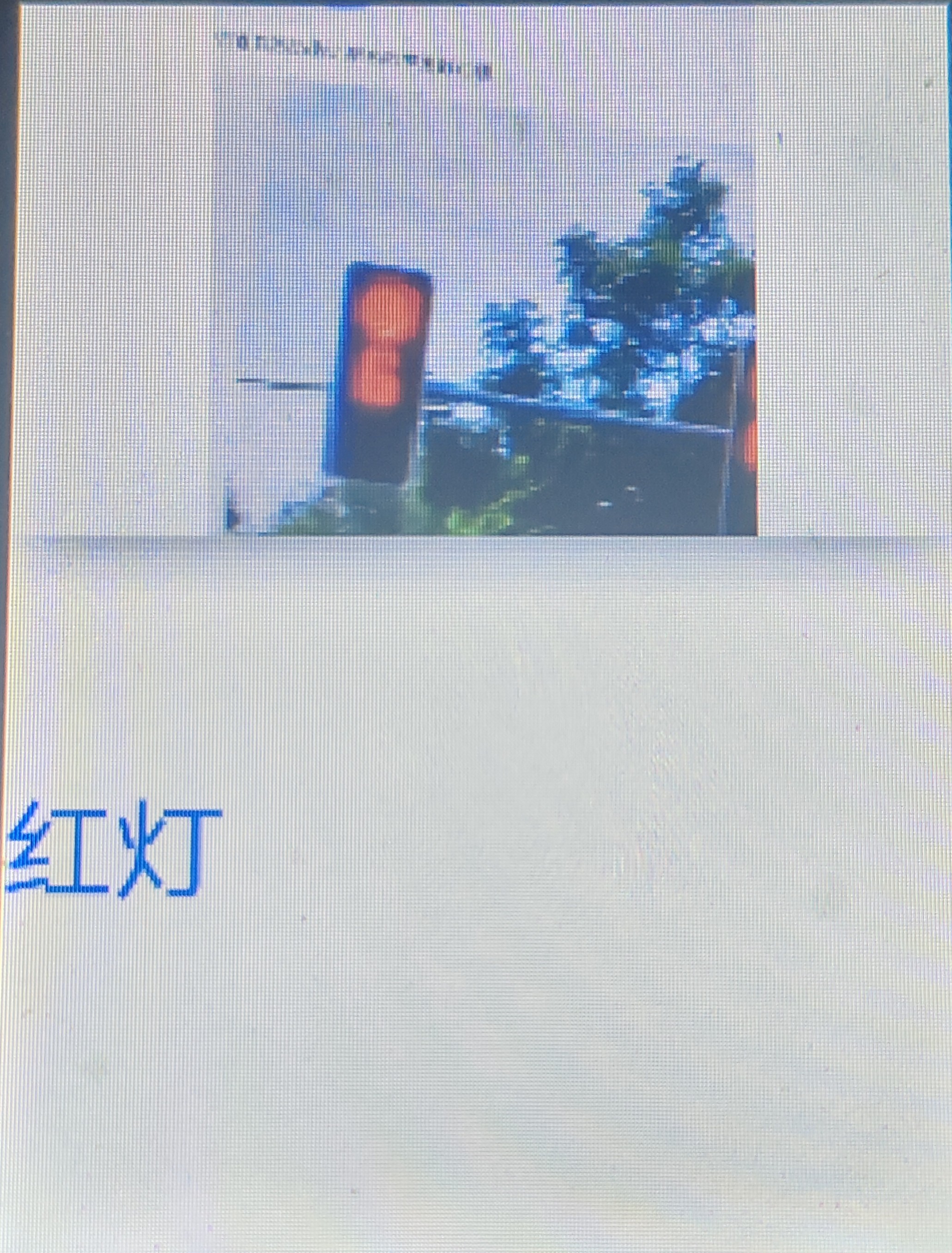

五、核心功能效果展示

|  |  |

实时检测:摄像头捕捉红绿灯,YOLO 模型快速框选目标,置信度过滤杜绝误判;

语音辅助:检测到红灯 / 绿灯时,自动播报「前方红灯」「前方绿灯」,色盲人群无需看屏幕即可获取信息;

双屏可视化:

上半屏:实时显示带检测框的红绿灯画面,直观看到检测效果;

下半屏:大号文字标注「红灯」/「绿灯」,颜色对应红色 / 绿色,强化视觉提示;

低延迟:行空板上可实现实时检测,无卡顿。

六、项目优化与拓展方向

数据增强:新增雨天、夜间、逆光红绿灯图片,扩充数据集,提升复杂场景精度;

硬件优化:外接扬声器,放大语音播报音量;增加电池模块,实现便携移动使用;

功能拓展:新增黄灯检测、倒计时识别、行人信号灯检测;

七、总结

本项目以目标检测技术赋能无障碍生活,用 500 + 张标注红绿灯数据训练模型,结合行空板的硬件能力,实现了「视觉检测 + 语音播报 + 双屏显示」的完整解决方案。

没有复杂的技术门槛,基于开源工具和轻量化模型,就能为红绿色盲人群解决实际出行难题。这也是 AI 技术最有温度的应用方向 —— 用技术打破障碍,让每个人都能平等、安全地享受生活。

返回首页

返回首页

回到顶部

回到顶部

评论