1. 什么是 ESP-AI?

ESP-AI为你的开发板提供全套的AI对话方案,包括但不限于 ESP32 系列开发板的 IAT(ASR)+LLM+TTS 集成方案。依赖式注入到项目,不影响现有项目。

为什么说包括但不限于ESP32开发板呢?因为即使你的另一块开发板使用的是其他开发板,你也可以用ESP32来基于本项目搭建AI服务,并且使用串口通信方式来将指令或者对话发送到你的另一块开发板。

2、ESP-AI 能做什么?

我们设想这样的一个场景,你手里有一个机器人,他可以做一些固定的动作,但是你想和它进行交流,并且让它可以理解你的一些指令。如果你要从零开始实现这套流程,那你将会从收集麦克风的音频流开始,然后进入无休止的调试...

现在有了ESP-AI你大可不必这么做了,你只需要引入ESP-AI即可,对于离线语音唤醒、语音识别、大语言模型调用、文字转语音、喇叭输出音频等流程都已经帮你实现好了,而且ESP-AI使用插件式设计框架,上述中的每一个步骤都提供了扩展方法,让你可以随意定制你的产品。

3、怎么学习 ESP-AI?

[普通玩家] 如果你完全不懂软件或硬件,但是你有一定的动手能力,想给你的设备接入 AI 对话,请直接使用 ESP-AI开放平台。直接看 ESP-AI开放平台教程 。

[开发者] 请通读 开发指南 / 快速开始 & 开发指南 / 使用教程 来入门,接下来请通读其他所有文章。

开放平台提供免费的服务,只需要在配网页面配置秘钥即可连接开放平台服务,开发者自己开发的硬件代码也可以连接开放平台。

4、ESP-AI 技术栈

在软件方面:本项目服务端代码基于 Nodejs,硬件代码基于 Arduino。服务端虽然基于Nodejs进行开发,但是也提供其他编程语言编写插件,详情见插件开发章节。

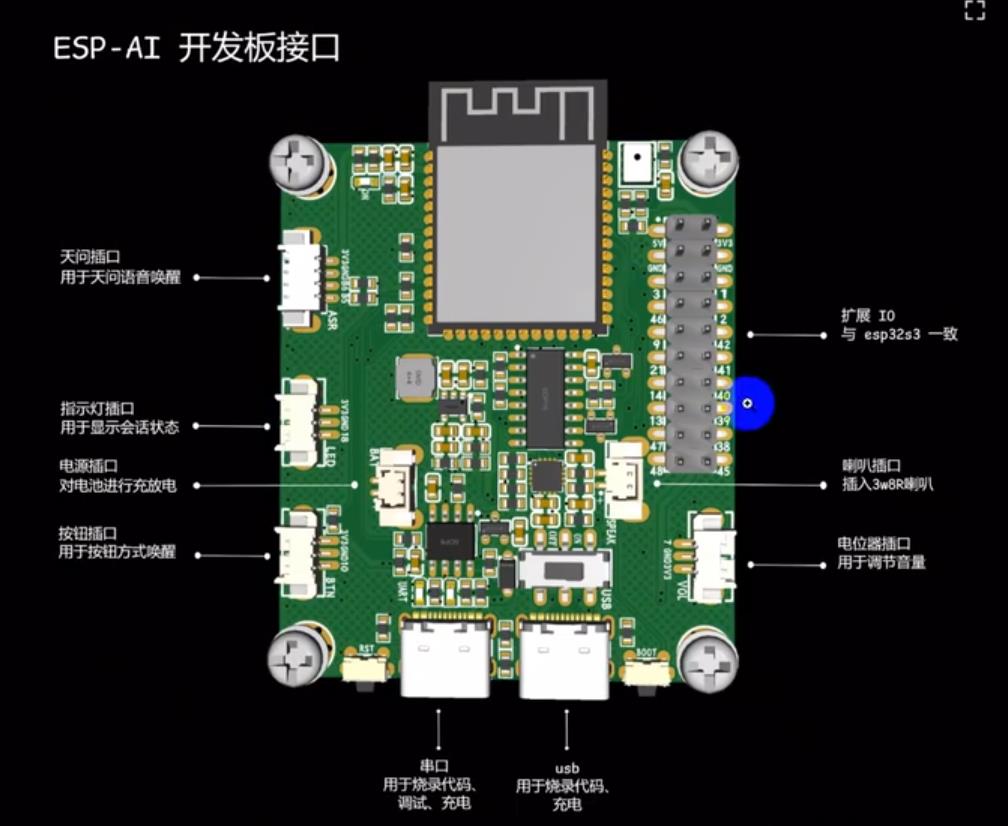

在硬件方面:本项目主要基于ESP系列的开发板进行运行。

5、特性

✔️ 生态开放、代码开源。

✔️ 可定制的离线语音唤醒词,且内置多种唤醒方式(内置、语音、按钮、串口、天问asrpro)。

✔️ 完整对话链接 IAT(ASR) ➡️ LLM/RAG ➡️ TTS。

✔️ 支持会话打断。

✔️ TTS/LLM 快速响应算法,在考虑服务费用的基础上尽力以最快速度响应用户。

✔️ 用户指令智能识别(家电控制、音频播放),可根据上下文动态响应指令。且支持自定义逻辑/字符匹配等方式来识别用户意图。

✔️ 配置化。

✔️ 插件化,可编写插件接入任何 LLM/TTS/IAT。

✔️ C/S 架构,也就是说你可以对每个设备进行管理,包括为每一个客户端(硬件)独立分配一套配置。

✔️ 完整的鉴权规则 。

✔️ 全链流式数据交互。

✔️ 开发者平台提供:免费服务、可视化配置 ... 。

✔️ 高度自定义(配网页面以及各种细节都是完全提供出来以供更改的)

✔️ 轻松应付大并发场景(需配合Nginx做负载均衡) 。

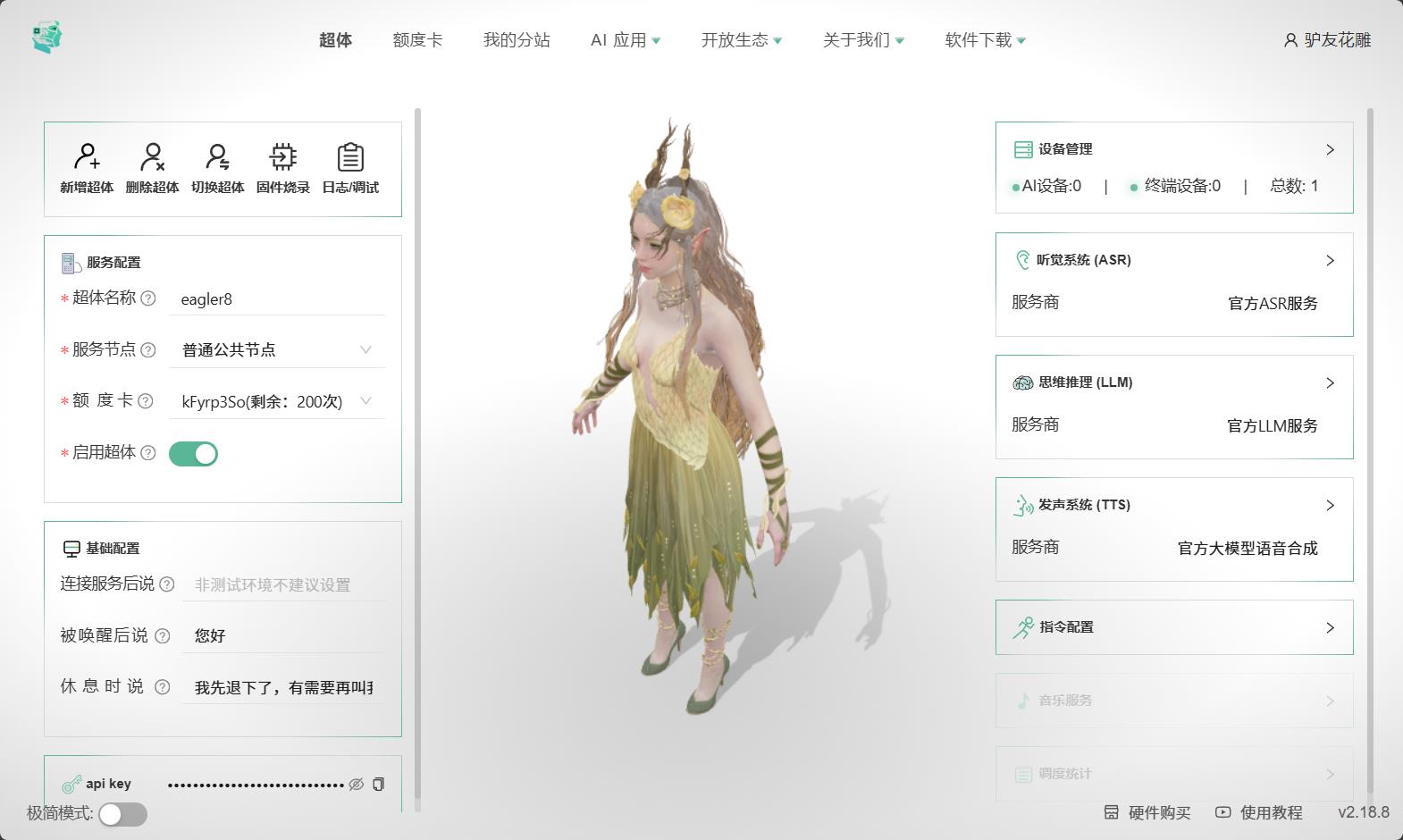

1、打开ESP-AI 开放平台(https://espai.fun/)

2、点击“新增超体”,设置名称,选择艾米,复制上一个超体的配置

完成新增艾米一号

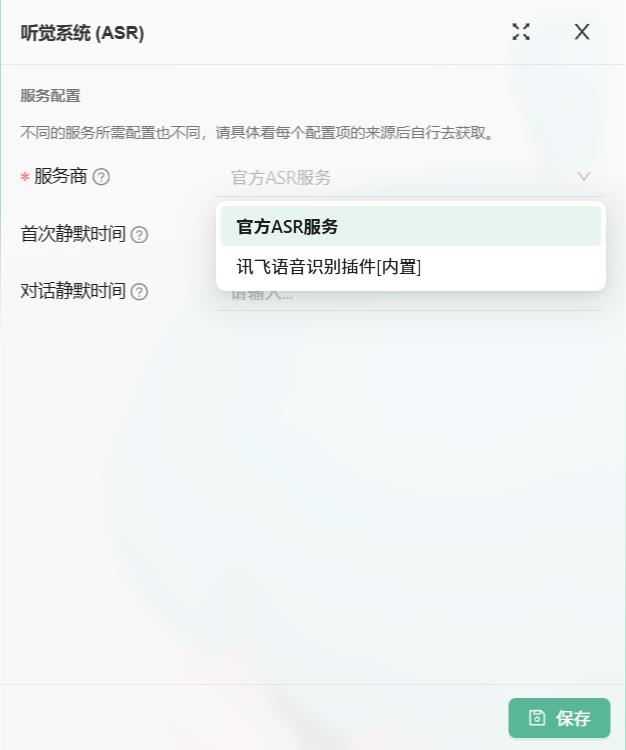

3、设置听觉系统(ASR)

选项有2个:

(1)官方ASR服务(默认)

(2)讯飞语音识别插件(内置)

4、讯飞语音识别插件有三个必填项:appid,apiSecret和apiKey,需要注册登录官网申请获得。

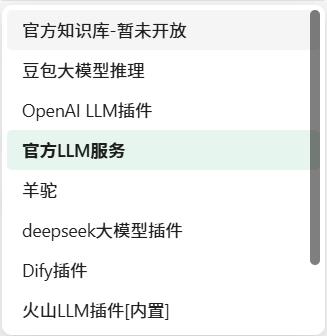

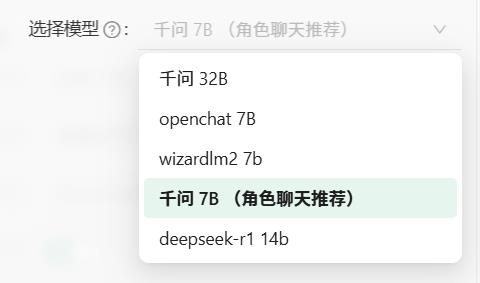

5、设置思维推理(LLM/RAG)

服务商选项有10个,模型选项有5个

6、讯飞LLM插件需要取得的配置项比较多

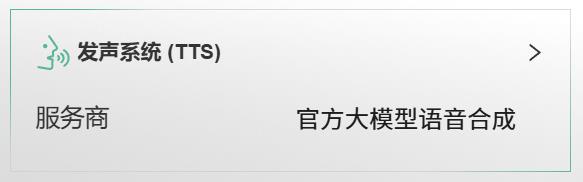

7、配置发声系统(TTS)

8、指令配置

指令用于实现开关灯等基本的家电控制,可配合客户端的指令监听实现自定义需求(客户端使用 onEvent 可监听用户指令,详情见:客户端指令监听)。

任何你想让设备做的事情都可以用指令配置实现

已经内置了如下指令: 音量调到xx% 、大点声、小点声、退下吧、帮我写一首歌,主题我不想去上班。

关键词建议设置一个,默认使用AI推理意图,所以只需要有相关意图就可以匹配到您的关键词。

返回首页

返回首页

回到顶部

回到顶部

评论