1. 什么是 ESP-AI?

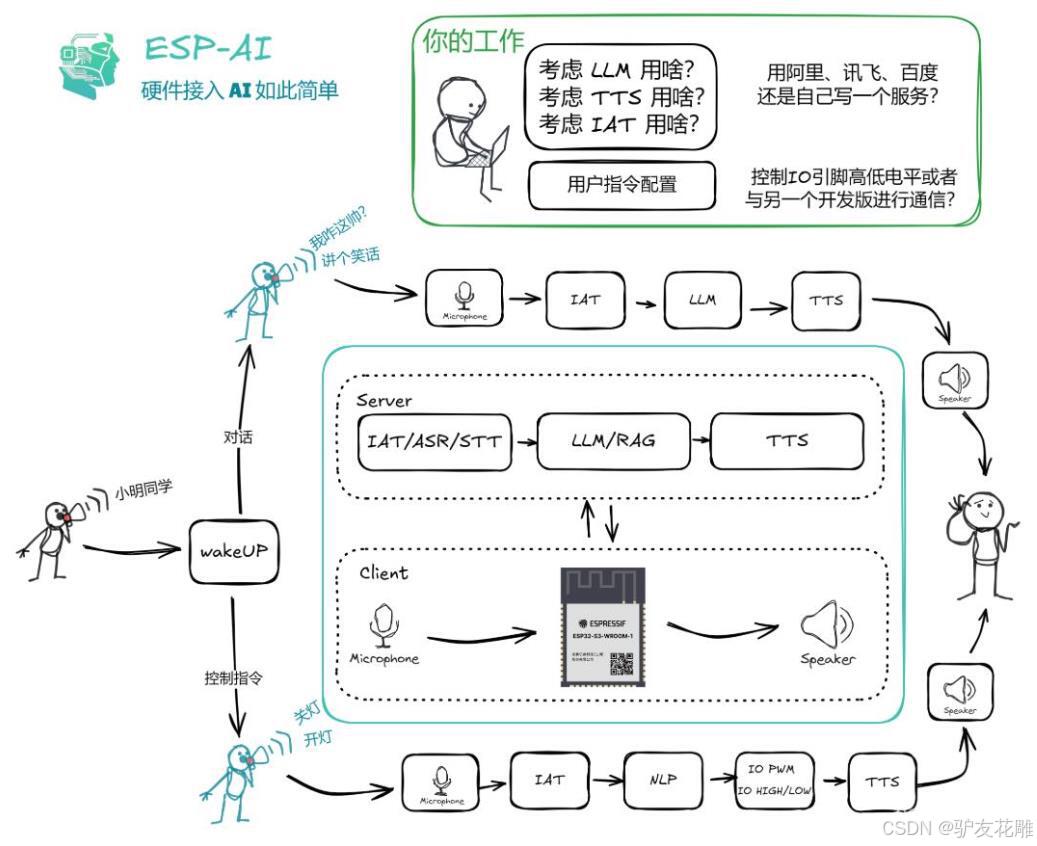

ESP-AI为你的开发板提供全套的AI对话方案,包括但不限于 ESP32 系列开发板的 IAT(ASR)+LLM+TTS 集成方案。依赖式注入到项目,不影响现有项目。

为什么说包括但不限于ESP32开发板呢?因为即使你的另一块开发板使用的是其他开发板,你也可以用ESP32来基于本项目搭建AI服务,并且使用串口通信方式来将指令或者对话发送到你的另一块开发板。

2、ESP-AI 能做什么?

我们设想这样的一个场景,你手里有一个机器人,他可以做一些固定的动作,但是你想和它进行交流,并且让它可以理解你的一些指令。如果你要从零开始实现这套流程,那你将会从收集麦克风的音频流开始,然后进入无休止的调试...

现在有了ESP-AI你大可不必这么做了,你只需要引入ESP-AI即可,对于离线语音唤醒、语音识别、大语言模型调用、文字转语音、喇叭输出音频等流程都已经帮你实现好了,而且ESP-AI使用插件式设计框架,上述中的每一个步骤都提供了扩展方法,让你可以随意定制你的产品。

3、怎么学习 ESP-AI?

[普通玩家] 如果你完全不懂软件或硬件,但是你有一定的动手能力,想给你的设备接入 AI 对话,请直接使用 ESP-AI开放平台。直接看 ESP-AI开放平台教程 。

[开发者] 请通读 开发指南 / 快速开始 & 开发指南 / 使用教程 来入门,接下来请通读其他所有文章。

开放平台提供免费的服务,只需要在配网页面配置秘钥即可连接开放平台服务,开发者自己开发的硬件代码也可以连接开放平台。

4、ESP-AI 技术栈

在软件方面:本项目服务端代码基于 Nodejs,硬件代码基于 Arduino。服务端虽然基于Nodejs进行开发,但是也提供其他编程语言编写插件,详情见插件开发章节。

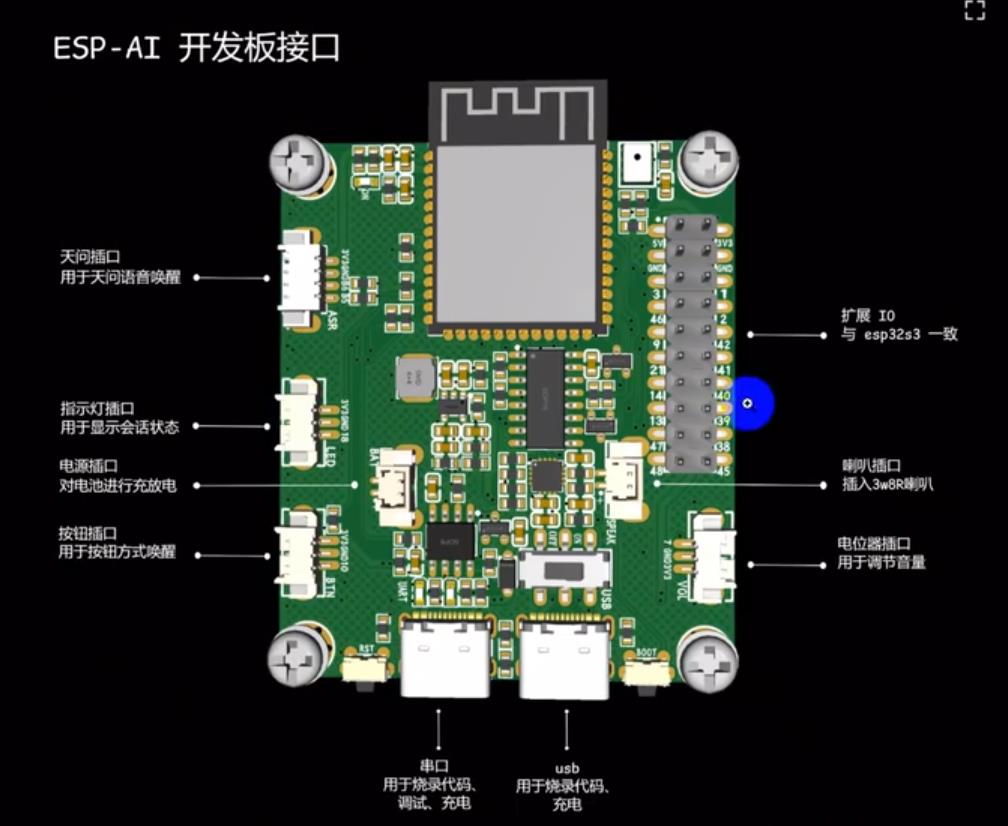

在硬件方面:本项目主要基于ESP系列的开发板进行运行。

5、特性

✔️ 生态开放、代码开源。

✔️ 可定制的离线语音唤醒词,且内置多种唤醒方式(内置、语音、按钮、串口、天问asrpro)。

✔️ 完整对话链接 IAT(ASR) ➡️ LLM/RAG ➡️ TTS。

✔️ 支持会话打断。

✔️ TTS/LLM 快速响应算法,在考虑服务费用的基础上尽力以最快速度响应用户。

✔️ 用户指令智能识别(家电控制、音频播放),可根据上下文动态响应指令。且支持自定义逻辑/字符匹配等方式来识别用户意图。

✔️ 配置化。

✔️ 插件化,可编写插件接入任何 LLM/TTS/IAT。

✔️ C/S 架构,也就是说你可以对每个设备进行管理,包括为每一个客户端(硬件)独立分配一套配置。

✔️ 完整的鉴权规则 。

✔️ 全链流式数据交互。

✔️ 开发者平台提供:免费服务、可视化配置 ... 。

✔️ 高度自定义(配网页面以及各种细节都是完全提供出来以供更改的)

✔️ 轻松应付大并发场景(需配合Nginx做负载均衡) 。

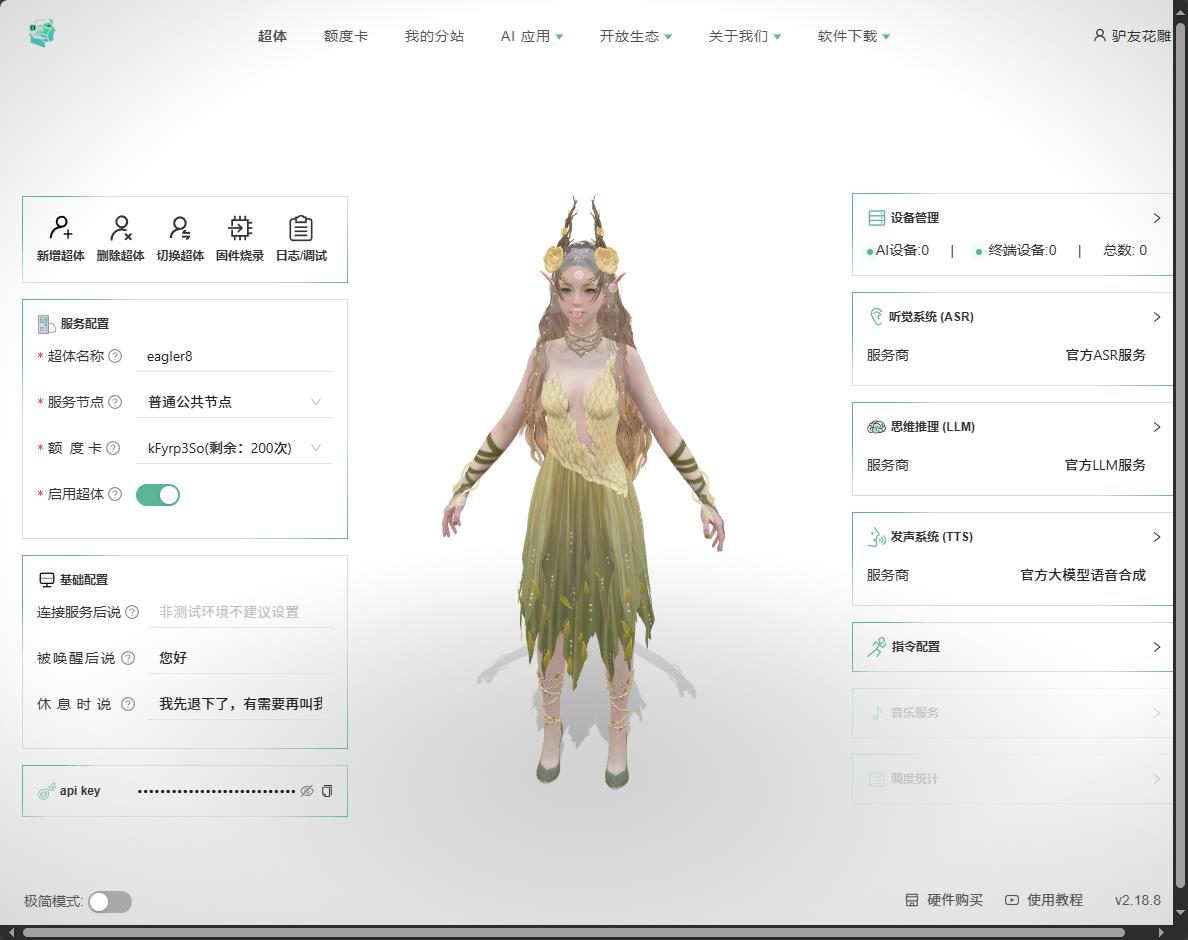

ESP-AI 开放平台(https://espai.fun/)是一个面向开发者及非技术用户的AI服务集成平台,旨在通过简化硬件与AI技术的结合流程,降低开发门槛,提供低成本、高效率的智能硬件开发解决方案。以下是其核心特点与功能解析:

1. 核心定位与功能

免代码接入:

开放平台为非程序员用户提供零代码接入AI服务的功能,用户无需搭建本地开发环境或编写复杂代码,即可通过可视化界面完成硬件设备的AI功能配置,例如语音唤醒、对话逻辑设置等。

全流程集成:

提供从语音识别(ASR)、大语言模型(LLM)调用到语音合成(TTS)的完整对话链路,支持流式数据传输,确保实时响应。

在线工具与服务:

包括在线烧录固件、3D交互式配置界面、实时日志查看等功能,用户可直接通过网页端管理硬件设备,无需本地部署服务器。

2. 技术架构与使用流程

服务端与客户端分离:

服务端基于Node.js开发,支持Docker快速部署(如docker run命令一键启动服务),负责复杂的AI计算与任务调度;客户端则基于ESP32系列开发板运行,通过Arduino框架集成,仅需几行代码即可完成基础功能对接。

认证与安全性:

所有接口均通过api_key进行身份认证,确保设备与服务的安全通信,支持为每个客户端独立分配配置,例如自定义唤醒词或指令逻辑。

插件化扩展:

支持通过插件接入第三方服务(如讯飞、阿里云的ASR/TTS服务),开发者可灵活替换底层AI模型或扩展功能模块。

3. 适用场景与优势

低成本快速开发:

针对中小企业和创业者,开放平台提供免费的基础服务(如讯飞接口调用),并允许用户按需升级至付费服务,降低初期投入成本。

多设备管理:

支持一对多服务架构,一个服务端可同时管理多个硬件设备,并独立配置每台设备的交互逻辑,适用于智能家居、工业控制等场景。

优化用户体验:

内置快速响应算法,缩短TTS和LLM的延迟,支持对话打断功能,提升交互自然度;离线语音唤醒方案(如Edge Impulse模型)减少对云端依赖。

4. 典型应用案例

智能家居:通过语音指令控制灯光、空调等设备,支持上下文动态响应(如“打开客厅灯”与“调暗一点”)。

教育玩具:开发能与儿童对话的智能玩具,集成教育内容与娱乐功能。

工业控制:在工厂环境中实现语音查询设备状态或执行操作指令,提升操作效率。

5. 未来发展与生态支持

功能迭代:计划推出在线唤醒词生成、客户端OTA升级、多语言插件支持(减少对Node.js的依赖)等功能。

总结

ESP-AI 开放平台通过“开箱即用”的设计理念和高度可定制化的架构,大幅降低了AI硬件的开发门槛。无论是技术开发者还是非编程用户,均可通过该平台快速实现智能设备的AI对话功能,推动物联网设备向智能化、人性化方向演进。

ESP-AI 最简单、最低成本的硬件接入AI的方案,让任何物品都能接入大语言模型的开源库。

这个库可以满足AI接入硬件的任何需求,因为库提供了丰富的sdk。

官网:https://espai.fun

ESP-AI 开放平台,一个完全基于 ESP-AI 打造的AI人工智能落地的应用服务系统!

ESP-AI 开放平台的工作原理主要基于以下几个关键步骤:

1、数据采集与预处理:

数据采集:通过传感器、摄像头、麦克风等设备收集环境数据。

预处理:对采集到的数据进行清洗、去噪、归一化等操作,以提高数据质量。

2、模型训练:

选择模型:根据任务需求选择合适的机器学习或深度学习模型。

训练模型:使用预处理后的数据训练模型,调整参数以优化性能。

3、模型部署:

模型优化:对训练好的模型进行优化,如量化、剪枝等,以提高运行效率。

部署到设备:将优化后的模型部署到ESP32等嵌入式设备上。

4、推理与决策:

实时推理:设备在运行时使用部署的模型进行实时推理,处理新数据。

决策执行:根据推理结果执行相应的操作或决策。

5、反馈与更新:

数据反馈:将设备运行中的新数据反馈到平台,用于进一步优化模型。

模型更新:定期更新模型,以适应环境变化和任务需求的变化。

6、用户交互:

API接口:提供API接口,方便开发者调用平台功能。

可视化工具:提供可视化工具,帮助用户理解和分析模型性能。

通过这些步骤,ESP-AI 开放平台能够实现从数据采集到模型部署和更新的完整AI应用生命周期管理。

配网步骤

1、到ESP-AI开放平台 注册并获取 api_key

2、给设备烧录固件

3、连接 ESP-AI 热点

4、打开配网页面(192.168.4.1)

5、填写wifi、api_key、唤醒方式后点击保存

灯光指示

直接使用的 ESP-AI 内置指示灯颜色,见: 指示灯。但是在内置基础上增加了下面的指示灯

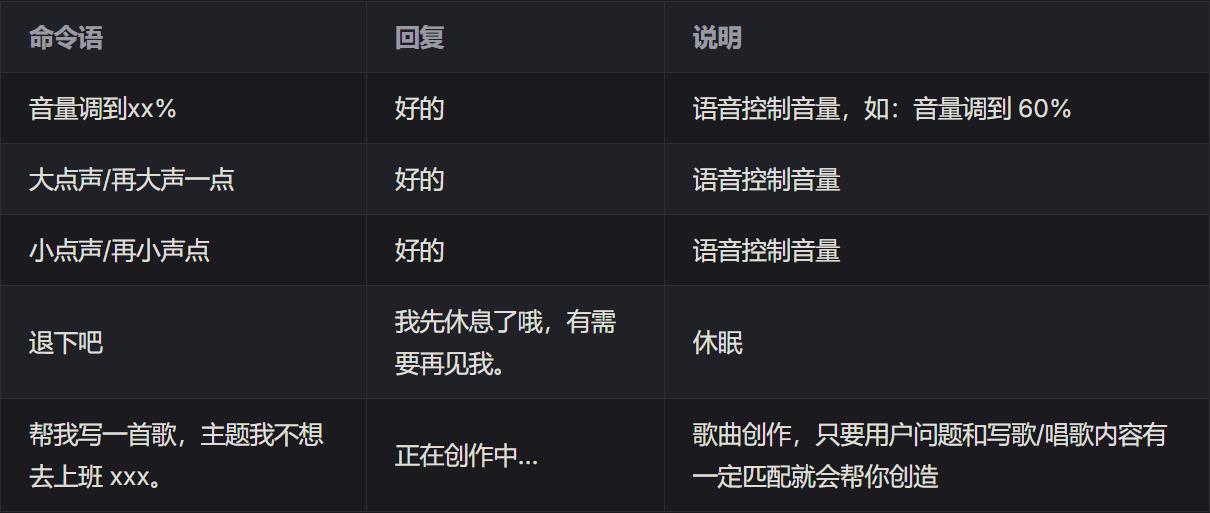

内置语音命令

下面这些命令是不需要配置的,已经内置了。

返回首页

返回首页

回到顶部

回到顶部

评论